摘要

液冷已进入由算力平台升级与云厂商资本开支共同推动的“系统性放量期”。2025–2026年,随着NVIDIA高功耗算力平台全面放量、海外CSP启动GW级AI数据中心集中建设,液冷的核心矛盾已从“是否采用”转向“谁能交付、谁能放量”。液冷不再是技术选择题,而是AI算力基础设施中确定性最高、节奏最清晰的增量环节之一。

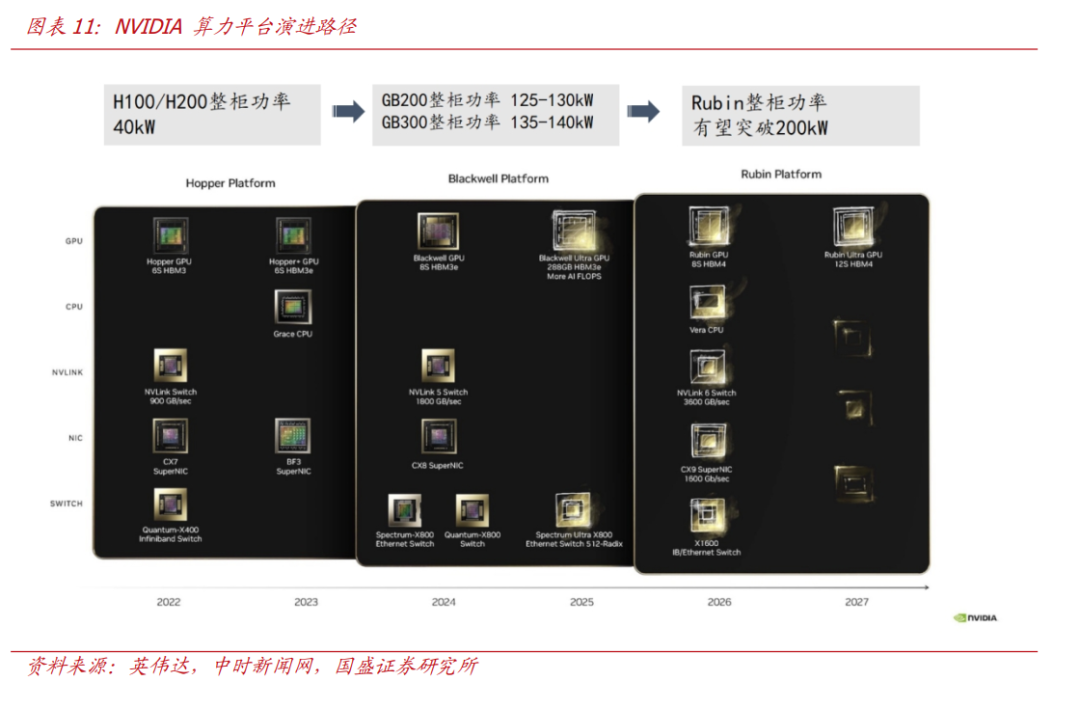

第一重拐点来自NV:液冷被“写进”算力平台的交付标准。从H100/H200到GB200 NVL72,再到后续GB300与Rubin/Rubin Ultra,NV正通过平台级升级持续推高单机柜功率密度。GB200整柜功率已达125-130kW,GB300进一步提升,下一代Rubin平台有望迈入200kW以上区间,传统风冷在工程与可靠性层面已难以支撑规模复制。我们认为,NVIDIA并非主动“推广液冷”,而是在算力平台演进中被动完成液冷的标准化普及,液冷需求具备极高确定性。

从量级测算看,NV路线已为液冷打开百亿美元级别空间。在较为保守的假设下,我们测算2026年NVIDIA高功率平台(GB200/GB300)对应的液冷系统市场空间接近100亿美元;随着出货规模提升,2028年NV路线对应的液冷市场空间有望提升至150-200亿美元以上,仅NV带来的液冷空间单一年度即可突破千亿人民币。

第二重拐点来自CSP:自研AI服务器与ASIC集群打开第二增长曲线。除NV平台外,Google、Meta、Amazon等头部CSP正加速推进自研ASIC与定制化AI服务器,以优化算力成本与能效比。自研集群同样呈现高功率密度、高集成度特征,对液冷的依赖程度持续提升。我们测算,2026年CSP自研体系对应的液冷市场空间达40亿美元以上,至2027年有望提升至70亿美元左右,进一步打开液冷市场空间。

从产业格局看,液冷竞争焦点已从技术优劣转向供应链准入与工程交付能力。液冷并非单一零部件,而是贯穿芯片、服务器与数据中心的系统级工程。实际项目中,液冷供应链往往由芯片厂、CSP与ODM联合决策,进入主流平台白名单、具备规模化交付与长期可靠性验证能力成为决定份额的核心因素。我们认为,液冷行业将加速形成“强者恒强”的格局,α将集中在具备全链条能力、深度绑定主流算力平台的头部厂商。

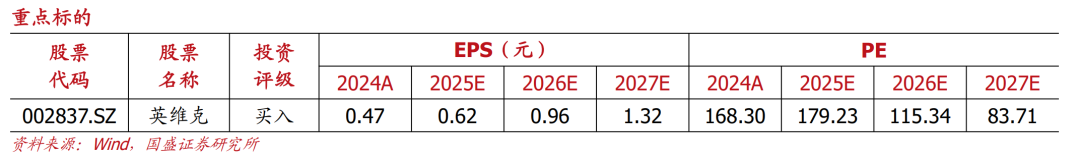

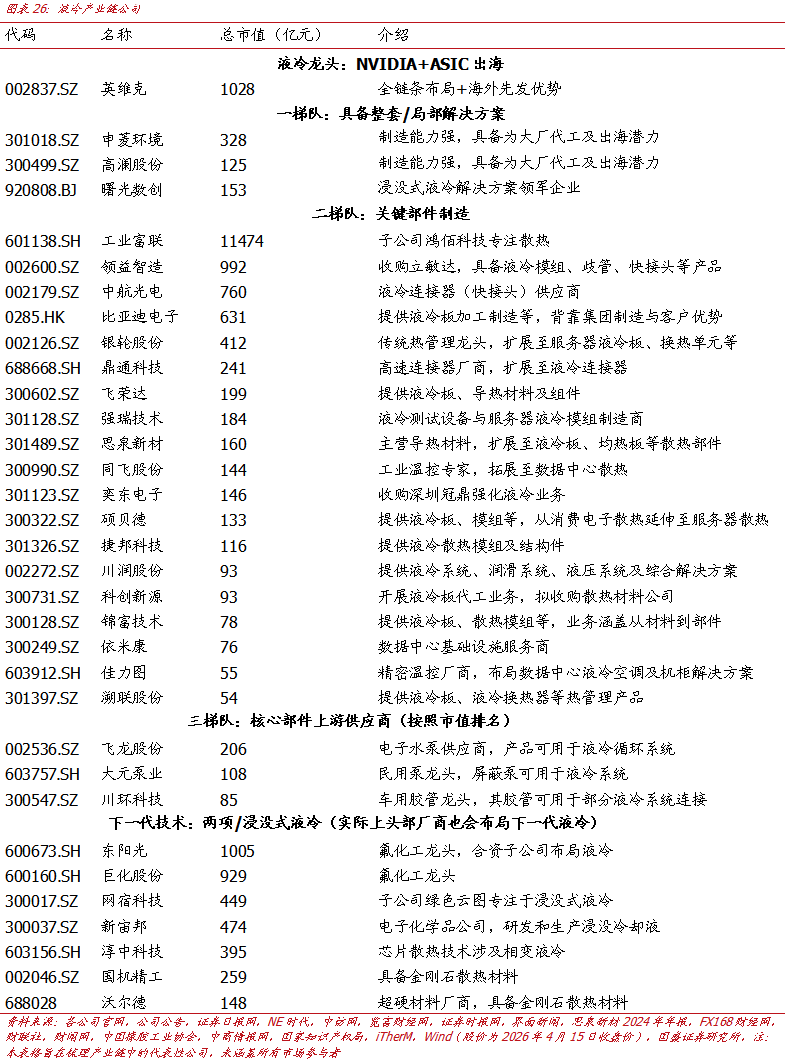

投资建议:液冷已从主题预期阶段迈入落地与交付阶段,建议重点关注在 NV平台与头部 CSP 供应链中具备稳定份额、并拥有系统级交付能力的液冷厂商。

核心推荐:英维克(液冷全链条 系统级龙头 出海先发优势)

建议关注:申菱环境(海外市场拓展能力)、高澜股份(国际化布局)、飞龙股份(核心上游),科创新源(后道代工),东阳光(氟化物 部件)等

风险提示:算力进展不及预期、AIDC发展不及预期、技术创新风险、行业竞争风险、贸易限制风险、市场规模测算风险

投资要件

当下的液冷与此前相比,最大的变化在于:正处于功率密度跨过阈值后的系统性放量关键窗口期。当算力平台的功率密度稳定超过工程阈值,液冷不再是“更优解”,而是唯一可规模复制的交付方案。这不是技术演进的线性过程,而是一次结构性切换。

Q1:市场最容易低估液冷的哪三件事?

1)低估NV标准化平台带来的“被动普及效应”

在NV最新算力平台中,液冷并非客户选项,而是平台形态的一部分。从GB200 NVL72开始,液冷已被写入交付逻辑:只要平台出货,液冷就同步出货。我们认为,这是液冷需求确定性最高、最容易被低估的来源。

2)低估CSP自研AI集群带来的第二增长曲线

市场关注点多集中在NV路线,但头部CSP的自研ASIC集群同样在快速推高功率密度。自研系统在高密度部署、长期稳定运行等方面,对液冷的依赖程度并不低于通用GPU平台。谷歌V7及以后的集群均需要配置液冷,Meta\Amazon\AMD等纷纷布局下一代液冷集群。

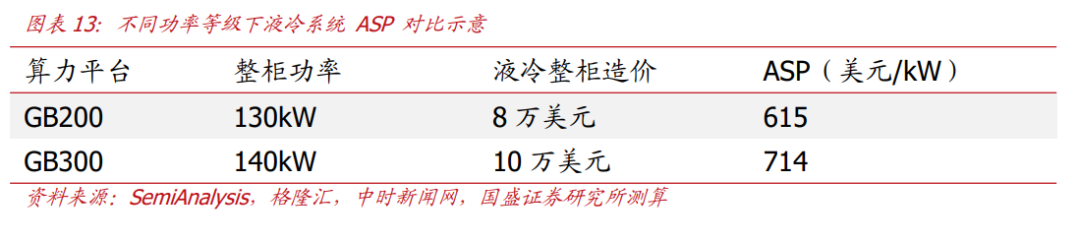

3)低估液冷ASP随功率代际上行的弹性

液冷并非“规模越大、越便宜”的硬件。随着单机柜功率从100kW向200kW 演进,液冷系统在泵功率、冗余设计、可靠性测试与控制系统等方面均需同步升级(牵一发而动全身,复杂度大幅提升),单位kW对应的液冷价值量有望进一步提升。液冷是AI基础设施中少数有望在放量过程中实现“量价齐升”的环节。

Q2:为什么是现在?

因为2025–2026年是算力平台与数据中心建设节奏同时“踩油门”的时间窗口。一方面,NV高功率机柜进入规模出货期;另一方面,海外CSP启动GW级AIDC集中建设。算力端与基础设施端共振,使液冷首次具备“平台级确定性 工程级放量”的双重条件,行业逻辑由“预期”切换为“交付”。在2026GTC大会上,我们亲眼目睹液冷成为各家厂商的标配。

投资建议:近期市场担心液冷板块预期较高但Q1难有业绩释放,从而出现“避险”情绪,我们认为这只是短期预期回调,AI时代液冷的星辰大海才刚刚拉开序幕,2026年将从主题预期阶段迈入放量兑现阶段,建议重点关注在 NV平台与头部 CSP 供应链中具备稳定份额、并拥有系统级交付能力的液冷厂商。

核心推荐:英维克(液冷全链条 系统级龙头 出海先发优势)

建议关注:申菱环境(海外市场拓展能力)、高澜股份(国际化布局)、飞龙股份(核心上游),科创新源(后道代工),东阳光(氟化物 部件)等

风险提示:算力进展不及预期、AIDC发展不及预期、技术创新风险、市场规模测算风险

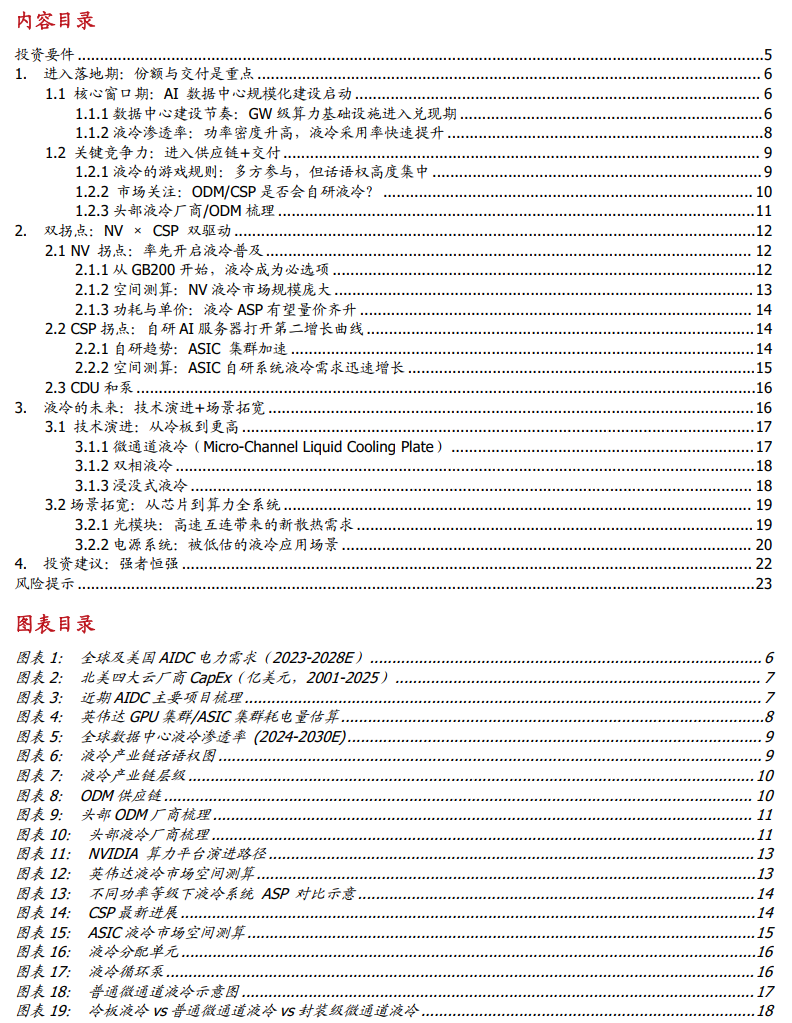

1. 进入落地期:份额与交付是重点

液冷已从“是否采用”的技术争论阶段,进入“谁能交付、谁能放量”的产业阶段。2025–2026年,随着海外AI数据中心进入GW级别集中建设周期,液冷的竞争核心正从方案优劣转向供应链准入与工程交付能力。我们认为,液冷板块的β已基本确立,α将集中在份额兑现与交付节奏上。

1.1 核心窗口期:AI 数据中心规模化建设启动

1.1.1 数据中心建设节奏:GW级算力基础设施进入兑现期

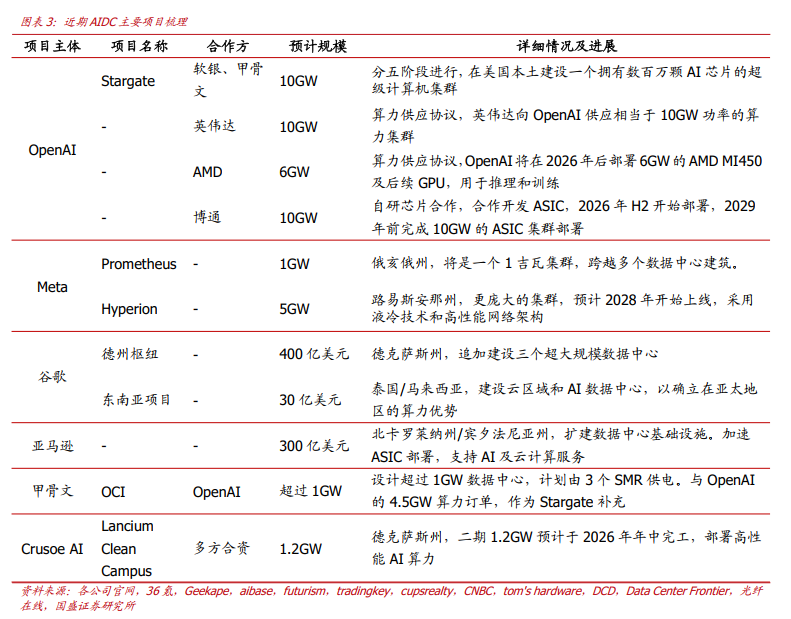

25-26年全球AIDC已进入“集中建设、集中上电”的窗口期,新增算力对应的基础设施规模显著放大。全球AIDC电力需求将迎来爆发式增长:据SemiAnalysis预测,预计2026年攀升至约40GW,中长期AIDC将主导电力增量市场。我们预测到2028年,全球AIDC电力需求将高达76GW,GW级集群交付将成为行业常态。

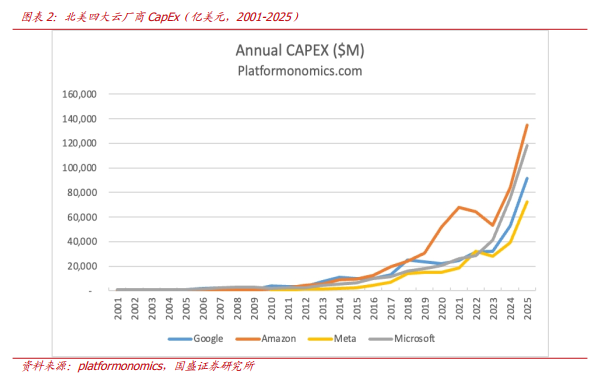

全球AIDC新增GW高度集中于北美与部分亚太地区,核心增量主要由头部CSP推动。Google、Microsoft、Meta、Amazon四大CSP的2025年度资本开支总额已超过4160亿美元,其中微软AI数据中心相关投入占比提升至一半。从具体项目看,海外CSP正在加速推进超大规模AIDC规划,Meta的“Prometheus”相关园区、OpenAI/软银/甲骨文的“Stargate”计划、谷歌的自研AI集群项目,均呈现出单项目投资规模大、规划周期长、功率密度高的特征。

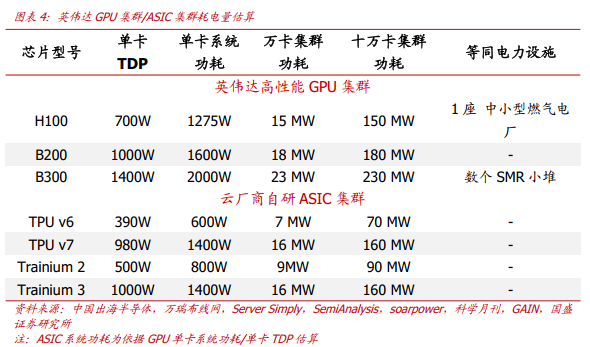

从单体项目看,当前新建AIDC已普遍采用100MW级别起步、并分期扩容至约200MW的建设模式(对应约十万卡GPU)。十万张H100集群功耗约达150MW((单卡功耗700W 每卡配套设备功耗约575W) × 10万张 ÷ (1 - 外部设施功耗占比10%)),而下一代B300的十万卡集群将突破220MW,其电力需求相当于一座中型燃气电厂或数个SMR小堆。这意味着,如果每年新增10个十万卡集群,全球AIDC新增电力就将达到GW的量级。

综上,我们认为海外CSP主导的“超大规模、集中式建设模式”,决定了液冷方案未来有望迅速以批量化的形式铺开。

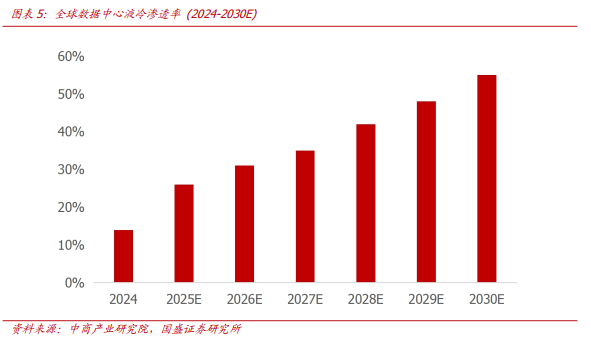

1.1.2 液冷渗透率:功率密度升高,液冷采用率快速提升

AIDC新增GW并非线性复制传统数据中心,其核心特征在于单位面积与单位机柜功率密度的系统性跃升。以英伟达路线为例,从H100到GB200/GB300 NVL72,再到下一代Rubin/Rubin Ultra,单机柜功率密度已从30–40kW快速提升至100–150kW,部分路线图中甚至指向600kW以上。类似趋势亦出现在Google、Meta等CSP的ASIC集群中,功率密度成为AIDC的第一性约束。

现阶段,液冷在存量数据中心中的渗透率非常低,据TrendForce在新建 AIDC 项目中的采用比例已显著抬升(跟随高功率芯片出货节奏),且随功率密度提升呈现出加速趋势。我们认为,液冷渗透率的提升并非渐进式优化,而是由功率密度跨越临界值后触发的“爆发增长”,未来渗透率加速提升逻辑下,液冷行业贝塔强劲。

1.2 关键竞争力:进入供应链 交付

液冷产业的竞争焦点,正在从“技术可行性”转向“供应链准入与工程交付能力”,其本质是一场综合设计与系统工程能力的竞争。

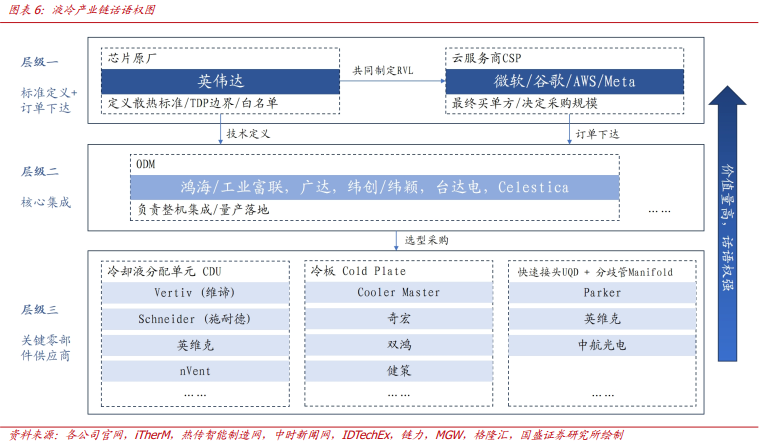

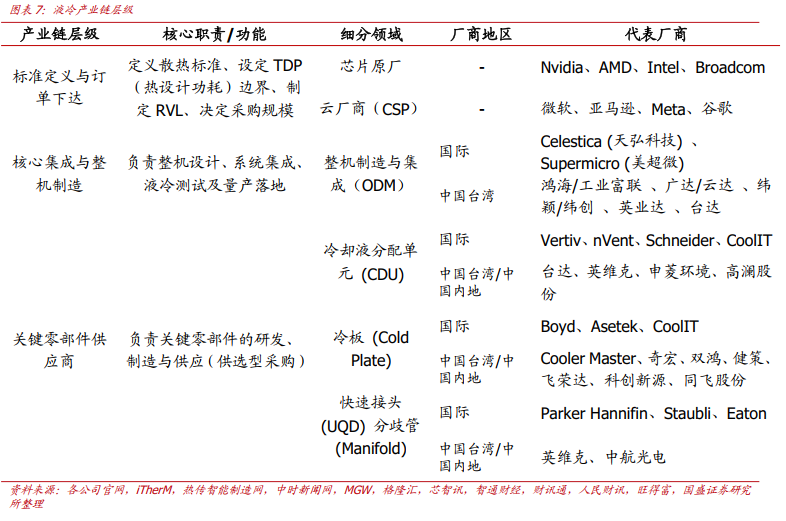

1.2.1 液冷的游戏规则:多方参与,但话语权高度集中

液冷并非单一零部件产品,而是贯穿芯片、服务器与数据中心的系统级工程,其产业链参与方众多,但话语权集中度高。从决策链条看:

芯片厂:如NVIDIA、AMD等,定义功耗与热设计边界,通常决定服务器内部的液冷组件方案及供应商份额(冷板组件);

CSP:如谷歌、亚马逊、Meta等,决定采用供应商及规模;

ODM:如台达、广达、纬创、工业富联、CLS(天鸿)等,负责整机集成与量产落地,同时对供应商份额有部分决策权;

液冷厂商:提供冷板、CDU、管路、manifold、UQD等关键系统,单一厂商或可提供多种品类,份额根据具体项目决定。

各家ODM厂商在服务器散热供应链上拥有其特定合作体系,彼此供应链相对独立。

尽管参与主体众多,但在实际项目中,液冷供应链的准入往往由 CSP 芯片厂 ODM 联合决定,液冷厂商进入产业链需要获得以上三个环节的“白名单”,其中芯片原厂白名单尤为重要。

我们认为,液冷产业的话语权并不掌握在单一环节,而集中于能同时满足技术适配(售前)、规模交付(售中)、长期可靠性要求(售后)的核心供应链。

1.2.2 市场关注:ODM/CSP是否会自研液冷?

市场普遍关注ODM或CSP是否会下场自研液冷系统,从现实情况看,全面自研的可能性有限。部分终端客户(如Google)确实在系统层面深度参与液冷架构设计,鸿海等厂商亦具备较强制造能力,但在CDU、泵阀、密封可靠性测试等核心环节,仍高度依赖专业供应商。即便未来部分环节出现内部化趋势,核心零部件的专业化分工格局短期内难以改变。

我们认为,液冷产业不会走向“完全垂直整合”,而更可能形成核心部件专业化 系统级协同定制的稳定格局。

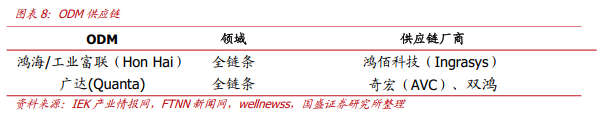

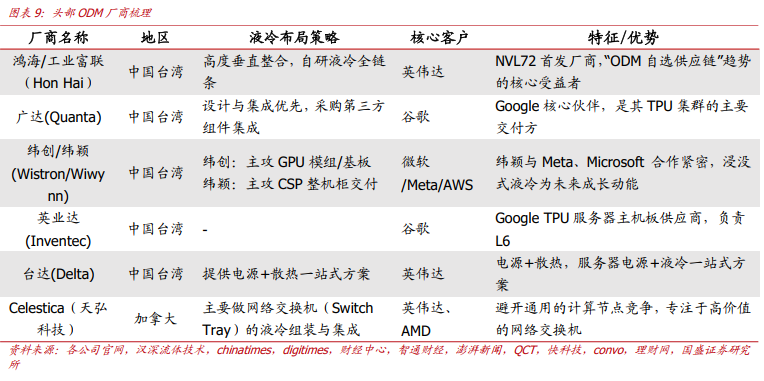

1.2.3 头部液冷厂商/ODM梳理

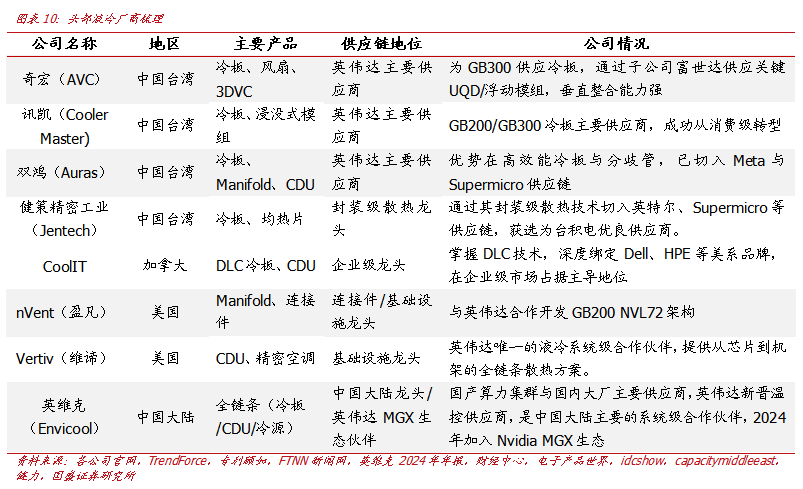

ODM厂商在液冷领域的策略分化为“垂直整合”与“集成交付”两条路径。鸿海具备从冷板到CDU的自研全链条制造能力;台达电则利用电源领域的霸主地位,推行“电源 散热”的一站式捆绑方案。相比之下,广达与纬颖主要采取采购第三方组件进行集成的策略,分别深耕Google和Meta的定制化需求。Celestica则采取差异化竞争,专注于高价值的网络交换机液冷组装与集成。

液冷厂商呈现出高度专业化与头部集中的格局。奇宏(AVC)、讯凯(Cooler Master)与双鸿作为英伟达主要供应商,牢牢占据市场核心地位。欧美厂商则在基础设施与关键组件上占据主导:CoolIT是企业级DLC龙头,nVent是Manifold与流体连接件龙头,Vertiv则主攻高密CDU与电源的整合方案。此外,英维克作为中国大陆全链条龙头,已成功切入Nvidia供应链。

2.双拐点:NV × CSP 双驱动

液冷是由上游芯片厂商与下游云厂商共同推动的系统级升级。2025–2026年液冷迎来两大拐点:一是以NVIDIA为代表的算力平台率先将液冷纳入标准化配置,二是头部CSP在自研AI服务器与ASIC集群中同步放大液冷需求。双拐点叠加下,液冷市场空间进入可测算、可兑现阶段。

2.1 NV 拐点:率先开启液冷普及

2.1.1 从GB200开始,液冷成为必选项

NVIDIA正在通过算力平台的一体化升级,将液冷从“可选”转变为“交付必选”。从产品路线看,NVIDIA已明确从H100/H200平台升级至GB200 NVL72,并在2026年后进一步演进至Rubin与RubinUltra。单芯片功耗、互连密度与整柜功率持续提升,推动散热方案发生结构性变化。以GB200 NVL72为例,其单机柜集成72颗高功耗GPU,通过NVLink/NVSwitch互联,整柜功率已达125–130kW区间, GB300整柜功率升级至135-140kW区间,下一代Rubin有望突破200kW,传统风冷在工程层面已难以支撑规模复制(单机柜散热上限在50 kW)。

我们认为,NVIDIA 并非“推广液冷”,而是在通过平台升级被动地普及液冷,这是液冷需求确定性最高的来源之一(换言之,25年部分/26年及以后出厂的高功率芯片均需要配置液冷)。

2.1.2 空间测算:NV液冷市场规模庞大

英伟达在GB200/GB300代际中,对高功率密度算力系统的架构进行了系统性重构,液冷从“可选配置”转变为“默认方案”。随着NVL72成为GB300的标准化scale-up形态,英伟达平台的液冷需求不再取决于单点项目试点,而是随整机出货同步放量。我们认为,NV平台液冷已进入可测算、可兑现的规模化阶段。

多角度测算:英伟达平台液冷市场空间究竟有多大?

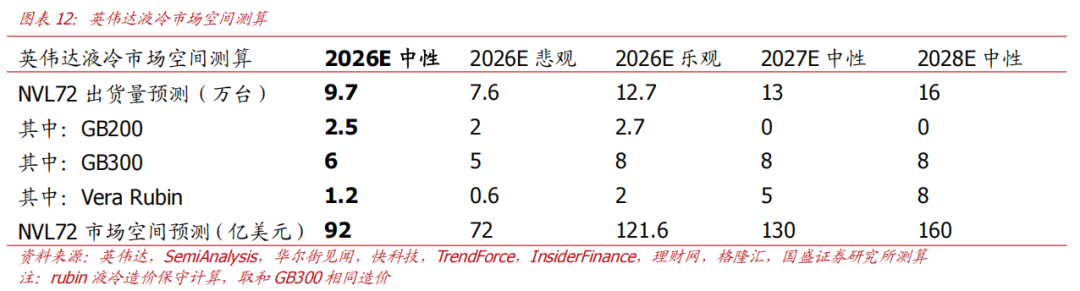

测算公式:

英伟达液冷市场空间=NVL72出货量×单套液冷系统价值量(暂不考虑液冷未来技术路径的变革,以及带来潜在ASP的提升)

从硬件构成看,NVL72级别AI服务器采用完整的机柜级冷板式液冷方案,核心部件包括冷板、快接头、CDU、manifold及管路系统等。参考OCP液冷规范头部液冷厂商公开报价区间及ODM方案拆解,我们测算单套GB300 NVL72液冷系统BOM约为10万美元,处于行业中性水平。

出货节奏方面,GB200主要承担2025年的小规模验证与导入,而GB300则是以NVL72为主形态、全面面向超大规模AIDC的平台。结合英伟达产品路线图以及我们对服务器ODM与液冷供应链的调研,预计2026年NVL72出货量约9.7万台,2027–2028年随GB300、Rubin全面放量进一步提升。

综合英伟达产品代际演进、NVL72标准化架构、AIDC功率需求,我们认为:

2026年英伟达平台液冷市场空间已具备近100亿美元的可兑现规模,2027年在GB300/Rubin放量及单柜功率持续上行的背景下,有望提升至130亿美元以上,并在2028年进一步向150–160亿美元区间扩展。

更重要的是,英伟达通过NVL72对液冷进行标准化绑定,使得液冷需求呈现出“随出货同步放量”的特征,其增长斜率明显快于传统“渗透率逐步抬升”的逻辑,为液冷行业提供了确定性极高的第一条增长曲线。

2.1.3 功耗与单价:液冷ASP有望量价齐升

与传统硬件不同,液冷系统并非“规模越大、单价越低”,其ASP反而可能随功耗提升而上行。随着单柜功率从100kW向200kW 演进,液冷系统在泵功率、冗余设计、可靠性等级等方面均需同步升级,CDU、阀门、管路等核心部件的规格要求明显提高,前期研发设计成本进一步上升。在下一代Rubin/RubinUltra平台中(哪怕不考虑液冷技术路径的变革),单千瓦液冷的价值量占比有望进一步提升,即机柜越高阶,单位液冷成本越高(越复杂越贵)。我们认为,液冷是少数能够在算力升级周期中实现“量价齐升”的基础设施环节。

2.2 CSP拐点:自研AI服务器打开第二增长曲线

2.2.1 自研趋势:ASIC 集群加速

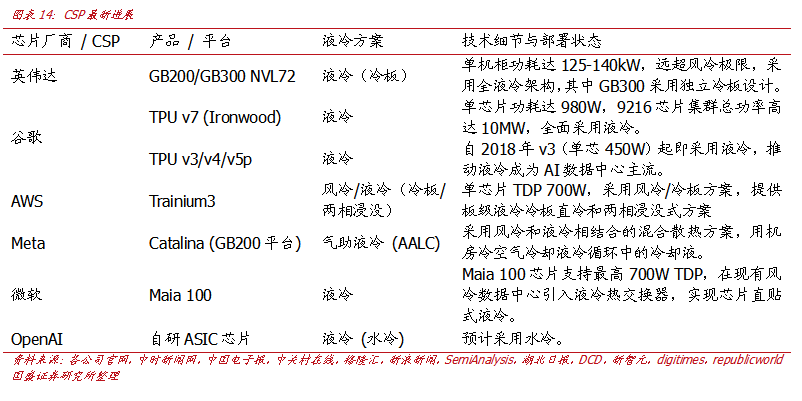

除NVIDIA平台外,头部CSP的自研AI服务器正成为液冷需求的第二驱动力。Google、Meta、Amazon等CSP持续推进自研 ASIC(TPU、MTIA、Trainium/Inferentia)以优化算力成本与能效比,自研集群在架构上更强调高密度部署与长期稳定运行,同样面临功率密度快速抬升的问题,谷歌从2018年的TPU v3开始使用液冷,TPU v7全面采用液冷;Meta Catalina (GB200平台)采用AALC (风液混动);AWS Trainium3平台采用风冷/液冷方案;微软Maia 100在现有风冷数据中心基础上引入液冷热交换器;OpenAI自研ASIC芯片预计采用水冷方案。

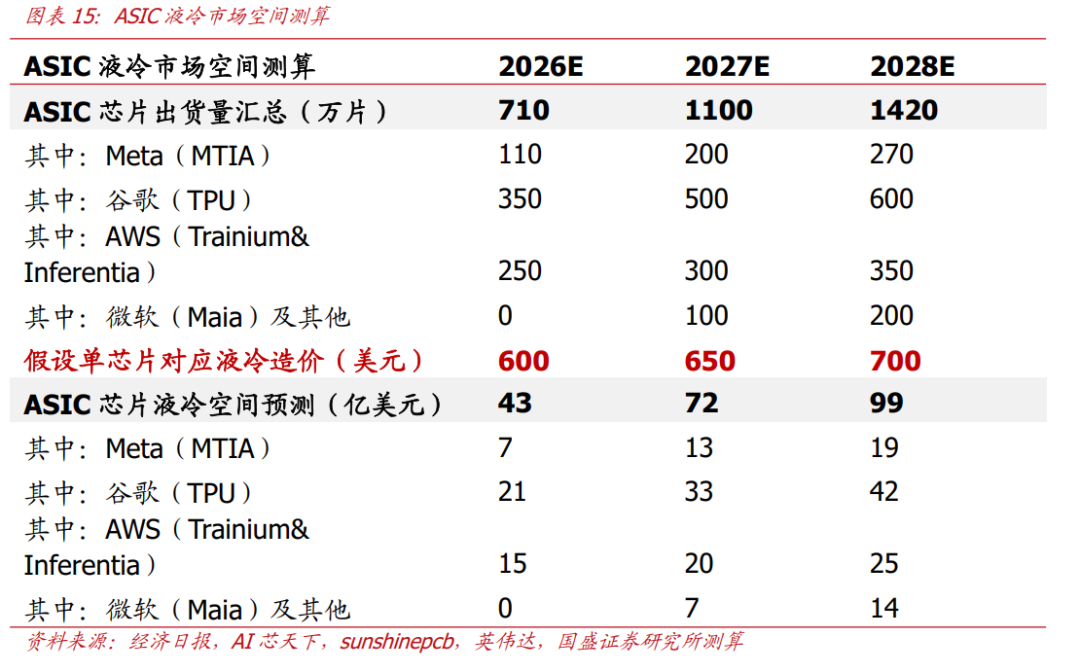

2.2.2 空间测算:ASIC自研系统液冷需求迅速增长

我们认为,CSP自研ASIC正在成为液冷需求的第二条增长曲线,且其放量节奏与NV平台存在时间错位,具备较强的补充效应。

测算公式:

CSP ASIC 液冷市场空间= ASIC液冷机柜数量×单柜液冷系统价值量

结合CSP发言、供应链调研及服务器ODM反馈,我们判断:

1)2026年ASIC对应的算力规模约为NV平台的30–40%

2)考虑ASIC单柜功率略低于NVL72,但同样采用冷板式液冷,单柜液冷价值量约为NV平台的70–80%

在此假设下:

若2026年NV平台液冷市场空间约90亿美元

则ASIC液冷市场空间≈90×40%×75%≈25–29亿美元

考虑到不同CSP推进节奏差异,我们认为2026年ASIC液冷市场空间在30–50亿美元区间更为合理。

2026年CSP自研ASIC对应的液冷市场空间约为30–50亿美元,约为英伟达平台液冷空间的1/3-1/2;2027年随TPUv5、Trainium2、Maia等平台放量,该空间有望提升至60–90亿美元。

更重要的是,ASIC平台的液冷需求具有长期性与粘性:

1)自研芯片不会频繁切换散热方案;

2)一旦形成标准化液冷架构,后续扩容将高度复用既有方案;

3)有利于液冷厂商获得稳定、可持续的订单来源。

2.3 CDU和泵

一套完整的单相冷板式液冷系统,其核心零部件可拆解为服务器端和机架端两大层级。服务器端最核心的部件为冷板、快接头,在机柜层级,冷却液分配单元(CDU)、分流器(Manifold)、管路、冷却液以及安全监控管理系统共同构成了完整的散热闭环。

CDU 是液冷系统的核心设备,负责驱动冷却液循环,控制温度、压力和流量,其核心组件包括热交换器 (Heat Exchanger)、循环泵 (Pumps)、配电控制箱、管路组件、传感器 (Sensors)等。其中循环泵是CDU的动力核心,参考飞龙股份数据,在CDU总BOM中占比约 35%-40%,电子液冷泵单柜价值7-8万元,单台CDU多采用双泵(一用一备) 或更高配置,如N 1冗余,单体价值高,要求零泄漏、高扬程、长寿命。

泵的厂商格局为海外链第一梯队,国产链加速替代。

3.液冷的未来:技术演进 场景拓宽

液冷的技术形态与应用场景仍在持续演进。随着功率密度进一步抬升、算力系统复杂度提高,液冷技术正从冷板式向更高效的微通道、双相、浸没等方向发展;应用对象也有望从GPU/ASIC芯片,逐步拓展至光模块、电源等高功耗部件,成为算力系统的通用热管理基础设施。

3.1 技术演进:从冷板到更高

3.1.1微通道液冷(Micro-Channel Liquid Cooling Plate)

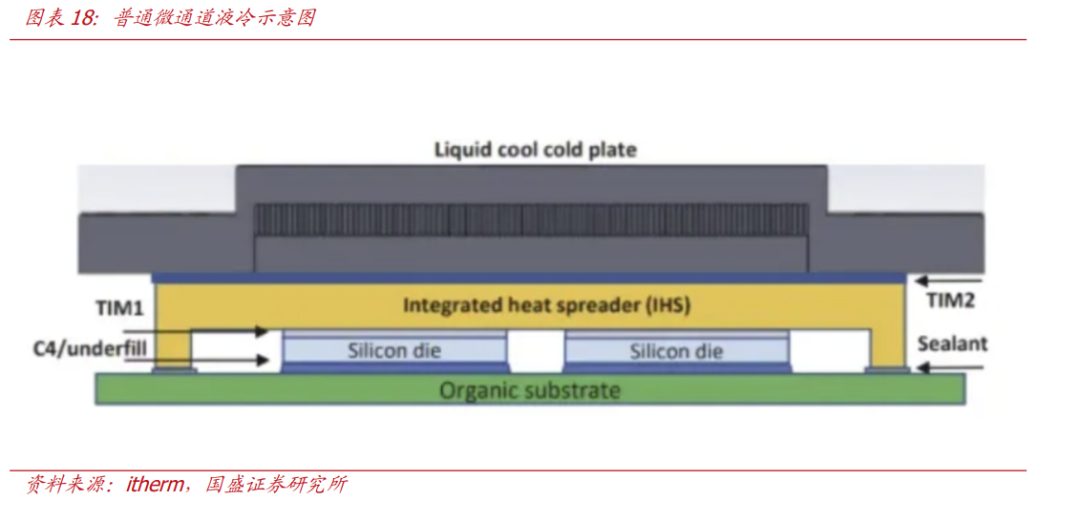

微通道液冷通过在基板集成微米级流道,实现对电子设备的高效冷却。微通道冷板为一块直接安装在需冷却的硬件组件上的高导热性材料(如铜、铝或复合材料)板料,内部加工有精密微流道,冷却液在微通道中高速流动带走芯片产生的热量。

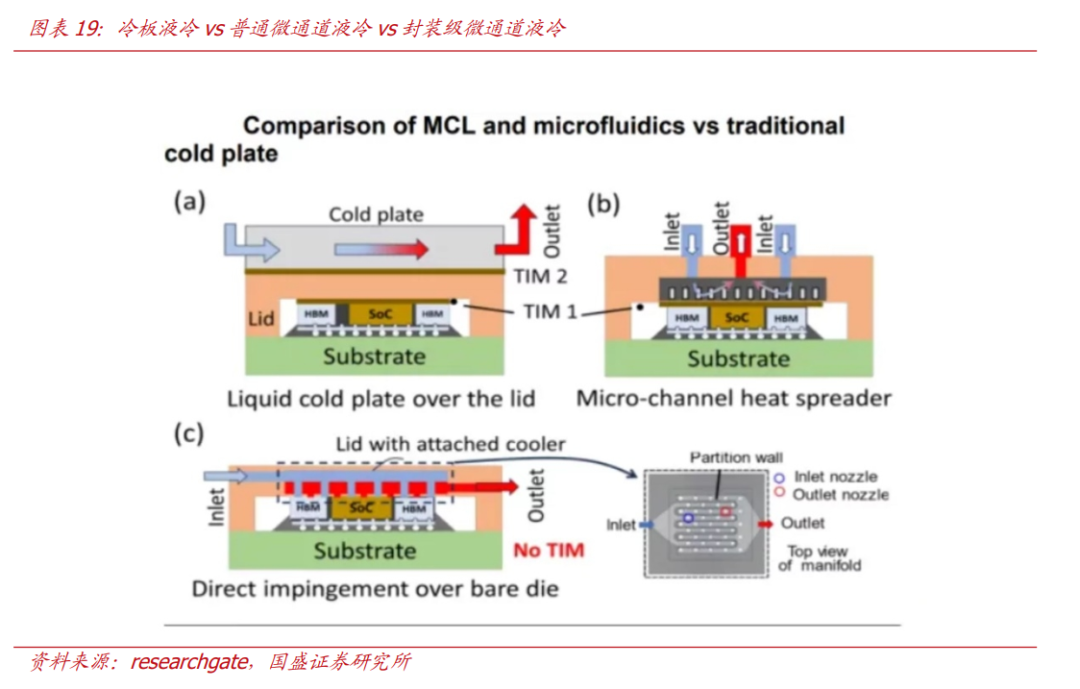

根据微通道冷板与芯片封装的集成关系,微通道液冷可分为普通微通道液冷和封装级微通道液冷两类。

普通微通道液冷:目前主流的应用形式,其冷板为独立于芯片封装的组件,通过导热界面材料(TIM)与芯片表面接触,冷却液在冷板内部的微流道中流动,通过TIM和冷板的双重导热作用带走热量。

封装级微通道液冷:是一种更先进的集成方案,其微通道直接加工在芯片封装内部或封装盖上,减少了传统的TIM层,使冷却液能够直接与芯片表面接触。这种设计将传热路径缩短至芯片-微通道冷却液的两层结构,是应对AI 芯片等超高功耗器件的理想选择。

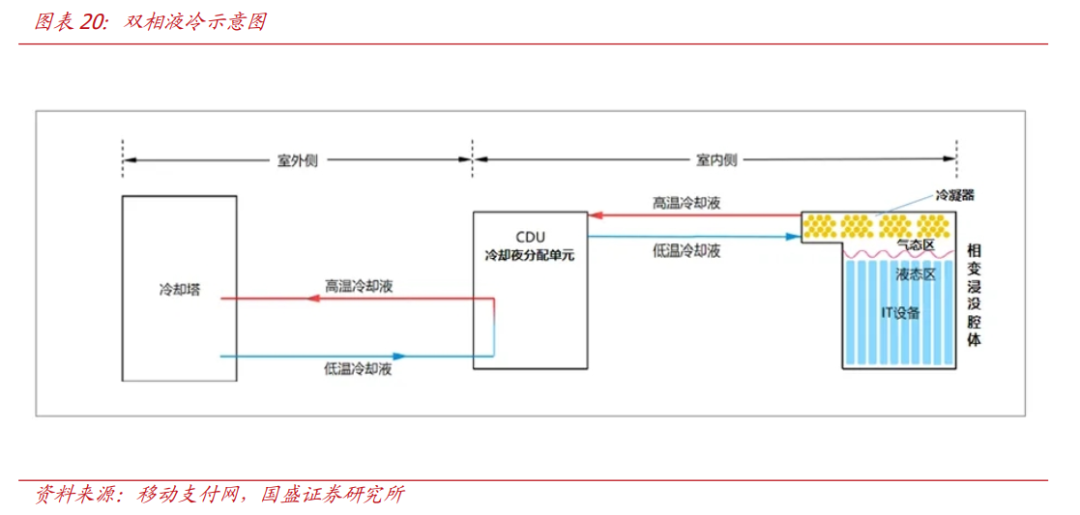

3.1.2 双相液冷

双相/两相指的是液冷剂在循环中经历液态和气态两个相态。当液冷剂接触到热的组件表面时迅速吸收热量蒸发成气体,然后被移动到冷凝器或换热器中重新变为液态,最后被送回到设备以继续循环。双相液冷系统散热效率更高,蒸发相变可以在更短的时间内有效吸收大量热量。

与目前主流的单项冷板液冷相比,双相液冷有以下区别:

核心工作原理:利用工质的相变潜热吸收热量,经历液-气相变循环;

散热效率:散热效率极高,单点散热能力远超单相方案;

系统复杂性:系统更复杂,对设计和制造要求极高。但工质多为绝缘、不导电的介质,即使泄漏也不会导致短路,硬件安全性更高;

冷却介质:使用特制的氟化化合物等,介质本身成本高昂。

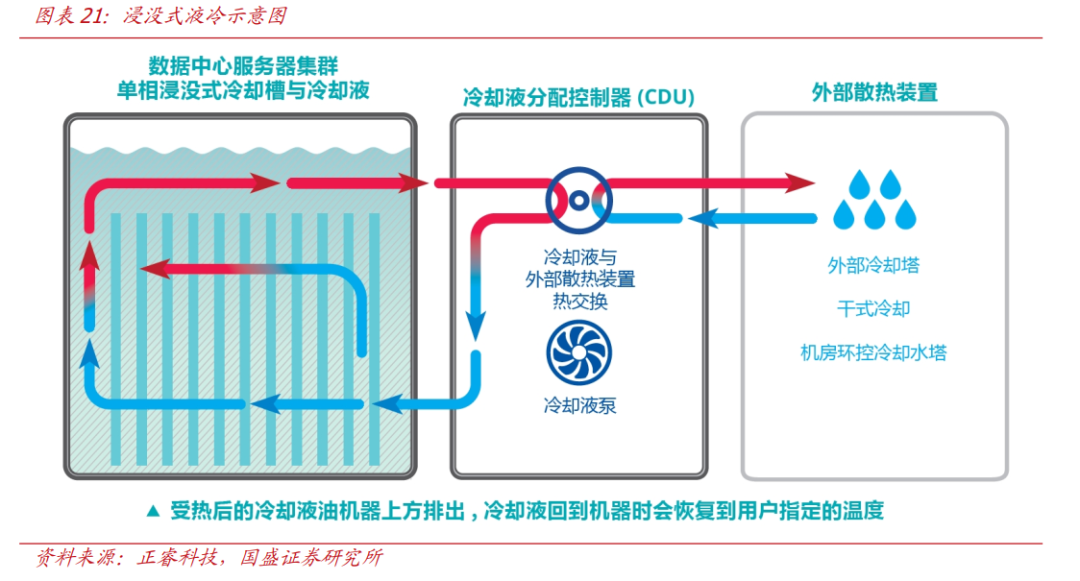

3.1.3 浸没式液冷

浸没式液冷是一种将服务器等电子设备完全浸没在不导电的冷却液(绝缘氟化液或合成油等)中进行直接散热的技术。是目前散热效率最高的液冷形式之一,但投资成本高昂,专用的绝缘冷却液价格昂贵。

浸没式液冷分为单相浸没和两相浸没。

单相浸没:冷却液始终保持液态,主要通过泵驱动循环。

双相(两相)浸没:冷却液吸热后沸腾气化,通过冷凝回流实现循环。

3.2 场景拓宽:从芯片到算力全系统

3.2.1 光模块:高速互连带来的新散热需求

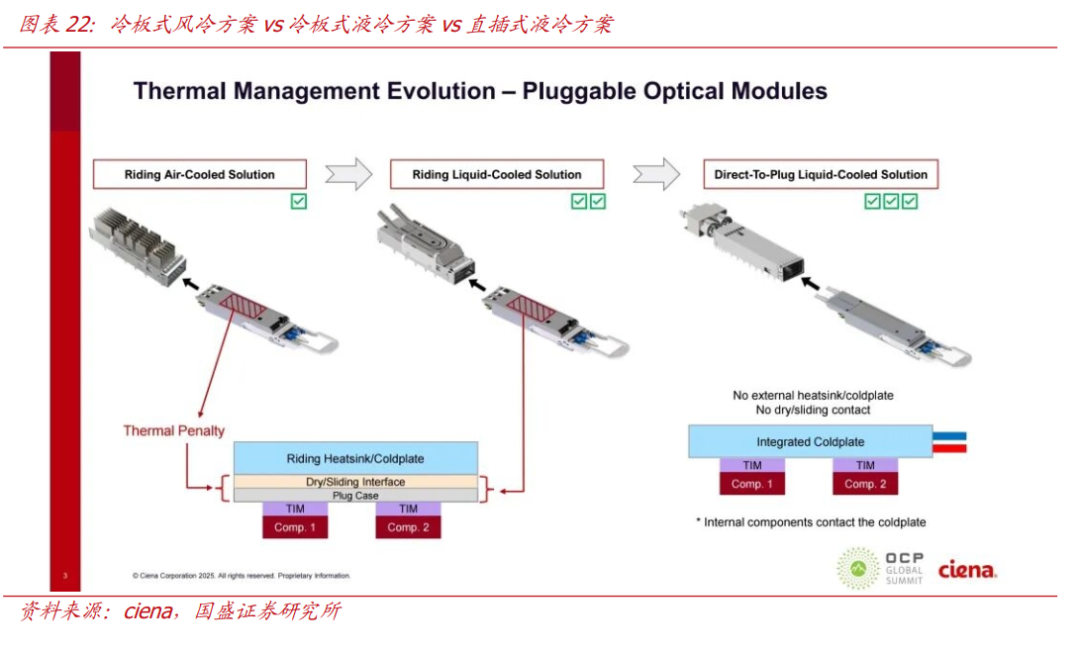

高速光模块紧凑的封装内部散热空间极为有限,热量快速累积易形成局部热点,业界正在积极探索和部署液冷散热方案。针对当前可插拔光模块的直接液冷方案包括以下几种:

顶部冷板式液冷方案:通过为光模块直接加装液冷冷板来应对极端热负载,未摆脱干接触界面的热阻损失。

直插式液冷方案:将冷板直接集成至光模块本体,取消外部散热片与冷板,消除干接触界面的热阻损失。模块内部组件直接与集成冷板接触,热量通过冷却液直接导出,实现散热效率飞跃。

完全浸没式液冷方案:直接浸没式冷却高速光模块。

Ciena推出光模块顶部冷板式、直插式液冷方案;光模块全球龙头中际旭创与东阳光已在液冷散热领域达成深度合作,可以预见,随着光互连速率和集成度的不断提升,液冷将成为保障数据中心高速通信稳定性的关键技术。

3.2.2 电源系统:被低估的液冷应用场景

随着AI服务器机柜功率密度飙升,电力系统中诸如大功率UPS、整流模块等关键设备的自身发热量也急剧增加。这些电源设备的高热流密度影响其可靠性和转换效率,为其配备独立的液冷散热成为业界最新的技术趋势。电源液冷解决方案包括:

在现有风冷电源的基础上通过外接一个风液换热器来冷却PSU风扇吹出的热风,以减少系统对外界数据中心环境的预热。

集中式风液换热器的解决方案:即对整机柜前后门进行封闭,在机柜底部布置一个集中式风液换热器,借助集中式结构替代PSU后置的分布式风液换热器结构。

综上,我们认为,伴随后续应用场景的拓宽,液冷有望从单一散热方案升级为算力系统级热管理平台,在系统中的地位将进一步前移,与电力、光通信共同成为AIDC的核心基础设施,显著拉长液冷产业链的生命周期,并抬升长期估值中枢。

4. 投资建议:强者恒强

液冷的技术形态与应用场景仍在持续演进。随着功率密度进一步抬升、算力系统复杂度提高,液冷技术正从冷板式向更高效的微通道、双相、浸没等方向发展;应用对象也有望从GPU/ASIC芯片,逐步拓展至光模块、电源等高功耗部件,成为算力系统的通用热管理基础设施。

液冷产业的竞争已从单一部件升级为涵盖设计、交付与运维的全链条系统能力。这一转变促使市场空间被系统性重估,并确立了“强者恒强”的产业格局——具备全栈解决方案能力、已获头部客户认证并拥有大规模交付经验的龙头企业,将成为此轮产业确定性红利的主要受益者。综上所述,我们看好英维克(液冷全链条 系统级龙头 出海先发优势),并建议关注申菱环境(海外市场拓展能力)、高澜股份(国际化布局)、飞龙股份(核心上游),科创新源(后道代工),东阳光(氟化物 部件)等。

VIP复盘网

VIP复盘网