摘要

我们在2025年9月的周报中介绍过光电路交换(OCS)技术,如今时点,OCS正走向从0到1的工程化落地,其在规模化能力提升、应用场景拓展和客户生态扩张三个维度有突破性进展,从谷歌独家走向行业AI基础设施的架构核心。

【规模化能力提升的量变与质变】

OCS正在经历从技术验证走向规模化部署的质变,其集群规模提升、产能与供应链规模化。

集群规模化:OCS的集群规模化能力体现在端口密度与集群规模的双重提升。当前阶段谷歌部署的OCS已达到300×300端口,并向更高端口数演进;OCS支撑的AI计算集群大小提升,谷歌TPU v4集群通过OCS互联形成4096卡大规模算力单元,TPU v7将芯片数量扩展至9216颗。

产能规模化:OCS的产能规模化正在从预期走向现实,供应链端出现明确的放量信号。Lumentum OCS开始放量,预计2025至2028年间,光电路交换机(OCS)出货量年复合增长率将超过150%,其积压订单超4亿美元。据界面新闻,全球OCS交换机出货量预计在2027/2028/2029年分别达到5万/20万/30万台,呈现爆发式增长态势。

【应用场景拓展,全场景渗透下沉】

OCS的应用场景正在经历从单一到多元、从局部到全域的扩张。OCS适配Scale-Up、Scale-Out、Scale-Across三大算力集群场景,有望实现全场景渗透下沉。

在Scale-Up(纵向扩展)层面,OCS定位为超节点内部高速互连的架构级解决方案。英伟达在OFC 2026上介绍了Feynman架构与OCS结合的“GW级AI工厂”网络方案,计划2028年实现芯片集成OCS,推动光交换从独立设备形态向片上系统演进。

在Scale-Out(横向扩展)层面,OCS实现AI集群的重构与优化。谷歌Ironwood机柜系统中,跨机柜通信全面采用OCS全光网络替代传统电交换架构。

在Scale-Across(跨数据中心扩展)层面,AI集群从单一数据中心走向跨数据中心分布时,传统OEO交换架构面临结构性压力,OCS提供的全光直通通道,在物理层实现了跨数据中心流量的“拓扑旁路”。

协同融合:OCS与多技术联动的系统级演进。OCS 与其他技术的协同融合成为该技术发展的重要趋势,通过与CPO、先进光DSP等技术的深度协同,实现网络性能的叠加优化,推动OCS向系统级解决方案的演进。

【客户拓展:从谷歌到全行业的生态扩张】

谷歌是OCS技术的开创者和规模化验证者。自研OCS已在多代TPU集群中规模化应用,2026年谷歌OCS需求约15000台300端口交换机,为产业链提供了稳定的产能支撑。

英伟达重磅入局,成产业走向落地的风向标。2026年OFC 上,英伟达Feynman架构将OCS纳入下一代网络方案,并计划于2028年实现芯片级OCS集成。

与此同时,微软、Meta其他云厂商正加速跟进。Coherent表示已拥有超过10个客户合作项目,预估潜在增量市场空间超过20亿美元,OCS的产业共识正在形成,从单一客户驱动转向多客户并行的扩张阶段。

【为什么必须上OCS?——唯一架构级解决方案】

OEO架构的根本性困境:传统以电子分组交换为核心的互连架构,数据流每经过一次交换机,都需要经历“光-电-光”(O-E-O)转换。这个过程带来了功耗墙、时延墙、带宽墙三大瓶颈。

OCS在物理层直接重构光路,光信号无需转换即可“直通”目标端口:

功耗下降:OCS的功耗仅与端口数相关、与信号传输速率无关,在万卡乃至十万卡集群中,这一差异决定了项目的经济可行性。

时延降低:OCS没有“存储-转发”机制,光信号在交换机内部的延迟仅为光在自由空间中的传播时间。

速率无关:OCS对信号速率“透明”,从800G到1.6T再到3.2T,只需升级两端光模块,交换设备本身无需更换,可以跨越多代光收发器使用。

当前,光电路交换(OCS)技术正从谷歌的独家部署走向全行业AI基础设施的架构核心,在规模化能力、应用场景和客户生态三个维度实现突破性进展。OCS之所以成为必须上的技术,根本原因在于传统OEO电交换架构面临瓶颈,OCS通过全光直通实现了功耗与速率解耦、纳秒级时延和跨代速率透明,是支撑更高功率GPU集群的架构级解决方案。

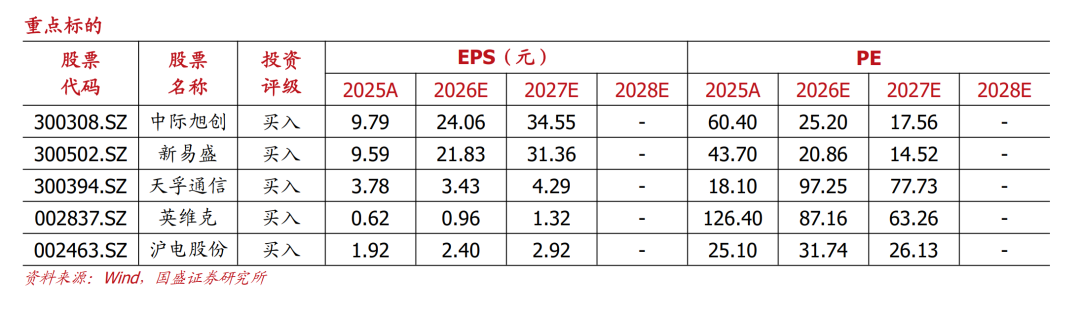

我们建议关注OCS相关标的:中际旭创、新易盛、天孚通信、腾景科技、德科立、威腾电气、光库科技、炬光科技等。

我们继续看好光 液冷 太空算力,这三个方向按产业发展阶段,其所对应的风险偏好依次提升。继续推荐算力产业链相关企业如光模块行业龙头中际旭创、新易盛等,同时建议关注光器件“一大五小”天孚通信 仕佳光子/太辰光/长芯博创/德科立/东田微,建议关注国产算力产业链,如其中的液冷环节如英维克、东阳光等。

建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、源杰科技、太辰光、腾景科技、可川科技、光库科技、光迅科技、德科立、联特科技、华工科技、剑桥科技、铭普光磁、东田微、优迅股份、长光华芯。铜链接:沃尔核材、精达股份。算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪、海光信息。液冷:英维克、申菱环境、高澜股份。边缘算力承载平台:美格智能、广和通、移远通信。卫星通信:中国卫通、中国卫星、顺灏股份、海格通信。

母线:威腾电气等。

数据要素——

运营商:中国电信、中国移动、中国联通。数据可视化:浩瀚深度、恒为科技、中新赛克。

风险提示:AI发展不及预期,算力需求不及预期,市场竞争风险。

1.投资策略:

再看OCS—从0到1,走向架构核心

本周建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、源杰科技、太辰光、腾景科技、可川科技、光库科技、光迅科技、德科立、联特科技、华工科技、剑桥科技、铭普光磁、东田微、优迅股份、长光华芯。

算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪、海光信息。

母线:威腾电气等。

数据要素——

本周观点变化:

本周海外算力板块走势较为强势。从整体市场看,美股三大指数本周均上涨,纳斯达克指数累计上涨4.4%,标普500指数涨3.4%。AI芯片股温和上涨,英伟达本周股价累计上涨5.9%,博通本周股价累计上涨4.6%,AMD本周股价累计上涨7.7%。受益于光纤涨价和OCS需求催化,光通信板块表现更为强劲,Lumentum股价本周累计上涨17.7%,coherent股价本周累计上涨6%。

我们继续看好光 液冷 太空算力,这三个方向按产业发展阶段,其所对应的风险偏好依次提升。继续推荐算力产业链相关企业如光模块行业龙头中际旭创、新易盛等,同时建议关注光器件“一大五小”天孚通信 仕佳光子/太辰光/长芯博创/德科立/东田微,建议关注国产算力产业链,如其中的液冷环节如英维克、东阳光等。

2. 行情回顾:通信板块上涨,光通信表现相对最优

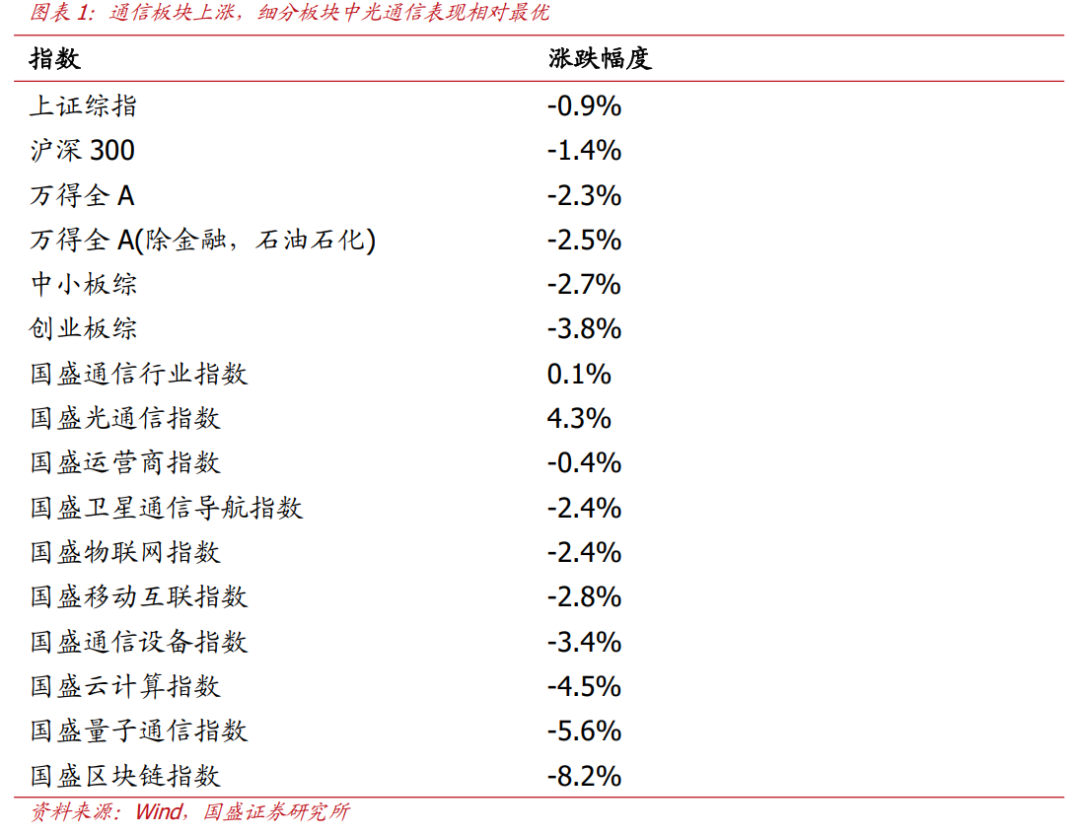

2026年03月30日-2026年04月05日上证综指收于3880.10点。各行情指标从强到弱依次为:上证综指>沪深300>万得全A>万得全A(除金融,石油石化)>中小板综>创业板综。通信板块上涨,表现强于上证综指。

从细分行业指数看,光通信上涨4.3%;运营商、卫星通信导航、物联网、移动互联、通信设备、云计算、量子通信、区块链分别下跌0.4%、2.4%、2.4%、2.8%、3.4%、4.5%、5.6%、8.2%。

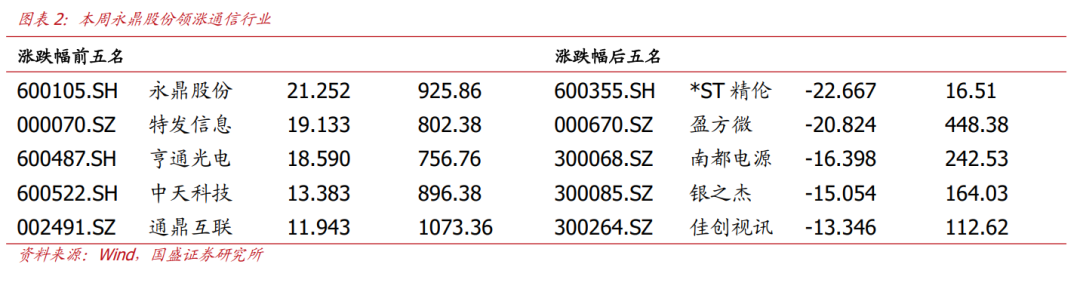

本周受益于光纤概念,永鼎股份上涨21%,领涨板块;受益于光纤概念,特发信息上涨19%;受益于光纤概念,亨通光电上涨19%;受益于光纤概念,中天科技上涨13%;受益于光纤概念,通鼎互联上涨12%。

3. 再看OCS—从0到1,走向架构核心

我们在2025年9月的周报中介绍过光电路交换(OCS)技术,如今时点,OCS正走向从0到1的工程化落地,其在规模化能力提升、应用场景拓展和客户生态扩张三个维度有突破性进展,从谷歌独家走向行业AI基础设施的架构核心。

【规模化能力提升的量变与质变】

OCS正在经历从技术验证走向规模化部署的质变,其集群规模提升、产能与供应链规模化。

集群规模化:OCS的集群规模化能力体现在端口密度与集群规模的双重提升。当前阶段谷歌部署的OCS已达到300×300端口,并向更高端口数演进;OCS支撑的AI计算集群大小提升,谷歌TPU v4集群通过OCS互联形成4096卡大规模算力单元,TPU v7将芯片数量扩展至9216颗。

产能规模化:OCS的产能规模化正在从预期走向现实,供应链端出现明确的放量信号。Lumentum OCS开始放量,预计2025至2028年间,光电路交换机(OCS)出货量年复合增长率将超过150%,其积压订单超4亿美元。据界面新闻,全球OCS交换机出货量预计在2027/2028/2029年分别达到5万/20万/30万台,呈现爆发式增长态势。

【应用场景拓展,全场景渗透下沉】

OCS的应用场景正在经历从单一到多元、从局部到全域的扩张。OCS适配Scale-Up、Scale-Out、Scale-Across三大算力集群场景,有望实现全场景渗透下沉。

在Scale-Up(纵向扩展)层面,OCS定位为超节点内部高速互连的架构级解决方案。英伟达在OFC 2026上介绍了Feynman架构与OCS结合的“GW级AI工厂”网络方案,计划2028年实现芯片集成OCS,推动光交换从独立设备形态向片上系统演进。

在Scale-Out(横向扩展)层面,OCS实现AI集群的重构与优化。谷歌Ironwood机柜系统中,跨机柜通信全面采用OCS全光网络替代传统电交换架构。

在Scale-Across(跨数据中心扩展)层面,OCS可用于数据中心互联与城域网络。AI集群从单一数据中心走向跨数据中心分布时,传统OEO交换架构面临结构性压力,OCS提供的全光直通通道,在物理层实现了跨数据中心流量的“拓扑旁路”。

协同融合:OCS与多技术联动的系统级演进。OCS 与其他技术的协同融合成为该技术发展的重要趋势,通过与CPO、先进光DSP等技术的深度协同,实现网络性能的叠加优化,推动OCS向系统级解决方案的演进。

【客户拓展:从谷歌到全行业的生态扩张】

谷歌是OCS技术的开创者和规模化验证者。自研OCS已在多代TPU集群中规模化应用,2026年谷歌OCS需求约15000台300端口交换机,为产业链提供了稳定的产能支撑。

英伟达重磅入局,成产业走向落地的风向标。2026年OFC 上,英伟达Feynman架构将OCS纳入下一代网络方案,并计划于2028年实现芯片级OCS集成。

与此同时,微软、Meta其他云厂商正加速跟进。Coherent表示已拥有超过10个客户合作项目,预估潜在增量市场空间超过20亿美元,OCS的产业共识正在形成,从单一客户驱动转向多客户并行的扩张阶段。

【为什么必须上OCS?——唯一架构级解决方案】

OEO架构的根本性困境:传统以电子分组交换为核心的互连架构,数据流每经过一次交换机,都需要经历“光-电-光”(O-E-O)转换。这个过程带来了功耗墙、时延墙、带宽墙三大瓶颈。

OCS在物理层直接重构光路,光信号无需转换即可“直通”目标端口:

功耗下降:OCS的功耗仅与端口数相关、与信号传输速率无关,在万卡乃至十万卡集群中,这一差异决定了项目的经济可行性。

时延降低:OCS没有“存储-转发”机制,光信号在交换机内部的延迟仅为光在自由空间中的传播时间。

速率无关:OCS对信号速率“透明”,从800G到1.6T再到3.2T,只需升级两端光模块,交换设备本身无需更换,可以跨越多代光收发器使用。

当前,光电路交换(OCS)技术正从谷歌的独家部署走向全行业AI基础设施的架构核心,在规模化能力、应用场景和客户生态三个维度实现突破性进展。OCS之所以成为必须上的技术,根本原因在于传统OEO电交换架构面临瓶颈,OCS通过全光直通实现了功耗与速率解耦、纳秒级时延和跨代速率透明,是支撑更高功率GPU集群的架构级解决方案。

我们建议关注OCS相关标的:中际旭创、新易盛、天孚通信、腾景科技、德科立、威腾电气、光库科技、炬光科技等。

我们继续看好光 液冷 太空算力,这三个方向按产业发展阶段,其所对应的风险偏好依次提升。继续推荐算力产业链相关企业如光模块行业龙头中际旭创、新易盛等,同时建议关注光器件“一大五小”天孚通信 仕佳光子/太辰光/长芯博创/德科立/东田微,建议关注国产算力产业链,如其中的液冷环节如英维克、东阳光等。

4.龙芯联手台达、汉腾发布国产 CPU 集装箱式 SST 直流移动智算中心

据IT之家报道,龙芯中科、台达电子、汉腾科技三方于3月28日联合发布了集装箱式 SST(固态变压器)直流移动智算中心。这款模块化算力系统配备了龙芯 3C6000 国产 CPU 和太初、登临、天数等国产 AI 加速卡。

该硬件平台采用 800V HVDC 供电架构,利用台达供应的 SST 固态变压器将 10kV 市电直接转化为 800V DC,转换效率达 98.5%,系统整体 PUE 低至 1.15。

集装箱式 SST 直流移动智算中心支持复杂数据分析、100B 级参数 AI 模型推理等多种负载,确保在脱离传统大型数据中心环境下依然能获得充沛且自主可控的算力资源,可广泛应用于应急保障与抢险救灾、偏远地区与野外作业、工业与基础设施巡检等传统固定数据中心难以覆盖或需快速响应的前沿场景。

5.英伟达围绕 NVLink Fusion 与 Marvell 展开合作,并向后者投资 20 亿美元

据IT之家报道,3月31日,NVIDIA 英伟达宣布围绕 NVLink Fusion 与 Marvell 美满展开建立战略合作伙伴关系,并向后者投资 20 亿美元(IT之家注:现汇率约合 138.41 亿元人民币)。

Marvell 将提供定制的 XPU 和与 NVLink Fusion 兼容的纵向扩展 (Scale Up) 网络。其 AI ASIC 客户可凭借 NVLink Fusion IP 将自有芯片与英伟达 GPU、LPU、网络、存储无缝集成,形成为完全兼容的异构 AI 基础架构。

两家公司还将在电信领域合作,利用英伟达 Aerial AI-RAN for 5G/6G 将全球电信网络转变为 AI 基础设施,并推进世界一流的 AI 网络,包括先进的光互连解决方案和硅光子技术。

NVIDIA 创始人兼首席执行官黄仁勋表示:“推理转折点已经到来。代币生成需求激增,全球都在竞相构建人工智能工厂。我们与 Marvell 携手,帮助客户利用英伟达的人工智能基础设施生态系统,并扩展规模以构建专用人工智能计算。”

Marvell 董事长兼首席执行官 Matt Murphy 表示:“我们与 NVIDIA 扩大合作,体现了高速连接、光互连和加速基础设施在人工智能扩展中日益增长的重要性。通过 NVLink Fusion,我们将 Marvell 在高性能模拟、光学 DSP、硅光子学和定制芯片领域的领先优势与 NVIDIA 不断扩展的人工智能生态系统连接起来,从而帮助客户构建可扩展、高效的人工智能基础设施。”

6.从实验室到现网,空芯光纤加速迈向商用

据C114网报道,随着AI算力需求迅猛增长,网络容量不断攀升,呼唤超大带宽、超低时延传输能力。空芯光纤以其低时延、宽频谱、低损耗和低非线性效应等独特优势,受到业界的密切关注,国内外均在加快布局,并推进现网试点和商用。

空芯光纤前景广阔。空芯光纤能降低网络时延、拥有超宽传输频谱、非线性效应降低3-4个数量级并降低传输损耗,是构建未来光网络的理想选择。鉴于空芯光纤的特性,可以在超低时延超大容量的AI算力网络中显著提升AI训练效率。

超低时延的金融行业应用中毫秒必争、微秒必争。另外,空芯光纤可为量子密钥分发提供稳定低损耗传输通道,6G则需要超低时延、超大带宽、超大规模连接,空芯光纤有潜力成为关键传输介质。

如果空芯光纤价格足够低,在PON网络中,空心光纤超低损耗的特性可以实现更高的功率入纤,大幅提升分光比。另外,在5G/6G前传中,空芯光纤可以同时传输信号和能量,实现信能共传。

在产业界的共同努力下,空芯光纤技术不断进步,在衰减、IMI、气体吸收峰强度降低与低损耗带宽增加方面取得飞速进展。目前,衰减系数已经达到0.04dB/km,模间干扰保持在-65dB/km,单根预制棒拉丝长度超过91.2公里。另外,空芯光纤成本也实现了量级下降,生产良率提升超10倍。

产业链生态日渐完善。空芯光纤已经展现出良好的应用前景,即使存在诸多挑战,产业链也将一一克服。一方面需要攻坚核心技术,另一方面要建设产业生态、联合制定统一标准、探索应用场景。

相比传统实心光纤,空芯光纤性能卓越,同时也为测试带来了新挑战。例如传统实心光纤和空芯光纤的连接测试;空芯光纤熔接损耗高,熔接难定义衰耗值;全新的结构,带来了弯曲和应力的影响;波长传输窗口多,测试更加复杂,等等。

试点不断,成效显著。截至2026年4月,过去一年多时间,国内三大运营商都开启了空芯光纤在现网试点,共发标6次,部署超过1500芯公里。

7.1220亿美元!OpenAI完成史上最大规模融资 AI资本狂热再攀新高

据C114网报道,人工智能领域的资本狂热再攀新高。OpenAI宣布,已完成新一轮1220亿美元融资,投后估值达到8520亿美元。这一数字不仅刷新了硅谷历史上的单轮融资纪录,更使这家人工智能明星企业距离万亿市值俱乐部仅一步之遥。

根据OpenAI发布的公告,本轮融资由亚马逊、英伟达和软银等战略合作伙伴领投,长期合作伙伴微软也继续参与。软银与a16z、D. E. Shaw Ventures、MGX、TPG以及T. Rowe Price Associates, Inc旗下机构共同领投。值得一提的是,OpenAI首次通过银行渠道向个人投资者开放了参与机会,筹集超过30亿美元,显示出AI投资热潮已从机构端向零售端蔓延。

本次融资规模较2026年2月宣布的1100亿美元承诺资本进一步扩大,新增资金主要来自更广泛的投资者群体。自2015年成立以来,OpenAI已累计完成约12轮融资,融资总额约1680亿美元。OpenAI同时透露,公司将被纳入ARK Invest管理的多只交易所交易基金,此举将进一步拓宽其股权结构,为后续IPO铺路。

财务数据方面,OpenAI展现出惊人的增长轨迹。公司目前月收入已达20亿美元,较2025年底实现翻倍,其2024年全年收入为131亿美元。但公司仍未实现盈利——据《卫报》等媒体披露,其运营成本主要来自模型训练和基础设施建设,若保持当前投入节奏,到2030年累计支出将达到5000亿美元。

市场表现层面,ChatGPT已拥有超过9亿周活跃用户和逾5000万订阅者,稳居消费级AI应用首位。更重要的是,企业客户贡献的收入占比已突破40%,有望在2026年底前与消费者业务持平。这一结构性变化印证了AI正从消费端应用向企业级基础设施加速渗透的产业趋势。

本轮天量融资恰逢行业竞争格局重塑的关键节点。随着Anthropic凭借Claude Code产品在开发者市场建立优势,OpenAI进行了战略调整,将产品重心收窄至编码工具和企业客户,并关闭了独立的Sora视频应用。其更新的Codex编程智能体周活用户已突破200万,3个月内增长五倍,显示出对竞争态势的快速响应能力。

技术迭代方面,OpenAI发布了号称“能力最强”的GPT-5.4模型,其API处理能力达到每分钟150亿token。公司同时宣布将构建统一的人工智能超级应用,整合ChatGPT、Codex、浏览等功能于单一界面。这一战略布局意在解决模型能力提升后用户体验碎片化的痛点,被视为其从“模型提供商”向“应用平台”转型的关键一步。

本轮融资还包含一项约47亿美元的循环信贷额度,由摩根大通、花旗、高盛等全球顶级金融机构组成的银团提供支持,目前尚未提取。

8.Arm 计划在中国销售 AGI CPU,首席执行官 Rene Haas 认为需求与其他市场一样强劲

据IT之家报道,Arm 首席执行官 Rene Haas于3月31日接受《中国日报网》采访,谈及公司发布的首款自研处理器 AGI CPU。

Rene Haas 对此表示,AGI CPU 符合在中国销售的条件,且公司也有意推进相关事项。

他说道:“目前我们还没有可以公开讨论的客户,但我们预计这款产品在中国的需求将与全球其他市场一样强劲。”

同时 Arm 表示,Meta Platforms 将成为这款新处理器的首个客户,有望在未来五年内带来 150 亿美元(现汇率约合 1032.87 亿元人民币)收入。

作为参考,Arm AGI CPU 基于台积电 3nm 制程工艺打造,拥有 136 个 Neoverse V3 核心,拥有 136 个基于 Neoverse V3 微架构的内核,频率可达 3.7GHz,每核配备 2MB L2 缓存,TDP 可达 300W。

这款处理器支持 DDR5-8800 内存,单核心内存带宽达 6GB/s(IT之家注:数据与主板参考图均指向 12 通道设计);可扩展出 96 条 PCIe 通道,支持 CXL 3.0 规范。

9.SEMI:未来四年 12 英寸晶圆厂设备支出持续增长,明年首破万亿人民币

据IT之家报道,国际半导体产业协会 SEMI 于4月1日表示,2026~2029 年全球 300mm(12 英寸)晶圆厂设备支出将持续增长,增幅分别为 18%、14%、3%、11%,分别达到 1330 亿美元、1510 亿美元、1550 亿美元、1720 亿美元。

SEMI 总裁兼首席执行官 Ajit Manocha 表示:“人工智能正在重塑半导体制造投资的规模。预计到 2027 年,全球 300mm 晶圆厂设备的支出将首次超过 1500 亿美元(IT之家注:现汇率约合 1.03 万亿元人民币),这标志着半导体行业正在对先进产能和弹性供应链做出历史性的、持续的承诺,以推动人工智能时代的到来。”

从 2027 到 2029 年,逻辑与微器件领域的设备投资将合计达 2280 亿美元,这主要受到对 2nm 及以下尖端逻辑制程投资的推动;而其它领域的需求也将温和增长,推动成熟制程投资。

存储器领域的 12 英寸晶圆厂设备三年合计支出则将达 1750 亿美元,其中 DRAM 占到 1100 亿美元,3D NAND 则为 620 亿美元,在存储器细分领域的占比分别为 62.86% 和 35.43%。

10.英特尔142亿美元回购爱尔兰晶圆厂49%股份

据C114网报道,4月2日,英特尔宣布达成协议,以142亿美元的价格从美国投资公司手中回购其爱尔兰Fab 34晶圆厂49%的股份。交易完成后,这座工厂重新归英特尔全资所有。

交易的资金来源包括其手头现金及约65亿美元的新增债务。

阿波罗全球管理公司(Apollo Global Management)于2024年投资112亿美元,由此促成了双方的合资合作。

英特尔表示,交易为其提供了财务灵活性,以加速在欧洲和美国的先进制造工艺布局。

这家芯片制造商解释称,随着人工智能时代对CPU需求的增长,此次回购反映了其更强劲的资产负债表、更严格的财务纪律以及对长期战略的信心。Fab 34是采用Intel 3和Intel 4生产工艺生产酷睿Ultra、至强6处理器及其他产品的关键基地。

自2025年3月出任英特尔首席执行官后,陈立武(Lip-Bu Tan)已着手削减公司员工人数、运营成本及资本支出,作为扭亏为盈计划的一部分。

2025年8月,美国政府及总统唐纳德·特朗普(Donald Trump)与英特尔达成协议,获得其10%的股权——此前特朗普曾公开要求陈立武辞职。

此外,英伟达以50亿美元投资获得英特尔4%的股份,也进一步提振了该公司的盈利水平。

11.LightCounting:到2030年,AI光互连市场有望冲击1000亿美元?

据C114报道,光通信市场研究机构LightCounting在最新的报告中表示,到2030年,AI集群使用的光互连产品的年销售额有希望达到1000亿美元。不过,要实现这一目标,需要“天时地利人和”,诸多因素必须完美契合。

2024年,以太网光模块的销售额翻了一番,2025年又增长了70%,远超预期。InP激光器供应商去年已扩充产能以应对日益增长的需求,目前这些器件以及其他许多用于光模块制造的器件短缺状况正在缓解。

2026年,光模块的产能足以支撑销售额翻倍,但这将超过客户的实际需求。由于XPU(各类加速器)和交换机ASIC芯片的短缺将限制2026年AI集群的扩张,除非客户建立大量的库存储备,否则2026年光模块的销售额增长将被限制在“仅”60%左右。

LightCounting表示,大多数周期是由供应链再平衡引起的,预计可能会在2027年-2028年看到类似的情况。LightCounting的预测倾向于“软着陆”,但供应链平衡往往是通过市场修正来实现的,也就是“波动”(Bumpy Ride)的情景。

12.风险提示

AI发展不及预期,算力需求不及预期,市场竞争风险。

VIP复盘网

VIP复盘网