超节点产业进入规模落地期。1)大模型训练与推理对Scale-up域刚性需求显现。大模型万亿参数与MoE架构确立新常态,专家并行(EP)带来的高频All-to-All通信对互联带宽提出极致要求。传统Scale-out集群面临通信、功耗与复杂度的物理硬约束,在此背景下,具备大带宽与内存统一编址能力的Scale-up超节点正式成为新一代智算基建的核心底座。2)供给端:海内外厂商超节点产品密集发布。产业供给端已步入密集兑现期,海外英伟达GB200 NVL72整机架处于满负荷运行状态,并向NVL576加速演进;国内阵营全面起势,华为CM384进入工程化交付阶段,中科曙光(scaleX640/40)、百度(天池256/512)、阿里(磐久128)等头部厂商的机柜级超节点产品相继发布或商用。供需双侧强逻辑共振,印证超节点产业已跨越技术验证期,全面开启规模化落地。

集群化交付推动ODM厂商毛利率结构性抬升。交付单元从单台白盒服务器跃迁为整机柜乃至Pod级系统交付,整机柜在供电架构、散热、互联三个维度均形成显著工程壁垒,使超节点的研发与交付成为对厂商技术、运维、工程能力的综合性挑战。当交付复杂度提升、合格供应商稀缺时,头部ODM具备向客户转移工程溢价的实际能力,毛利率有望向更高区间迁移。

超节点整机柜的设计需解决高密度GPU协同工作的挑战,多环节价值量有望显著提升。核心设备厂商正依托深厚的技术卡位,迈入业绩兑现周期:1)浪潮信息双线布局超节点矩阵,先后发布元脑SD200与CRS6000S服务器,实现单机柜32/64张本土AI芯片的超高密部署,其构建的32卡Scale-up高速互联域将卡间通信带宽大幅提升8倍,推动千亿参数大模型训练周期由月级实质性压缩至周级。此外,公司牵头组建超节点创新联合体打造“北京方案”,联合产业链攻坚互连协议与应用落地,实质性打通超节点规模化部署的“最后一公里”;2)华勤技术凭借计算、网络与液冷散热的全栈设计壁垒,其超节点项目预计于今年第二季度开始发货并于下半年步入规模化交付,2026全年相关收入指引超百亿元,加速确立行业领先身位。

风险提示

行业竞争加剧的风险;技术研发进度不及预期的风险;特定行业下游资本开支周期性波动的风险。

目录

一、超节点产业进入规模落地期

1.1 需求端:大模型训练与推理对Scale-up域刚性需求显现

1.2 供给端:海内外厂商超节点产品密集发布

二、超节点驱动产业链价值量重估的核心原因

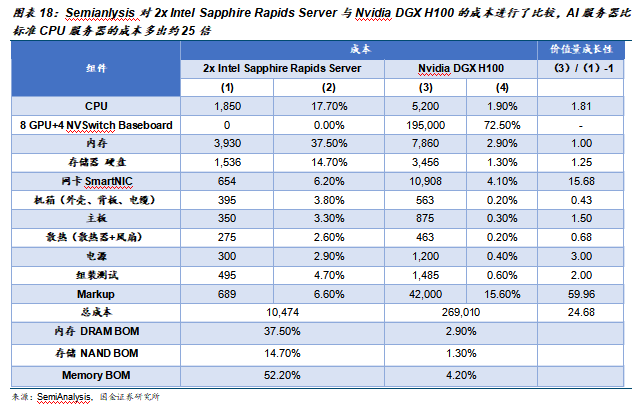

2.1 价值量跃迁:AI服务器相对通用服务器整机价值量约25倍,增量在环节间呈现显著梯度分化

2.2 集群化交付推动ODM厂商毛利率结构性抬升

风险提示

正文

一、超节点产业进入规模落地期

1.1 需求端:大模型训练与推理对Scale-up域刚性需求显现

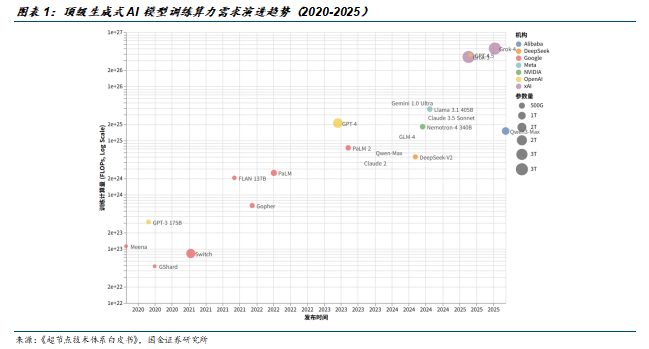

万亿参数成为标配,大模型持续沿Scaling Law演进。1)参数规模方面:2020年GPT-3参数规模为1750亿,2023年GPT-4参数规模跃迁至约1.8万亿,2025年Llama-4、Kimi K2、xAI Grok4等模型将万亿级参数与万卡级集群规模确立为新常态,Claude Mythos 5参数量进一步突破10万亿级。2)数据量方面:Qwen 2.5-Max训练数据量超过20万亿token,DeepSeek-V3训练数据量约14.8万亿,AI模型大模型面向的任务场景日趋丰富,数据量加码下泛化能力得以提升。参数规模与数据量双向增长下,2020-2025年大模型训练算力需求激增近1000倍,模型参数量的增长带动训练训练成本倍数级增长,前沿模型训练成本每年约2–3倍增长,至2027年或超10亿美元,对基础设施端提出挑战。

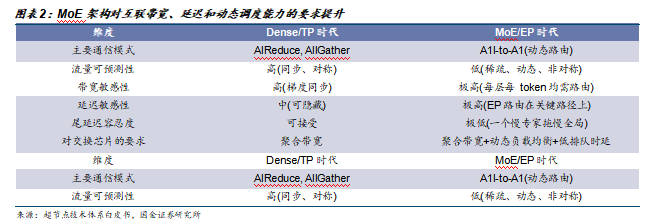

MoE架构全面普及,推高高频All-to-All通信需求。2024-2025年以DeepSeek-V2/V3 为代表的MoE架构兴起,目前GLM-5.1、Kimi K2.5、Gemini 3.1 Pro、Llama 4等前沿大模型均基于MoE架构。MoE架构引入的专家并行(EP)要求高频All-to-All通信,即每个token需要被路由到少量专家,且路由结果高度动态,流量模式呈现不可预测的稀疏多播特征,推高算力需求的同时,对互联带宽、延迟和动态调度能力提出了远超传统架构的要求。

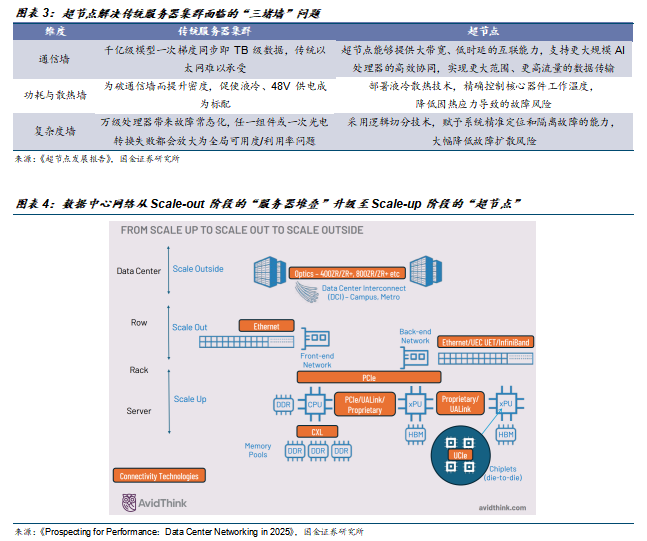

传统服务器集群面临通信墙、功耗墙、复杂度墙三大瓶颈:千亿级模型一次梯度同步即TB级数据,传统以太网难以承受;高密度AI芯片推高功耗,传统风冷无法满足散热需求;万级处理器带来故障常态化,放大传统集群运维复杂度。传统服务器集群基于Scale-out架构,通过通用以太网连接大量标准化服务器,张量并行(TP)、流水并行(PP)和序列并行(CP)产生大量跨节点网络通信,跨服务器的带宽与时延成为根本瓶颈,制约模型训练效率提升。

Scale-up超节点突破Scale-out计算瓶颈,成为新一代算力基础单元。超节点基于Scale-up理念,将多颗AI处理器通过大带宽总线互联形成一个逻辑上的超节点,实现计算资源的紧密耦合和高效协同,天然适配MoE通信密集型模型架构,且基于Scale UP总线的超节点,大模型训练速度可提升20%以上。超节点提供大带宽、低时延的互联能力,内存统一编址可避免传统架构中跨节点内存访问的性能骤降问题,同时标配液冷、集中供电、RMC管理,使得数十万亿参数训练成为可能。

1.2 供给端:海内外厂商超节点产品密集发布

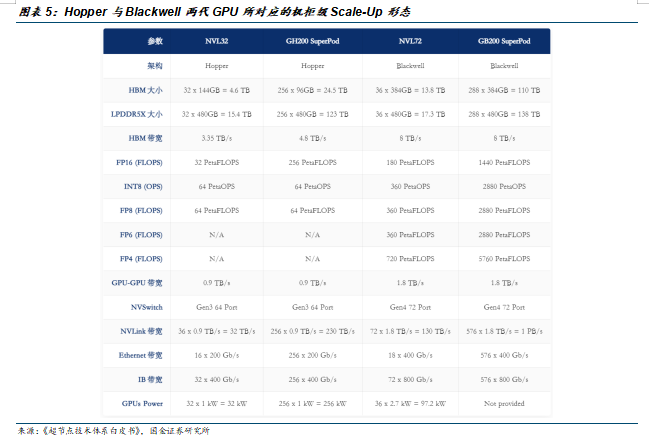

NVIDIA为服务器到机柜级计算机的先行者。回顾从Volta到Rubin系列的演进,NVIDIA的技术战略非常清晰:通过算力、互联、存储和封装等多个维度的协同创新,实现系统层面的指数级性能增长。2020年,NVIDIA在其推出的HGX-A100系统中,通过第二代NVSwitch将两个八卡A100以背板方式连接,构成一个16卡系统;2022年,随Hopper架构推出的第三代NVSwitch支持更灵活的组网方式,能够实现32颗GH200(32xGPU)的互联(NVL32);2024年Blackwell发布时,第四代NVSwitch能够实现36个GB200超级芯片(共72颗GPU)的互联(NVL72),并形成DGX GB200 SuperPod等机柜级产品形态;未来的VeraRubin系列将进一步实现更大规模的互联。

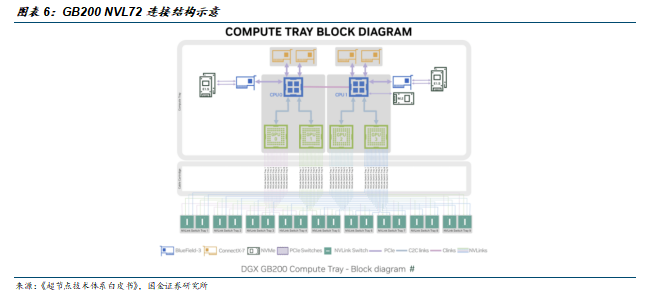

GB200引发范式转移,标志互连结构从单服务器内部进一步扩展到整机架一级域。从GB200 NVL72的架构来看,在交换平面一侧,NVL72机架包含9个NVLink switch trays,每个switch tray含2个NVLink switch chips,因此整机架共有18个switch chips。每个B200 GPU具有18条NVL5 links,并采用“每个GPU对每个switch chip 1条链路”的连接方式。换言之,单个GPU会连接机架中的全部18个switch chips;相应地,单个switch chip会连接整机架全部72个GPU,各1条链路。GB200 NVL72及后续将扩展的576GPU,标志着互联结构从单节点NVSwitch走向机架级NVLink域。

英伟达GB200 NVL72放量,整机架市场需求高涨。2025年11月,在英伟达第三季度财报电话会上,公司表示第三季度公司的业绩增长由Blackwell架构的持续增长势头推动,且GB300的收入占Blackwell总收入的比例超过了GB200,达到约三分之二,GB300已向大多数主要云服务提供商、超大规模云计算厂商和GPU云平台批量出货,此外公司预计从2025年年初到2026年12月,Blackwell和Rubin平台的收入将达到5000亿美元。而根据2026年2月英伟达第四季度财报电话会,目前各大云计算服务商、超大规模云计算企业、AI模型研发商和企业客户部署的Blackwell架构基础设施,算力已达90亿瓦,且处于满负荷运行状态。

Rubin Ultra NVL576路线图明确。NVIDIA Vera Rubin Ultra引入了新的两层 all-to-all NVLink拓扑,使开发者能够扩展到576个GPU。Vera Rubin Ultra NVL576将8个独立的MGX NVL机架 (每个机架配有72个Rubin Ultra GPU) 组合在一起,并通过铜缆和直接光纤连接在一个576-GPU NVLink域中。

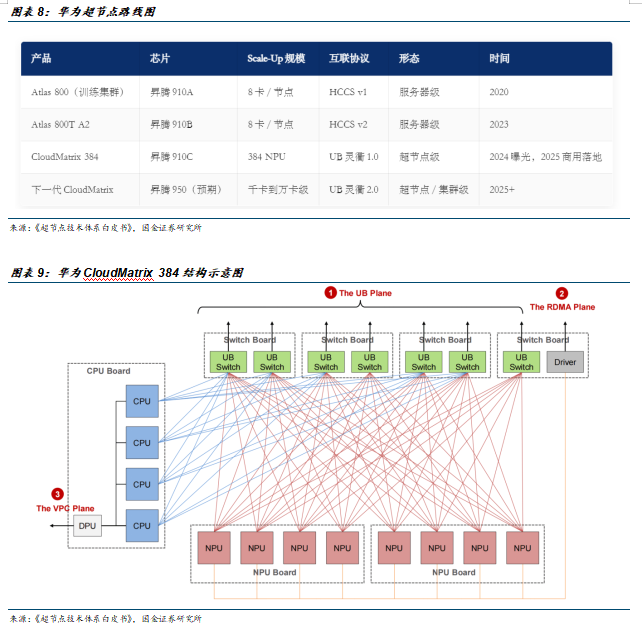

华为是国内较早将AI集群从八卡服务器推进到超节点形态的厂商之一。其产品演进大致经历了三个阶段:第一阶段是以Atlas 800为代表的服务器级训练系统,核心特征是基于昇腾910A和HCCS的节点内高速互联;第二阶段是Atlas 800T A2等面向昇腾910B的8卡系统,继续沿用节点级高带宽互联,并逐步完善软件栈与交付体系;第三阶段则是CloudMatrix 384,将互联范围从单节点扩展到多柜一体化超节点,把Scale-Up域从传统的8卡或16卡级别提升到384 NPU级别。

CM384的基本思路是把芯片、节点和超节点三个层级组织为同一个连续的高带宽域:芯片层负责提供计算与本地存储能力,节点层负责将8个NPU与CPU、交换芯片组织为单层UB平面,超节点层再通过多柜互联将48个计算节点组合为一个二层UB域。

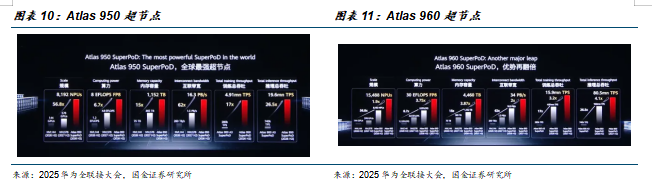

CM384超节点进入工程化交付阶段,后续超节点产品演进路线清晰。截至2025年,CloudMatrix 384已在多个智算中心公开落地或披露部署,包括芜湖、贵安、乌兰察布以及中国电信粤港澳大湾区(韶关)等站点,这表明该系统已不再停留于展示型样机,而是进入了工程化交付阶段;而根据2025年9月华为全联接大会,Atlas 900 A3 SuperPoD超节点累计部署300多套,服务于互联网、金融、运营商、电力、制造等行业的20多个客户。在2025年9月的华为全联接大会上,结合已推出或正在研发的昇腾芯片,华为在大会上发布了多款超节点和集群产品,包括Atlas 950超节点(基于Ascend 950DT打造,支持8192张基于Ascend 950DT的昇腾卡,预计将于2026年四季度上市)、Atlas 960超节点(基于Ascend 960打造,最大可支持15488卡,预计将于2027年四季度上市)。

中科曙光:实现产品化供给,打造普惠化高端算力基础设施。2025年11月,中科曙光推出全球首个单机柜级640卡超节点scaleX640,采用“一拖二”高密架构设计,单机柜算力密度提升20倍,基于AI计算开放架构,在硬件层面支持多品牌加速卡,实现MoE万亿参数大模型训练推理场景30%-40%的性能提升。2026年3月,中科曙光推出世界首个无线缆箱式超节点scaleX40,采用正交无线缆一级互连架构,单节点集成40张GPU,总算力超过28PFLOPS,与传统8卡机方案相比价格持平,并且训练性能最大可提高120%,推理性能最大提升330%;精准适配中小规模训练与推理场景,配套的SothisAI平台支持一键部署、自动断点续训、故障智能隔离,支持用户独立完成全栈应用落地。

百度智能云:单节点实现万亿参数训练,向千卡级演进。2025年11月,百度同步推出天池256超节点与天池512超节点。天池256将256张P800放到同一个节点内,相比2025年4月发布的超节点,单实例的卡间互联总带宽提高4倍、性能提高50%以上;对比同等卡数的P800集群,主流大模型的推理任务上单卡吞吐提升了超过3.5倍,预计2026H1上市。天池512在天池256基础上卡数翻倍、卡间互联总带宽翻倍,单个天池512超节点即可万亿参数模型的训练,预计2026H2上市,未来百度智能云还将陆续推出相应的千卡、4000卡超节点。

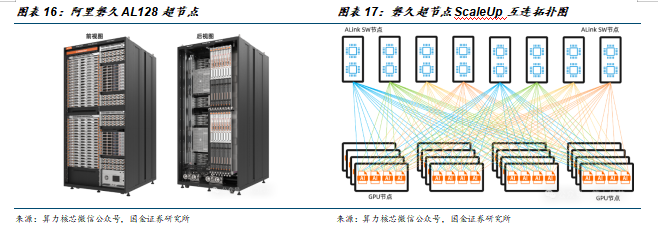

阿里云:软硬件深度耦合度,算力密度领先。2025年9月阿里云发布全新一代磐久128超节点AI服务器,单柜支持128个AI计算芯片,集成阿里自研CIPU 2.0芯片和EIC/MOC高性能网卡,采用开放架构,扩展能力极强,可实现高达Pb/s级别Scale-Up带宽和百ns极低延迟,相对于传统架构,同等AI算力下推理性能还可提升50%;与阿里云自研的HPC网络、CPFS存储系统、人工智能平台PAI深度集成,使通义千问大模型训练加速3倍以上。基础版峰值算力与NVIDIA H20持平,专注于AI推理任务;高级版算力约为NVIDIA H100的50%左右,支持AI训练任务,分层设计使磐久128可灵活适应不同场景的算力需求。

二、超节点驱动产业链价值量重估的核心原因

2.1 价值量跃迁:AI服务器相对通用服务器整机价值量约25倍,增量在环节间呈现显著梯度分化

AI服务器整机价值量较通用服务器跃升一个数量级,传统"服务器出货台数"框架失效。根据SemiAnalysis对典型配置的BOM拆解,一台双路Intel Sapphire Rapids通用服务器整机成本约1.05万美元,而一台Nvidia DGX H100 AI服务器整机成本达26.9万美元,二者比值约24.7倍。这一数据背后的产业含义在于:市场以"服务器出货台数"衡量产业链景气度的传统口径已难以刻画AI周期的真实弹性,AI 服务器渗透率每提升一个百分点,对应的产业链收入拉动远超通用服务器周期。我们认为,评估AI服务器产业链标的业绩弹性,核心在于把握25倍价值量增量在各环节间的梯度分布结构。

GPU NVSwitch Baseboard 是价值量跃迁的绝对主导环节,占 AI 服务器整机 BOM 比例超 70%。在通用服务器中,GPU 与 NVSwitch Baseboard 环节的价值量为零;而在 DGX H100 中,该环节单项价值量达 19.5 万美元,占整机 BOM 比例高达 72.5%。换言之,AI 服务器本质上是一个 GPU 子系统叠加一副服务器外壳,这一结构性特征决定了 Nvidia 在全球 AI 产业链中的绝对主导地位,也解释了为何 AI 服务器周期中 GPU 环节具备最强的定价权与盈利能力。

通信是除GPU外增幅最陡、确定性最高的价值量提升方向。网卡环节价值量从通用服务器的 654 美元跃升至 DGX H100 的 10,908 美元,绝对值增幅达 15.7 倍,位列所有环节第二。其技术成因在于 AI 训练与推理对 Scale-out 后端网络带宽的刚性需求——每张 GPU 需单独配置一张高速 NIC(H100 时代对应 ConnectX-7 400G,B200/B300 时代升级至 ConnectX-8 800G),而通用服务器整机通常仅配置 1-2 张普通以太网卡。我们认为,通信是 AI 周期中除 GPU 外最具确定性的受益环节。

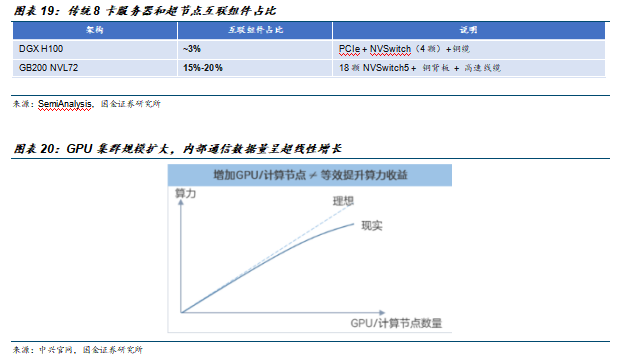

超节点架构的核心跃迁在于将互联从“服务器内部总线”提升为“系统级交换资源”。以英伟达NVL72为例,其单柜内部通过NVLink Switch 铜背板实现72颗GPU的全互联。根据SemiAnalysis的BOM模型估算,互联相关组件(交换芯片、铜背板、高速连接器、Retimer等)在单柜BOM中的占比从传统8卡服务器(如DGX H100)的约3%提升至15%-20%。这一变化并非简单的线缆数量增加,而是交换芯片成为算力扩展的“第二颗核心”——每增加一颗GPU进入同一内存域,交换端口的带宽与连接数呈超线性增长。随着Rubin Ultra NVL576等跨柜方案引入光互联,交换芯片与光模块的价值量占比有望进一步向更高数值迈进。互联环节因此成为超节点时代价值量弹性最大、技术壁垒最高的方向。

组装测试环节价值量翻倍,是我们强调"集群化交付推动ODM毛利率结构性抬升"的BOM层面核心佐证。组装测试价值量从495美元跃升至1,485美元,增幅2.0倍。AI服务器的装配、老化、烧机与互联联调工艺复杂度相较通用服务器显著提升,良率控制与现场交付能力成为ODM环节议价权转移的关键变量。进入超节点时代,交付单元从"台"升级为"柜"乃至"Pod",组装测试环节的价值量弹性将进一步放大。

Markup环节增幅高达60倍,整机集成本身即为高附加值环节。Markup(整机留存加价)从通用服务器的689美元跃升至AI服务器的4.2万美元,增幅达60倍,占整机BOM比例15.6%。这一数据清晰揭示:AI服务器整机集成环节本身即为高附加值环节,头部品牌商与ODM在BOM之上能够获取显著的议价空间。

价值量排序与国产链映射。综合上述梯度分化,AI服务器相对通用服务器的价值量增幅排序为:GPU>SmartNIC(15.7倍)>Markup(60倍)>电源(3.0倍)>组装测试(2.0倍)>CPU(1.8倍)>主板(1.5倍)>存储NAND(1.3倍)>DRAM(1.0倍)>散热(0.7倍)>机箱(0.4倍)。将这一框架映射至昇腾服务器与国产超节点生态,价值量较高、弹性最强的环节依次为AI芯片、通信、电源、整机集成与Markup、CPU、存储与内存。

2.2 集群化交付推动ODM厂商毛利率结构性抬升

传统单台服务器代工模式下,ODM厂商议价能力长期受限,毛利率被压制在极低水平。造成这一现象的根本原因,在于传统代工模式高度标准化:中国服务器行业向白牌生产模式转变后,众多企业将服务器模块化、标准化,进一步压缩了服务器厂商的利润空间,服务器行业整体毛利率因此持续承压。

然而,超节点时代的到来正在改变这一格局,主要通过两个维度重塑ODM的利润结构:其一,交付单元从单台服务器跃迁为整机柜乃至Pod级系统交付,工程复杂度与议价权同步抬升;其二,客户结构高度集中,能够通过头部云厂商严苛验证的ODM极为稀缺,供给侧竞争格局优化。两重变化叠加,头部ODM在超节点数通业务上的毛利率有望向更高区间迁移。

2.2.1 交付单元从"台"变成"柜"乃至"Pod"

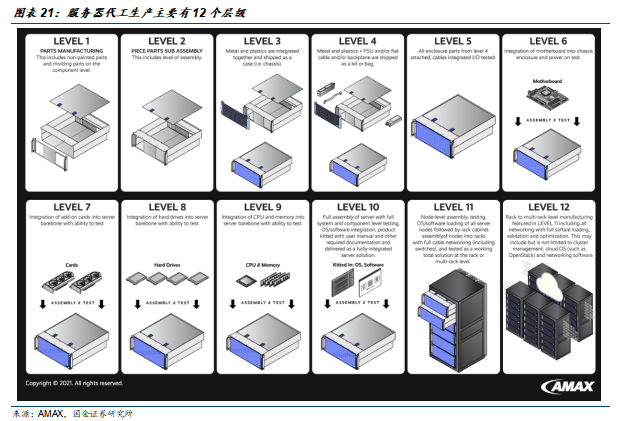

① 交付形态跃迁:从L6零部件到L11整机柜系统集成

服务器代工生产主要有12个层级,从最低的Level 1(零部件制造)到最高的Level 11-12(服务器解决方案),层级越往上难度越高,附加值随之提升。 Tencent News

以英伟达为例,据电子产品世界报道,过去英伟达的AI服务器机柜,可粗分为两段,第一段为做到L6的主板,第二段是从L6,再加关键零组件到L10,然在2026年下半将开始量产的Vera Rubin架构,NVIDIA有意指定三家ODM做到L10,交货给NVIDIA后,再交给要做L11的厂商。未来英伟达计划推行的新商业模式,是由指定供应商直接做到L10后出货给英伟达,再由ODM做L11组装。这意味着ODM需承接的不再是单台白盒服务器,而是涵盖整机柜集成、Scale-up组网、供电与结构件、上架联调在内的完整系统级交付。

② 系统级交付的工程复杂度提升,ODM议价权上升

超节点整机柜的交付复杂度,远超传统单台服务器。据超聚变数字技术有限公司产品规划专家在亚洲数据中心峰会(Data Center Asia 2025)上的分析:超节点涉及非常多的高速线缆的连接,需要很高的部署密度,不可能用一些离散的设备来做超节点,所以必须走向整机柜,进而会带来一系列挑战。

整机柜架构的变化会提出很多工程方面的要求。首先就是供电架构。传统机房采用的是水平供电,但根据超聚变进行的模拟分析,当芯片功率超过1 500瓦,水平供电会面临可靠性的问题。因为铜线缆有电阻,一定有压降,会导致不同位置的芯片接收到的电压不一样。因此,在单芯片1500瓦以上就可能要考虑垂直供电。垂直供电对整机柜的影响主要是增加了节点空间高度,架构上带来U位和节点间距的变革。

其次是母线排(Busbar)。整机柜的功率如果在250kW,用54V直流供电就可以了。但是,250 kW时母线排上的电流会达到2 500A,表面温度已经高到烫手的程度。因此,更高功率的机柜需要考虑高压直流,如400V、800V、±400V等方案。相应的,供电柜的架构也会发生变化。智算中心不是数据中心的简单升级,而是基于AI的业务复杂特性而做的重新设计。

单柜的功率越来越高,但传统风冷机房总的散热能力和供电能力是有上限的。单机柜功耗持续增加,风液混合冷板式液冷的风冷部分可能会达到风冷机房的极限,需要走向低温冷板或全液冷路线。供电能力的闲置会导致机房在改造的时候产生大量白地板的浪费。因为液冷和整机柜的方案虽然可以提高上架率,但供电和散热的上限会制约机柜的数量。在机房改造中,每一个客户、每一个行业都应该基于自己的业务特征和要求来选择一个适合自己的方案。

从构建大规模AI集群的角度去看整机柜,用户重点关注三点:第一,可靠性,高可靠性才能保证训练、推理的效率。第二,线性度,随着加速卡的增加,性能能否也可以线性地增长。第三,快速恢复,保证训练、推理在发生故障时能够尽快让业务保持运行,这个其实是一个更庞大的系统工程。整机柜,尤其是超节点的研发与交付,是对企业技术能力、运维能力、工程能力的综合性挑战。

我们认为,当交付复杂度提升、合格供应商稀缺时,ODM具备向客户转移工程溢价的实际能力。

2.2.2 客户结构集中化

当前AI超节点服务器的需求呈现显著的“头部集中”特征。这种客户结构集中化,使得订单加速流向少数能够通过严苛认证的ODM厂商。超节点并非简单的服务器堆叠,而是通过高速互联协议将数十至数百颗GPU整合为逻辑统一的协同计算系统,在信号完整性、热设计、系统架构等方面的要求远超传统服务器。能够同时满足PCIe 5.0/6.0及112G SerDes背板设计(误码率控制在1e-12以下)、单柜100kW 液冷散热方案、以及99%以上量产直通良率的ODM厂商,全球范围内不超过个位数,从而形成了极高的准入壁垒。

具体的,在400G/800G高速互联时代,超节点单通道数据速率已攀升至112G PAM4,信号对插入损耗、反射和串扰极度敏感,任何微小的阻抗不连续都会在眼图或误码率性能中被无限放大;热设计方面,单柜功耗突破100kW,液冷已成为“必选配置”而非“可选技术”。这种复杂度导致具备全栈交付能力(自研交换机 AI服务器)的ODM厂商极为稀缺,行业内甚至出现了“发布即巅峰,交付无日期”的乱象,部分厂商停留在“手搓样机”阶段,而真正具备工业化量产能力的ODM凤毛麟角。

风险提示

行业竞争加剧的风险:

在信创等政策持续加码支持计算机行业发展的背景下,众多新兴玩家参与到市场竞争之中,若市场竞争进一步加剧,竞争优势偏弱的企业或面临出清,某些中低端品类的毛利率或受到一定程度影响。

技术研发进度不及预期的风险:

计算机行业技术开发需投入大量资源,如果相关厂商新品研发进程不及预期,表观层面将呈现出投入产出在较长时期的滞后特征。

特定行业下游资本开支周期性波动的风险:

部分计算机公司系顺周期行业,下游资本开支波动与行业周期性相关性较强,或在个别年份对于上游软件厂商的营收表现产生扰动

VIP复盘网

VIP复盘网