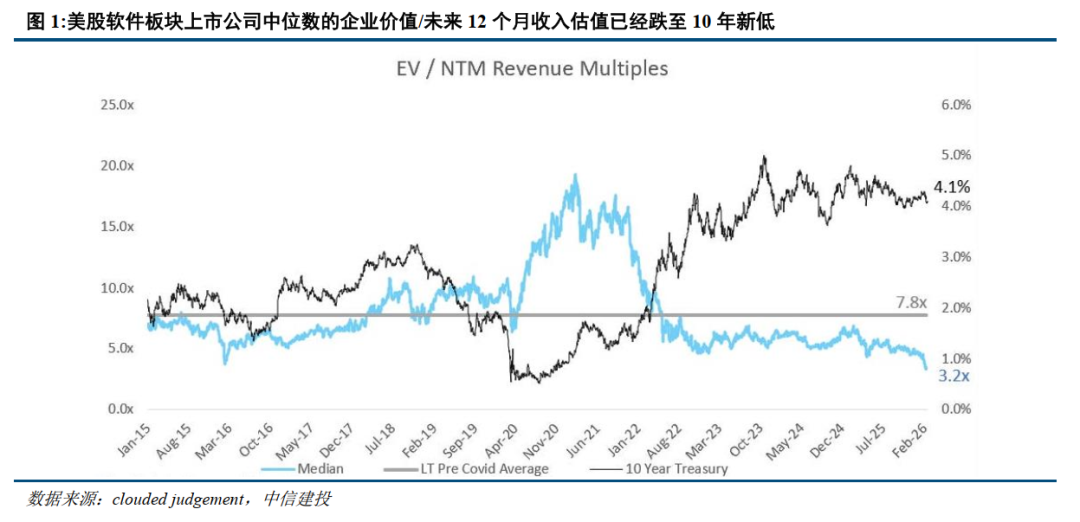

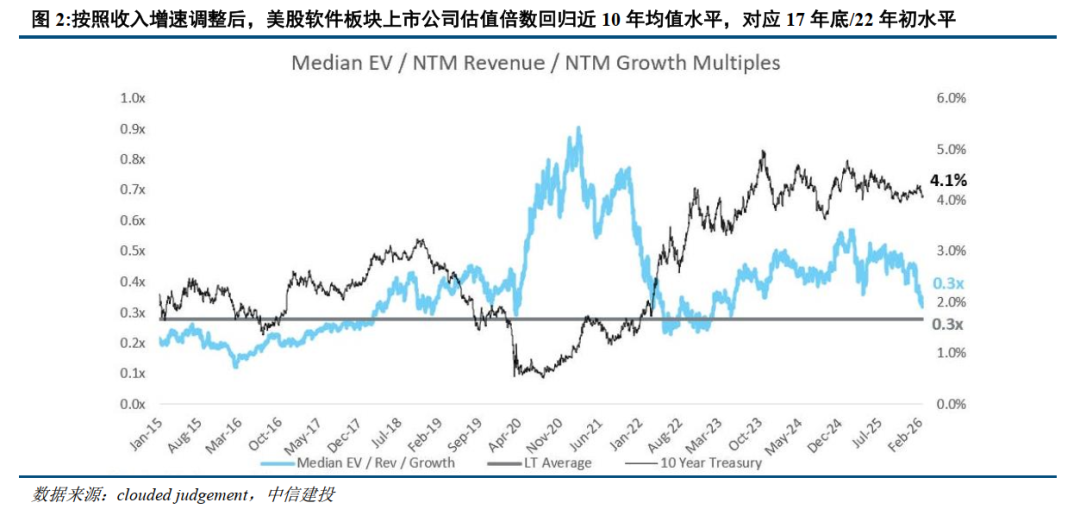

美股软件板块正经历2020年3月以来最深的估值回调,中位数EV/NTM Rev降至3.2x,远低于疫情前7.8x的历史均值。 Anthropic发布Claude Code/Cowork等工具引发了"AI将吞噬SaaS"的末日叙事,但这种恐慌性杀跌将"法律强制 系统记录"型公司(壁垒衰减时间常数5-10年以上)与"UI包装 简单自动化"型公司(壁垒衰减时间常数6-24个月)混为一谈,存在结构性错误定价。按收入增速调整后,板块估值倍数已回归近十年均值附近。我们认为当前是对软件板块进行深度分化定价的窗口期。

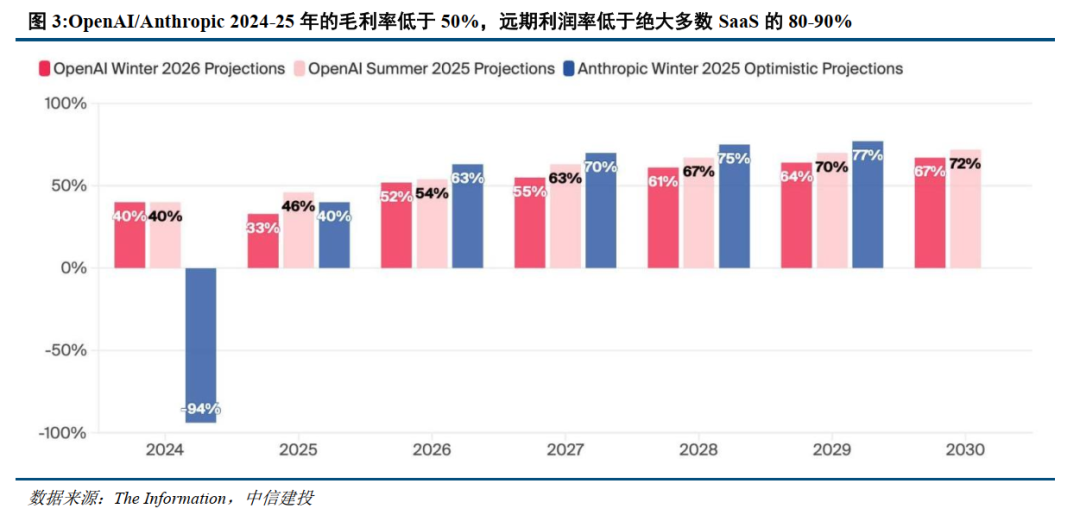

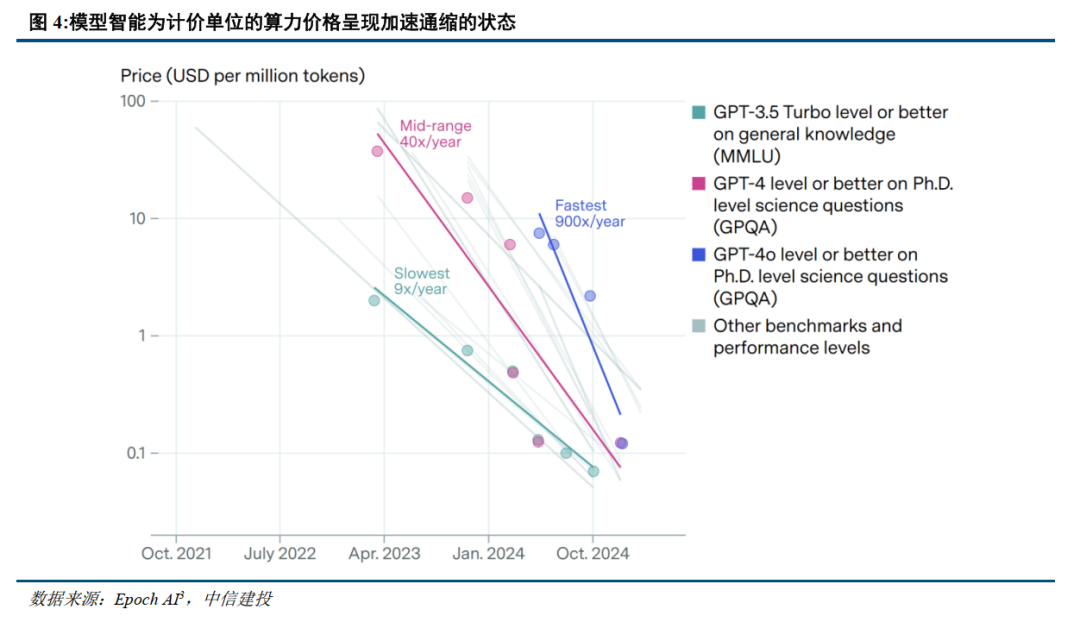

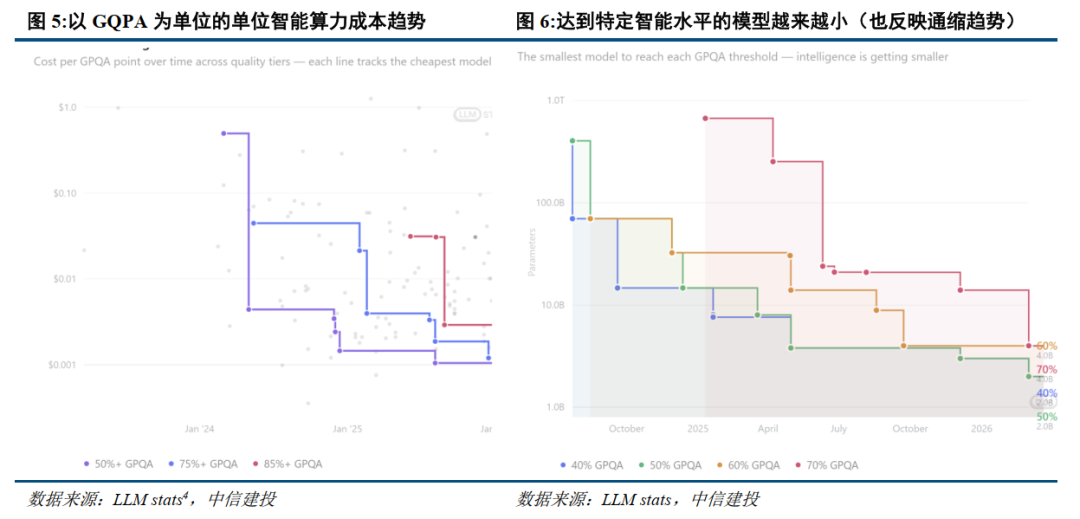

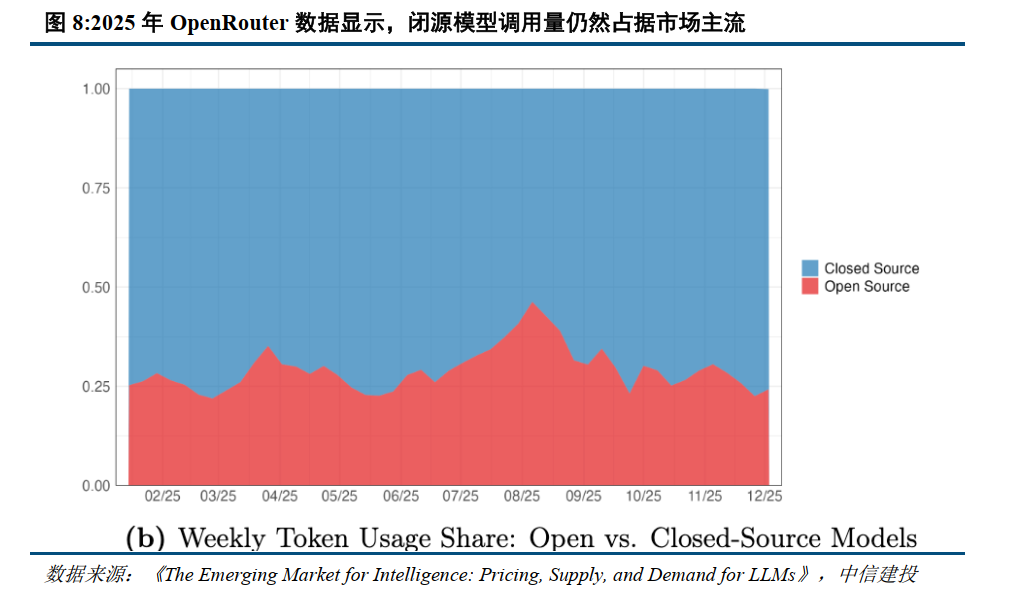

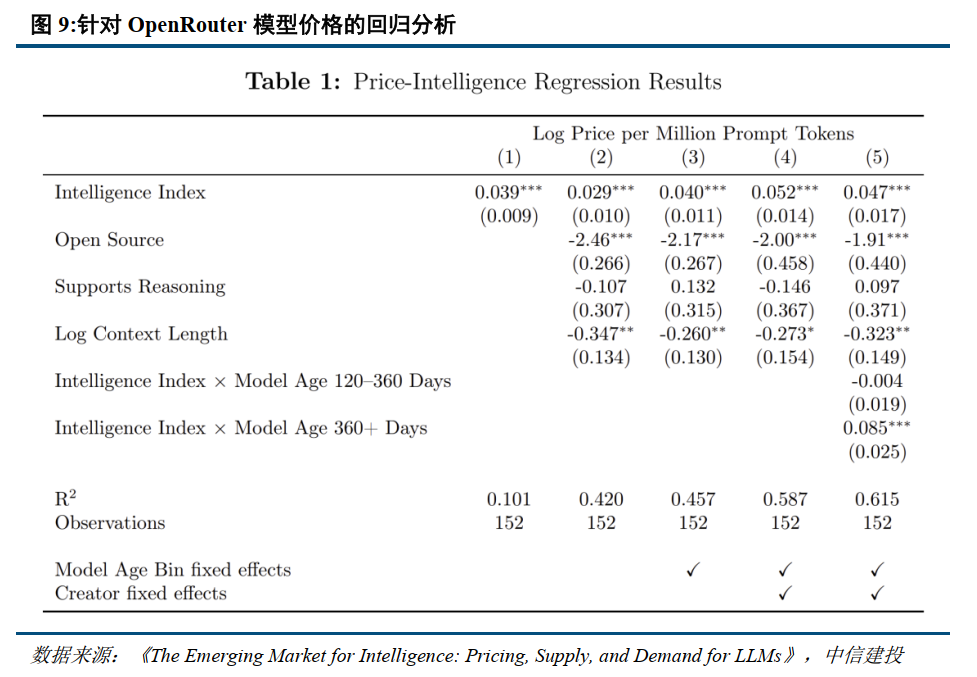

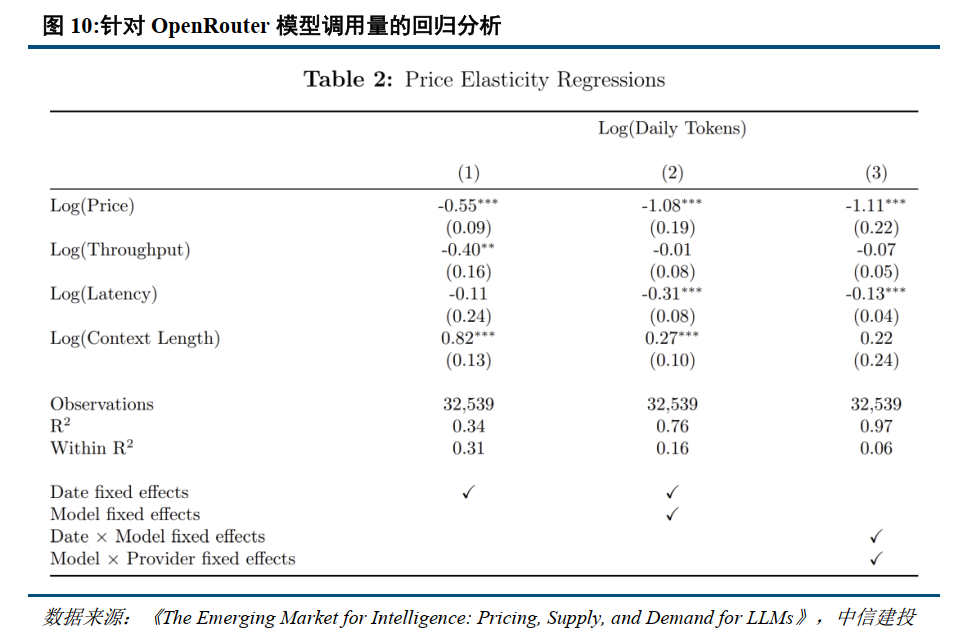

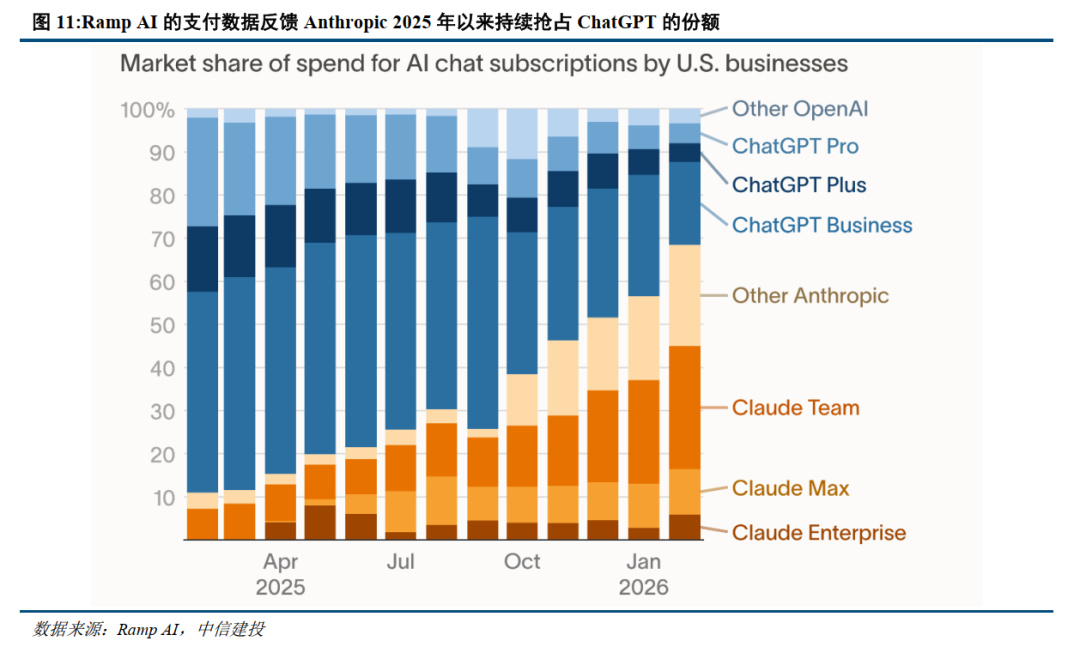

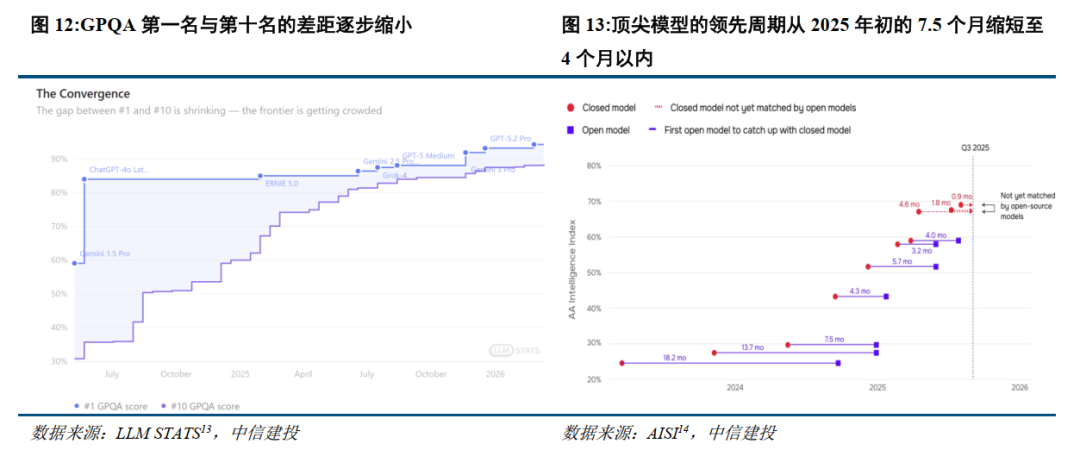

模型层加速同质化,但并非完全同质化。基于MIT等团队对OpenRouter数据的实证研究,闭源模型调用量仍占75%,短期需求价格弹性仅为-1.11(接近单位弹性),说明大模型市场呈现“以品牌为中心的竞争”格局,生态内部转换成本极低,跨生态转换成本极高。但顶尖模型的领先周期已从2025年初的7.5个月缩短至4个月以内,GPQA第一名与第十名的差距持续缩小,模型厂商的价格溢价窗口在收窄。OpenAI 2025年毛利率从40%降至33%,Anthropic毛利率40%(低于预期的50%),推理成本比内部预期高出23%,模型层的利润空间正在被test-time compute的算力消耗和API价格通缩挤压,迫使模型厂商向应用层渗透。

“错误代价”框架证明,高价值垂直领域仍需最强模型,且AI无法平均替代所有软件。基于美国医疗诉讼数据测算,AI在医疗诊断场景每犯一次错的预期经济损失为$45-63(调整后),远超优先采用高性能推理模型的成本阈值。在信贷审批场景中,综合假阴性信用损失与假阳性机会成本,加权单次错误代价在$27-125区间(视余额口径)。这意味着在高容错代价场景中,模型准确率从90%提升至95%所支撑的经济价值可达数十倍乃至百倍的价格溢价,真正的竞争焦点不是谁的API更便宜,而是谁能在垂直领域逼近专家级准确率。

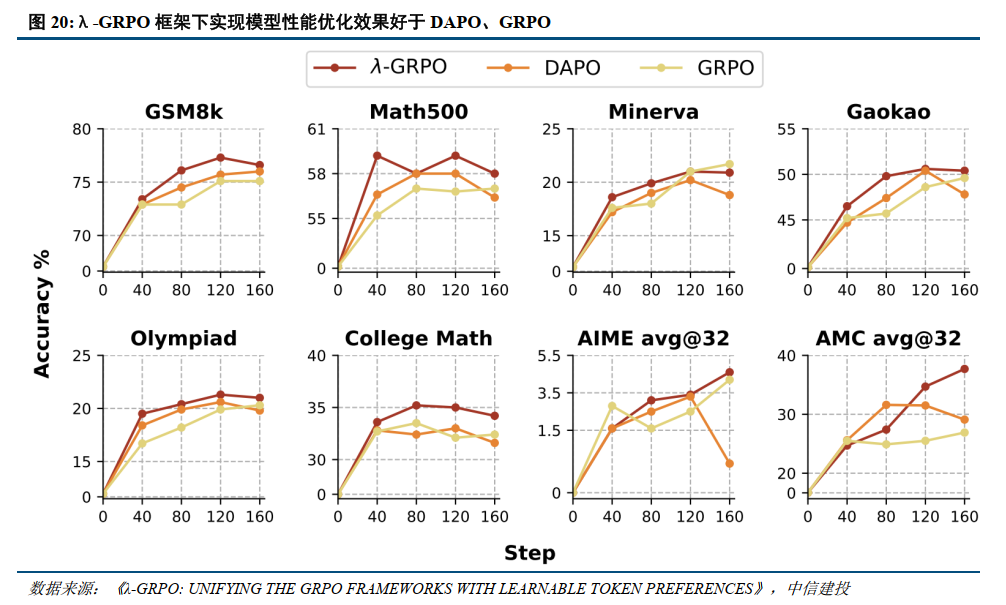

Scaling仍在三个并行方向继续推进,垂直领域"奇点路径"已经明确。2025-2026年的实证表明,模型性能提升来自:①RL/RLVR算法改进(GRPO→DAPO→Dr.GRPO→λ-GRPO),从人类标注奖励转向自动验证;②推理时Scaling(Deep Think并行思考、Agent Swarm并行采样、思考效率优化),DeepSeek R1-0528通过增加后训练算力将AIME准确率从70%提升至87.5%;③架构效率改进(MoE稀疏激活、线性注意力、稀疏注意力),Kimi K2.5的PARL训练使端到端运行时间减少80%。在三个方向的边际收益未快速收敛的背景下,垂直领域准确率将持续提升,真正的护城河路径是"Mid-training注入行业知识 → 构建可验证奖励环境 → RL激发深度推理 → Test-time充分思考"。

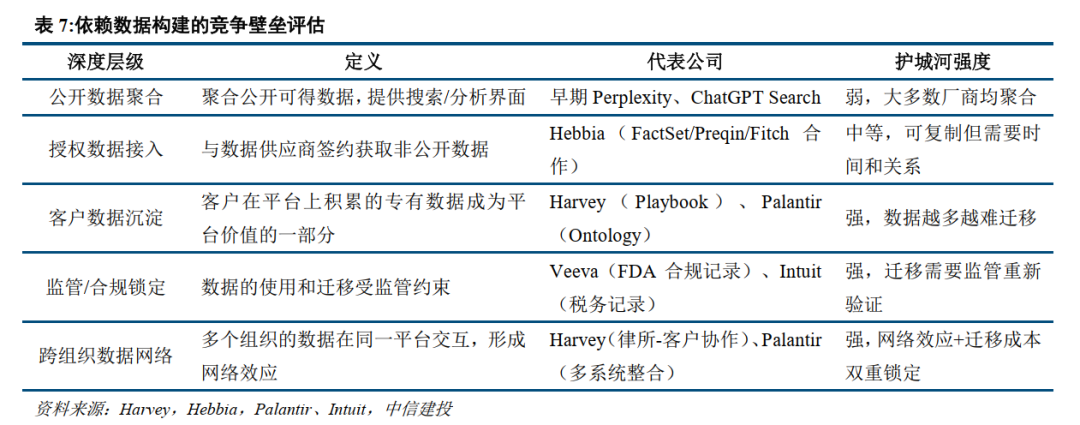

软件壁垒深度分化,AI冲击分化。企业软件的价值从来不在于代码本身,96%的商业程序包含开源代码,但企业仍为安全、合规、集成和SLA付费。AI时代下,壁垒沿"工作流复杂度×数据护城河深度"两个维度分化:①高复杂度 深层数据,工作流编排、上下文管理和合规审计的价值随AI增强而非减弱;②低复杂度 深层数据,数据有价值但席位制计费逻辑面临AI提升人效后的结构性压缩;③低复杂度 浅层数据,核心功能已被AI agent直接覆盖,护城河极薄。BloombergGPT的失败证明"自建模型"路线不可行,GPT-4不到一年就在所有金融基准上超越用3,630亿token金融数据从头训练的专有模型;而Hebbia($130亿估值)、Harvey(ARR>$1亿)的成功则证明"专有数据 工作流 前沿通用模型"才是正确的价值捕获方式。

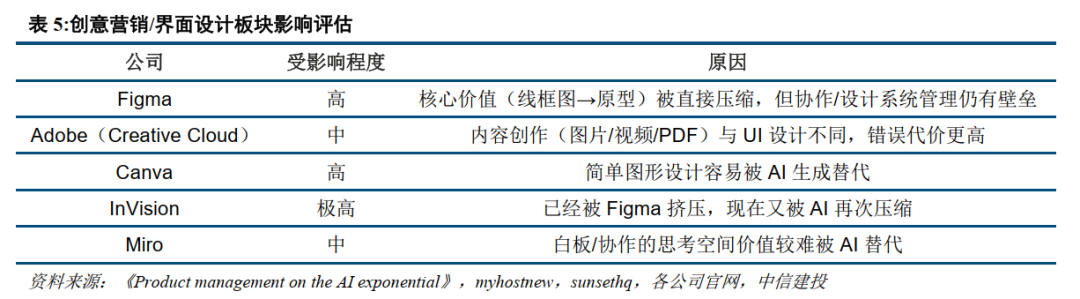

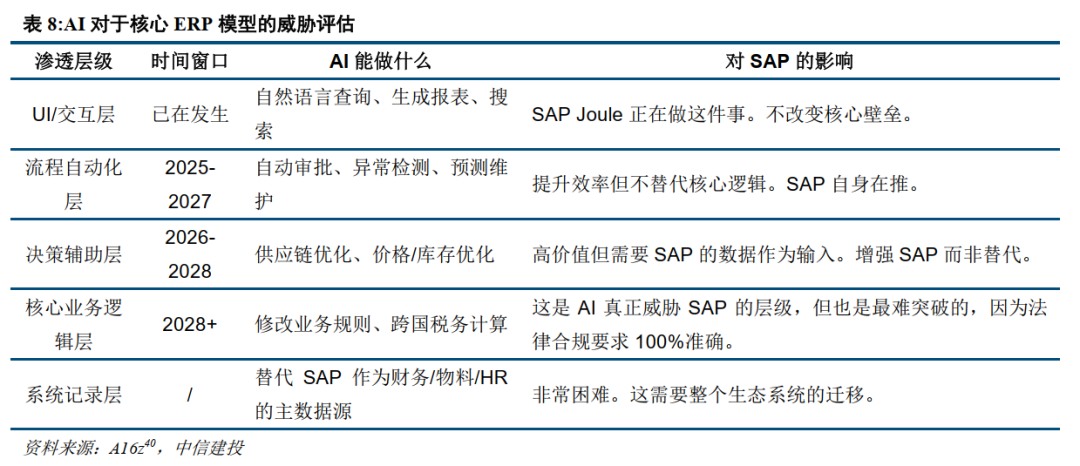

强壁垒来自"商业惯例与法律规章的抽象化编码",AI原生软件的复制成本极高。以SAP为例(全球77%交易收入触及其系统),其壁垒是三层嵌套,①业务规则编码化(各国税务/劳动法/行业合规的可执行逻辑)、②定制化配置的不可逆性(数万配置参数、数百自定义报表、数十年积累的组织记忆)、③生态锁定(数十万认证顾问、S/4HANA强制迁移变成再锁定事件)。SAP前工程师Thomas Otter指出,很多功能不是"商业选择"而是法律强制要求(如德国薪酬计算涉及教会税、社保分摊等数十个相互依赖变量),在薪酬领域0.01%的错误就可能导致法律诉讼。AI对核心ERP的威胁是"分层渗透"而非"替代",UI/交互层和流程自动化层(L1-L2)AI已在增强这些系统(如SAP Joule),但在核心业务逻辑层(L4,2028 )和系统记录层(L5)可预见的未来仍是增强工具而非替代者。同时,AI正在压缩产品开发价值链,Anthropic内部实践显示"从想法到原型"的周期从数周压缩到数小时,UI/UX作为中间产物的价值下降,Figma等设计工具面临"设计阶段被整体压缩"的风险,但视觉协作和设计系统管理的壁垒短期内仍然存在。

投资建议:当前软件板块的恐慌性无差别杀跌,为基于壁垒深度的分化定价提供了窗口。我们建议沿"壁垒攻防属性"进行配置:①核心超配"进攻性壁垒"标的,壁垒本身成为AI时代新增长基础的公司;②关注"防御→进攻转型"窗口,传统壁垒坚固但需验证AI收入转化的公司;③回避壁垒衰减时间常数短的标的,低复杂度 浅层数据的公司。后续关注OpenAI、Anthropic与咨询公司合作进展,企业软件公司AI定价及ARR增长拐点。

行业概况:软件板块估值回调至多年低位

当前美股软件板块正经历自2020年3月以来定价最不合理的“结构性恐慌”。尽管Anthropic发布的Claude Code/Cowork等工具引发了“AI将吞噬SaaS”的末日叙事,导致软件板块估值中位数降至3.2x EV/Rev,远低于疫情前7.8x的历史均值 ,但这种恐慌忽略了不同软件品类间的深度分化。软件正从“赋能人类的工具”向“交付结果的数字员工”跃迁。未来价值将向拥有垂直数据、业务Know-How及基础设施地位的厂商聚集,而缺乏壁垒的“UI包装型软件”将面临灭绝。

逻辑上看,企业软件的价值不在于代码本身(从SaaS的高毛利可以看出),如果价值真的体现在代码上,这些公司一开始就不可能发展到如此规模。它们早在几年前就被开源软件或发展中国家廉价软件工程师的竞争淘汰了。事实上,根据哈佛大学2024年的报告《Open Source Software: The $9 Trillion Resource Companies Take for Granted》 ,开源社区为企业节约了8.8万亿美元的开发成本,约96%的商业程序都包含一些由面向公众的技术论坛创建、修改或免费分发的代码。尽管如此,企业仍为商用/企业版付费,用于支持、安全、合规、集成和SLA。OSS常采用open-core模式:核心免费,企业特性/托管/服务收费。96%组织增加或维持OSS使用,但主要驱动是成本降低(53%),同时面临技能、集成、安全挑战,导致混合使用而非完全替代。目前的Vibe Coding工具很大程度上降低了开发维护软件的成本,但与开源软件类似的,企业软件安全、合规、集成和SLA的价值并非被完全颠覆。

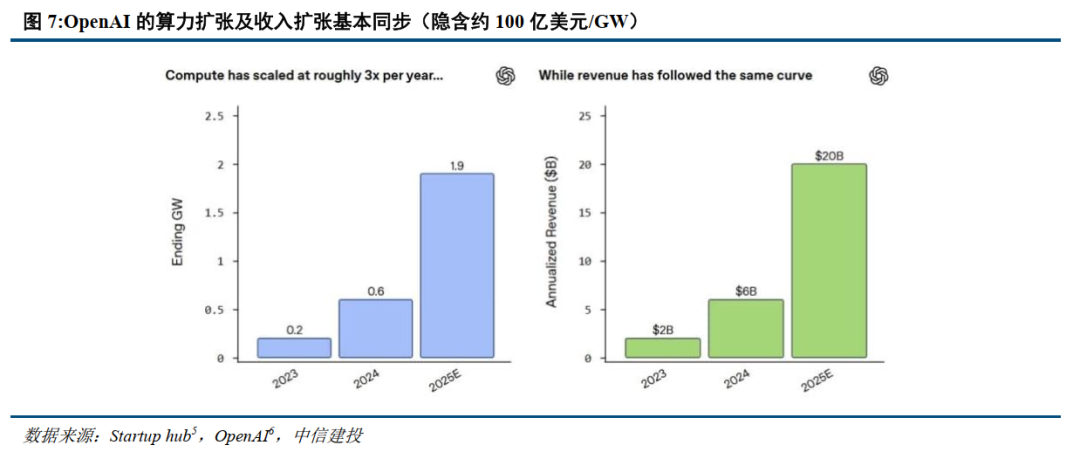

Frontier Model Labs受模型层同质化挤压(任何模型难以取得长期优势),API价格通缩,尽管Token量指数级别增长,但是OpenAI披露的单位GW的收入过去3年维持平稳,(考虑付费用户比例轻微下降,但用户ARPU提升),迫使模型Labs需要向下游应用层渗透(但不意味着必然成功)。

软件公司典型的竞争壁垒包括迁移成本,网络效应,流程能力,专有数据等。其中1)迁移成本分为代码转译、决策成本,企业架构转型中最困难的往往是决定转型,一旦决策后,代码迁移的时间和金额成本并没有特别高,一些复杂系统的迁移周期长主要是,例如Oracle数据链接下游多个业务系统,ERP系统链接采购、库存、生产制造等多个模块,一旦迁移往往涉及整个系统的重构,除非新架构带来效率质的飞跃,否则决策层难以决定迁移。Gartner的研究表明 ,83%的数据迁移项目要么彻底失败,要么显著超出分配的预算和时间线,导致失败的主要原因并非代码转译本身。用户对系统实施的抵制被一致认为是这一高失败率的关键原因 。

2)网络效应基本不受影响,Harvey 和 Hebbia正在构建金融和法律协作空间,将服务提供商、客户以及他们的代理人连接到同一个系统:使用这些平台的人员和代理人越多,平台的价值就越高。Harvey的联合创始人Winston Weinberg和Gabe Pereyra认为法律AI的未来将是律所与客户之间的协作,律所还可以共享定制的工作流和Playbook,让客户生成初稿或获得结构化指导,同时保留律师监督的好处。跨组织的法律团队可以在安全的共享空间中协作。律所和客户可以在单一安全空间中并肩工作,以获得更好的成果和更深层的关系。使用这些平台的人员和代理越多,平台的价值就越高。

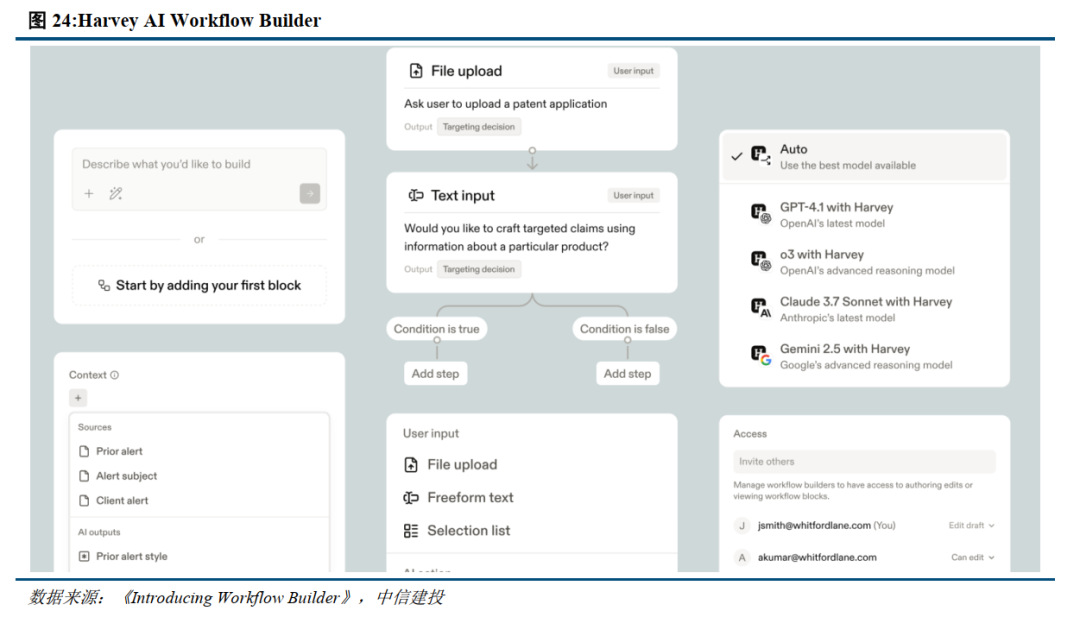

3)流程能力基本不受影响。Harvey 在 Workflow Builder 发布博客中提到 ,这个工具可以把律所的专有知识变成结构化、可复用的系统;创新与知识团队可以设计出反映本所专有的Agents。此外,底层模型更强,不会把应用层压扁 ;相反,任务更复杂后,编排、上下文管理、子代理分工、格式控制和可观测性变得更值钱。它们会增强应用层的功能 ,因为真正的难点从来不在于原始的智能,而在于如何运用这些智能。

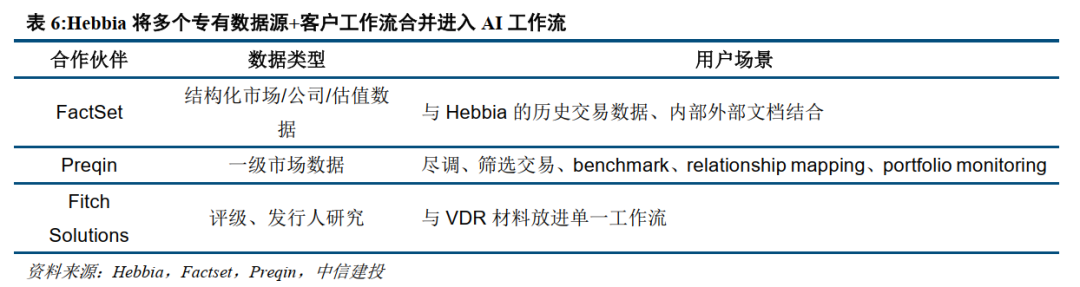

4)专有数据仍然非常重要。Hebbia 与 FactSet 的合作让用户把结构化市场/公司/估值数据,和 Hebbia 自己的历史交易数据、内部外部文档一起用;与 Preqin 的合作允许客户把 一级市场数据和内部/第三方数据合并,用于尽调、筛选交易、benchmark、relationship mapping、portfolio monitoring;与 Fitch Solutions 的合作则让客户把评级、发行人研究跟 VDR 材料放进单一工作流。当模型本身趋于通用后,真正稀缺的不是“能不能生成”,而是谁能把高质量数据、内部资料、权限和工作流拼接成可执行系统 。

综上所述,AI对软件的冲击并非整齐划一,而是根据工作流复杂度与数据护城河深度呈现分化①高复杂度 深层数据,其本质是确定性系统。②低复杂度 深层数据。虽然拥有数据,但因工作流简单,AI会显著提升单人产出,导致“席位制”计费逻辑崩塌。即便平台留存,收入规模也可能因席位缩减而面临结构性压缩。③低复杂度 浅层数据,其核心价值已被Claude Cowork的开源插件覆盖,护城河极薄。

模型层是否正在加速同质化?

叙事回归基本面,模型层面是否正在同质化?MIT、微软、Amazon、波士顿大学的研究团队针对Openrouter披露的模型采用数据,发现尽管开源模型比闭源模型更便宜,通常价格可以低至闭源模型的90%(如果用作者独立构建的intelligence指标标准化模型性能以后),但闭源模型在平台上的采用占比仍然高达75%,只有25%的用量来自开源模型。

这一结果与经济学的同质化供需市场假设相违背,原因可能有1)模型并非完全同质化,2)模型同质化,但基于公开benchmark构建Intelligence index并未很好的捕捉模型之间的性能差异,例如风格一致性、在测试集外的性能差异、服务稳定性等。

研究团队对于Openrouter模型价格的回归分析显示,模型性能(基于公开benchmark构建)、开源与否、支持推理、上下文窗口合计解释价格的42.5%,如果补充模型固定效应(粘性)则解释力度提升至61.5%。

而对于模型使用量的回归分析,价格对用量的影响解释程度仅有34%,模型的固定效应解释程度合并后可以达到97%(模型型号、模型提供商的粘性)。

需要注意,由于各家模型厂商都有一些secret sauce用于模型评估/训练迭代,所以模型的固定效应包含了一部分公开benchmark未捕捉的性能差异,剩余的影响因素才是模型本身的粘性。论文在最严谨的设定下测算出的短期需求价格弹性为-1.11。这意味着,价格每下降 1%,调用量只增加约1.11%。

在经济学中,弹性的参照系如下:缺乏弹性(0 到 -1):必需品(如食盐、胰岛素、短期的汽油)。价格怎么变,大家都得买。单位弹性(约 -1):常规商品(如普通的衣服、住房)。价格降一点,销量按比例涨一点。富有弹性(-2 到 -5 或更低):替代品极多的商品(如某个特定品牌的矿泉水、相邻不同加油站的汽油)

大模型市场的粘性主要表现为“以品牌为中心的竞争”,一方面生态内部的极低转换成本,跨生态的极高转换成本。当 Anthropic 推出与 Claude 3.5 价格相同但性能更强的 Claude 3.7 时,用户会立即放弃旧版本并迁移到新版本。对于开发者而言,在同一个代码库里把 API 调用的模型名称从 claude-3-5-sonnet 改为 claude-3-7-sonnet 几乎没有成本。但这种替换几乎没有对同时期的 GPT-4o 或 Gemini 2.0 造成任何明显的份额挤压。这证明用户被牢牢锁定在了各自的品牌生态墙内。如果市场没有粘性,Claude 3.7 的发布理应立刻抽干其他所有竞争对手的流量。因此模型层面高度同质化的判断并不准确,当前模型供应商存在一定粘性,但其粘性在绝对的性能差距下也无法阻挡客户的流失,例如Ramp AI结合信用卡数据反馈的美国企业IT支出中Anthropic的份额在2025年下半年以来明显提升。

与一般的企业软件不同,企业软件的毛利率极高,一般在60-90%区间,其边际成本主要是少量算力/存储 流程包装,而且扩展性比较强。但模型厂商不同,根据The Information披露,Anthropic、OpenAI 2025年的毛利率在30-40%,其中OpenAI 24年毛利率为40%,25年毛利率为33%,Anthropic 24年毛利率为-94%,25年毛利率提升至40%(但低于预期的50%)。OpenAI及Anthropic 分别预计在29年/28年达到70%/75%的毛利率。

我们需要理解25年毛利率不及预期的原因,进而判断中期毛利率提升的假设是否合理。结合The Information报道,Anthropic 严重依赖第三方云基础设施。财务数据显示,其在Google和 Amazon 服务器上为付费客户运行 AI 模型的实际推理成本,比内部预期高出了整整 23%。当 Anthropic 推出诸如 Claude 3.5到3.7 的升级,或推出如 Claude Code 这样针对复杂编程和办公场景的功能时,用户提交的任务变得极其庞大和复杂。虽然 API 标价没变,但单次任务占用云端 GPU/TPU 的时长和算力远超预期,直接侵蚀利润空间。如果把免费用户的推理成本也算作 COGS,其综合毛利率会进一步跌至 38% 左右。OpenAI也提到,为了提供更聪明的回答(尤其是 o1、o3 等具备深度思考能力的模型),模型在后台需要生成海量的Reasoning Token,API单价虽然没变,架构优化例如量化压缩、MoE稀疏激活等降低单Token成本,但最终毛利率仍然受到挤压。

总结来看,模型层过去2-3年仍然在加速同质化,尽管对于领先模型其形成了一定需求粘性(体现为溢价),但这种锁定效应更多建立在OpenAI、Anthropic持续保持第一梯队(性能不至于被拉开太多)的前提下,同时OpenAI、Anthropic也在缩短模型迭代周期。最终体现为顶尖模型仍然有一定价格溢价,但是领先周期缩短,所以这类溢价不足以支撑毛利率维持稳定趋势,我们总体上认可模型层同质化的判断,模型厂商需要向基础设施、应用层拓展以巩固商业模式。

模型向应用层的扩张,AI是否会吞噬一切?

当任务转向文本和知识工作时,最新的研究引入了“错误代价(Price of Error)”来对比人类与大模型。2025年发表的论文《Economic Evaluation of LLMs》提出,衡量AI成本不能只看 API Token 的价格,必须将“AI犯错带来的业务损失”和“AI延迟的时间成本”换算成美元,与人类工资进行对比。1)在高价值场景(如医疗诊断、金融合规),“错误代价”极高。研究发现,一旦单次错误的代价超过 0.01 美元,部署最昂贵、最聪明的前沿大模型(或直接雇佣人类)的经济效益,远远超过使用便宜但容易出错的开源小模型。2)在低价值场景(如电商客服),错误代价低(约1美元),此时AI的推理成本远低于人类客服的时薪底线。

论文核心思路是引入条件约束,错误代价:模型犯一次错,会导致业务损失多少钱。延迟代价:模型每多卡顿/延迟一秒钟,用户流失带来的经济损失是多少。弃权代价:模型回答“我不知道”并将任务转交给人工处理时,需要支付的人工成本。

研究人员利用贝叶斯定理结合了真实的美国医疗诉讼数据:①医疗事故诉讼的平均赔偿额约为50万美元。②这些诉讼中约 2/3 源于真实的医疗错误。③医生每年遇到诉讼的概率是 7.4%(约 13.5 年遇到一次),在此期间医生大约做出 100,000次诊断。④每年约有1/20的成年人经历误诊,综合推算单次诊断发生错误的概率约为 1/100 。将这些概率代入公式计算,得出在医疗诊断场景下,AI犯一次错的预期经济损失$333。这个具体的数字为后续选择昂贵的高端模型提供了坚实的财务背书。

论文研究的核心结论是对于低容错率场景,必选推理模型,且模型准确率从90%提升至95%,可能意味着价格可以提升数十倍乃至百倍(节约经济损失)。而这种在特定领域性能的提升往往来自后训练,结合查晟(Amazon AGI 专家)的访谈反馈,在医疗、法律、复杂软件工程等高容错代价的垂直领域,传统的“微调(SFT)”已经被逐渐抛弃。真正实现准确率质变的路径,是“基于连续预训练(Mid-training)注入知识”与“基于强化学习(RL)的后训练(Post-training)激发推理”的深度结合。

结合公开数据我们逐一验证假设的合理性,①根据Hampton & King ,全美2025年医疗诉讼平均赔偿金额在45.6万美元/起,总共10,028起医疗诉讼,涉及赔偿金额45.7亿美元,但各州差异较大。②结合《Characteristics and Trends of Medical Diagnostic Errors in the United States》针对1998-2018美国22万份医疗诉讼的研究 ,诊断错误导致的诉讼占比26.8%,治疗、手术相关的诉讼占比达52.0%。③高风险科室的医生每年遭遇诉讼的比例是7.4% 。④误诊的概率实际上远高于5%,25年的一项研究 反馈平均误诊率达9.7%,中位数为13.6%。如果我们基于调整后的数据进行计算在医疗诊断场景下,AI犯一次错的预期经济损失为$63/$45,主要波动来自于诊断错误占比从67%下降至26.8%。尽管AI犯错的预期经济损失下降至$45-63/次,但仍然远高于阈值(优先采用性能最高的推理模型,即使考虑延迟和替换人工成本)。

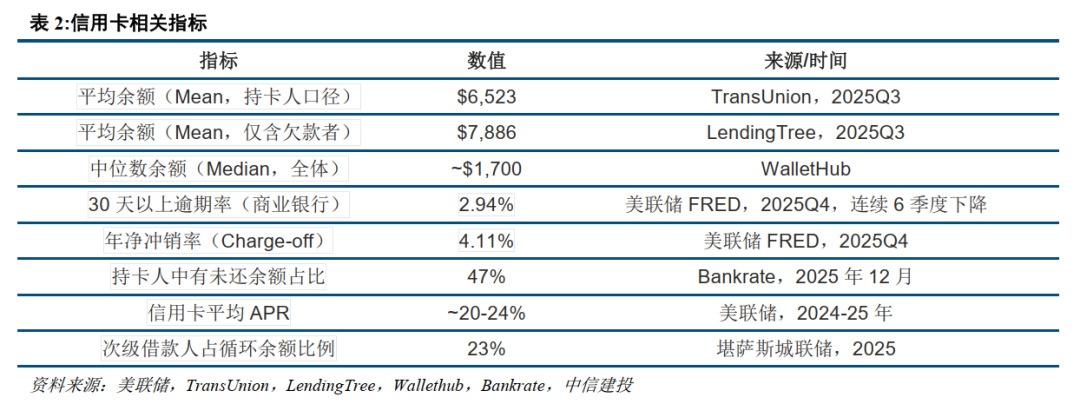

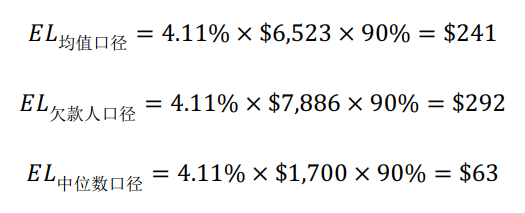

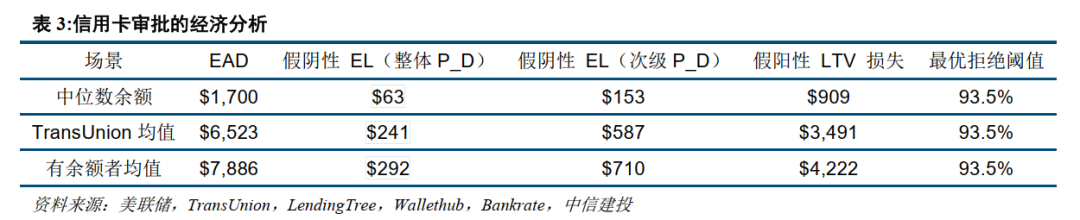

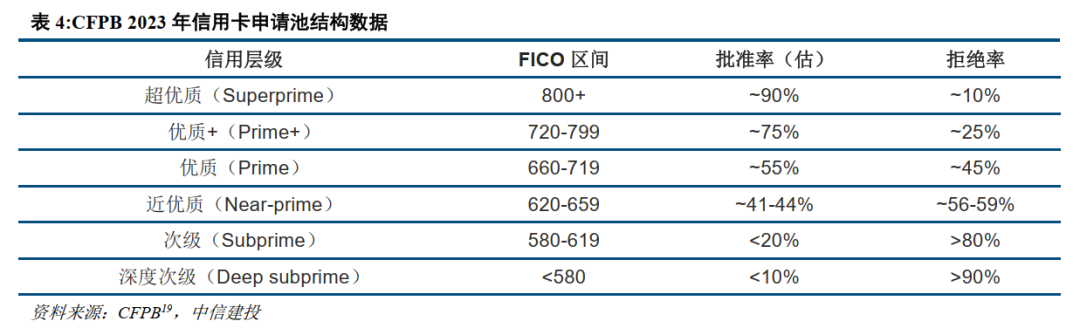

类似的逻辑,我们可以评估信贷审批环节AI犯错的预期经济损失。

对于 假阴性(批了不该批的),关键变量是 P_"真实违约" ; 对于 假阳性(拒了不该拒的),关键变量是机会成本 ="利息收入"×"持续时间" 。

信用卡 LGD = 85-95%(无抵押,追偿极难)

全体市场(P_D = 4.11% 冲销率):

次级申请人口径(P_D ~10%):

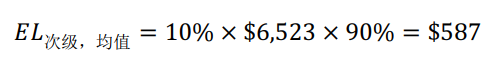

根据美联储2024年数据的分析,近半数成年持卡人(46%)在过去一年内至少有一个月存在未还余额。对一个优质申请人(将持续使用信用卡5年)的终身价值:

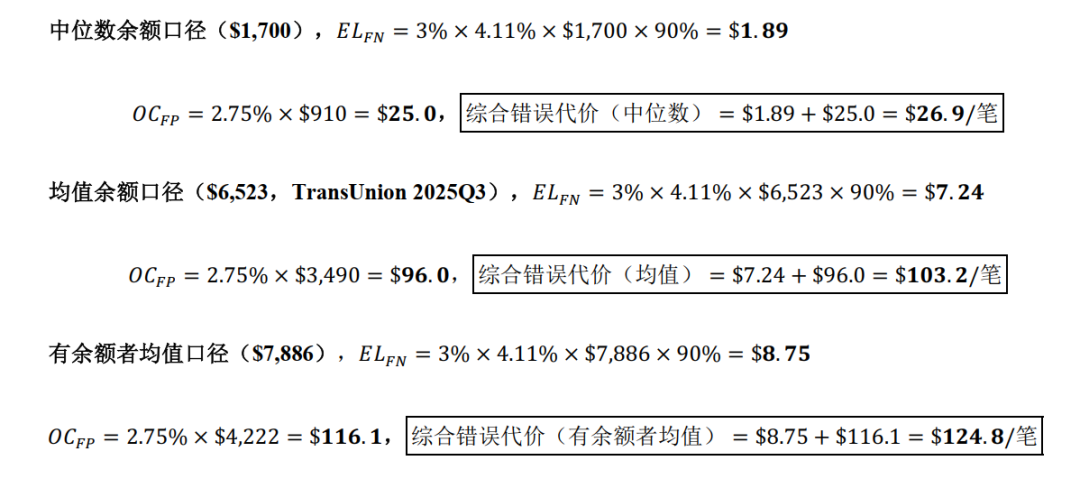

论文的“错误代价”框架解决的是一个单类错误的问题,医疗场景只有一种核心错误 → 误诊(漏诊/误判),一次误诊错误代价$333用来判断值不值得用贵模型。信贷场景是一个非对称双错误结构,假阴性导致向质量较差的客户发放信用卡,逾期概率较高。假阳性则拒 绝优质客户,导致预期收益降低。这种情况下需要对比假阳性/假阴性的比例,即假阳性/(假阴性 假阳性损失),只有当某个申请人违约概率超过93.5%时,拒绝才是经济合理的。 否则拒绝带来的机会成本损失更大。加权单次错误的预期损失对应:

错误代价=rFN×ELFN rFP×OCFP,其中 r_FN 和 r_FP 是AI在申请池中实际产生的假阴性率和假阳性率。

在AI假阴性概率15%,假阳性概率5%的假设下计算,根据Bankrate ,信用良好(670-799分)的申请人中有45%遭拒,而信用极佳(800-850分)的申请人中也有29%遭拒。其中r_FN = 申请池中次级申请人比例 × AI假阴性率 = 20% × 15% = 3%(每笔申请中AI漏掉的坏账概率),r_FP = 申请池中优质申请人比例 × AI假阳性率 = 55% × 5% = 2.75%(每笔申请中AI误拒好客户概率)。

如果AI假阴性/假阳性的概率提升,对应模型准确识别的难度提升,对应的预期错误代价也会随之提升。后续采用情况取决于模型在特定领域边际性能提升的成本vs人工成本差距。

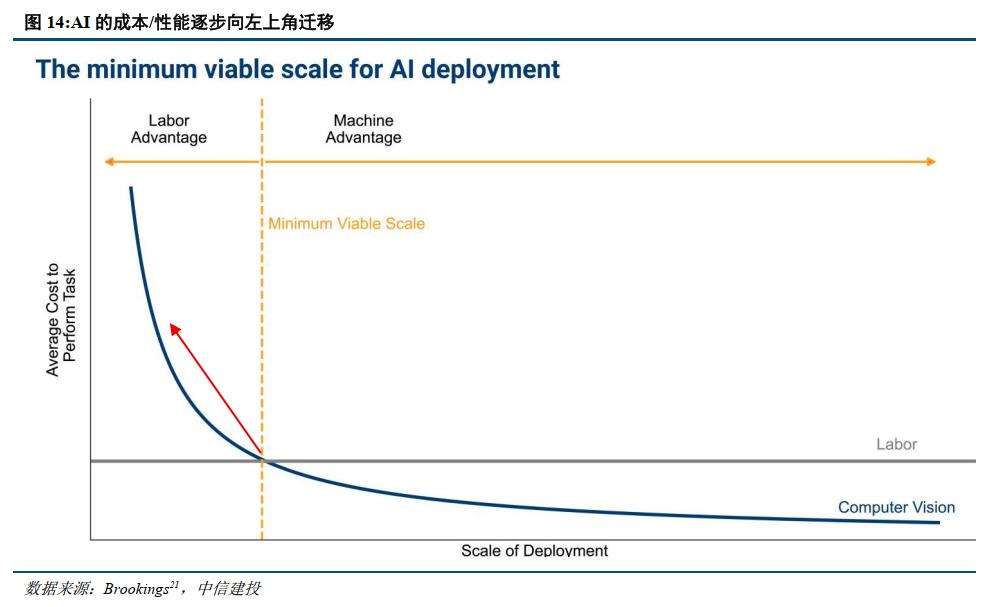

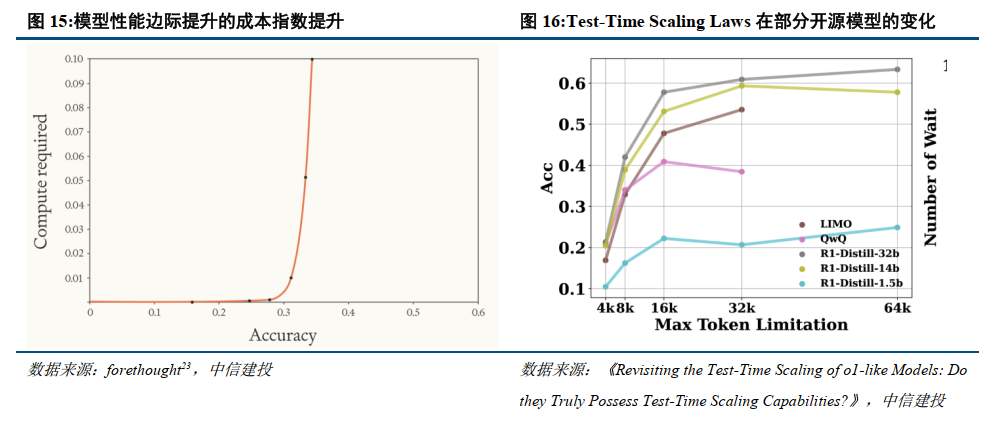

Scaling Law隐含幂律定律,如果从准确率角度考虑,超过阈值后训练投入的边际收益递减。算力基础设施也受带宽/内存/电力制约,扩张成本边际提升。复旦大学的研究团队指出 ,更长的思维链并不能持续提升o1类模型的准确率,正确答案的平均推理链长度反而短于错误答案。Test-time Scaling也受递减收益影响,因为生成更多候选方案或步骤的边际收益最终会饱和,这在数学和推理基准测试中已有实证。有效的资源分配因此需要基于边际效用的原则性停止规则。

寻找继续Scaling扩张的来源

大厂和前沿实验室是如何在垂直领域把准确率逼近极限的 :1)知识注入:连续预训练/中继训练(Continue Pre-training / Mid-training)。目前的主要做法不是从头开始预训练(太贵),也不是用传统 SFT(监督微调)。而是将海量的垂直领域高质量原生数据(如医学期刊、法律卷宗、企业级代码库)作为预训练语料,继续让模型进行无监督的“下一个词预测(Next-token prediction)”。传统 SFT 就像“用一把锤子到处敲”。如果在垂直领域用大量一问一答的 SFT 数据去强行微调,极容易导致知识遗忘。模型原本在通用后训练中建立的“安全护栏、逻辑对齐和指令遵循”会瞬间崩溃,导致它在垂直领域表现得像个“只会背特定答案的书呆子”,稍微变换问题就会严重幻觉。

这种范式在2020年研究中就有所体现。经典的 DAPT/TAPT 论文《Don’t Stop Pretraining》 显示,DAPT(领域继续预训练) TAPT(任务继续预训练)在所有任务上最好;例如低资源 biomedical 任务 RCT-500,TAPT 是 79.8,DAPT TAPT 到 83.0,进一步加 curated-TAPT 到 83.8。它同时还显示,单纯把某个任务上的 TAPT 迁到同域别的任务上会伤害表现,说明“注入领域分布”与“记住某个 QA 模板”不是一回事。

SFT(监督微调) 仍然非常重要,只是它主要解决的是 指令跟随、输出风格、格式约束、任务接口,不是最高效的“知识压缩器”。Google 的 FLAN 证明 ,instruction tuning 本身就能显著提升泛化:一个 137B 预训练模型在 60 任务上做 instruction tuning 后,在25个未见任务里赢了零样本GPT 3的20个。Continual T0 还显示,模型可以持续学习新任务、同时保持旧任务表现,覆盖70个数据集。因此,目前行业内的主流经验是领域知识常靠CPT/DAPT,行为对齐和任务接口常靠SFT;两者不是替代关系,而是流水线前后级。

2)激发准确率的决战地:后训练与强化学习(Post-training & RL)。垂直领域的模型光“记住”医学书没用,它必须能在复杂病例中“做对”。在可验证、高推理密度任务上,RL/RFT 往往是逼近准确率上限的关键后训练手段;但它建立在强 base model、数据筛选、适量 SFT、蒸馏和工具使用之上。主流做法是给模型设定一个极其严苛的“垂直领域环境”,让它自己去尝试各种推理组合。如果最终答案对了,给予正向奖励;如果错或逻辑断裂,给予惩罚。在数学和代码领域,因为答案是可验证的(代码能跑通就是对的,跑不通就是错的)。这就形成了极低成本的自动化闭环。但在医疗、法律、金融领域,最大的瓶颈是缺乏客观的自动裁判。目前的破局点是依靠“人类专家标注”结合“强大模型做裁判”。

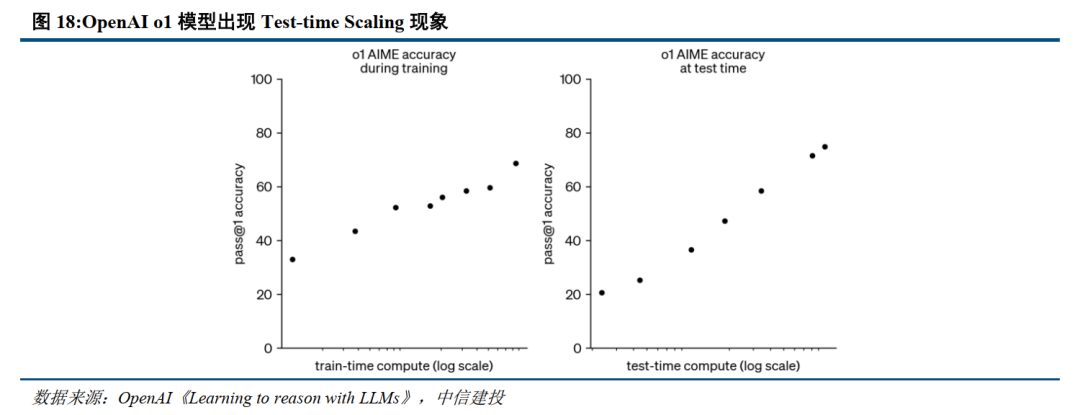

RL确实是目前模型推理性能提升的主要原因,但SFT、对齐蒸馏等仍然不可或缺。OpenAI在发布o1模型时提到 ,其大规模 RL 算法教会模型更有效地使用chain-of-thought,而且随着训练时RL计算量增加以及测试时思考时间增加,性能都会持续提升,AIME 2024 上 GPT 4o 平均只做对 12%,o1单样本到 74%,64样本共识到 83%。DeepSeek R1官方仓库说明里提到 ,DeepSeek R1是“两段RL 两段SFT”,因为纯RL版本会出现重复、可读性差、语言混杂等问题,这说明RL的确是推理性能提升的主要原因,其帮助模型进行self-verification、reflection、长CoT等行为,但可用的工业模型仍依赖冷启动数据、SFT、对齐和蒸馏,并非只有RL。

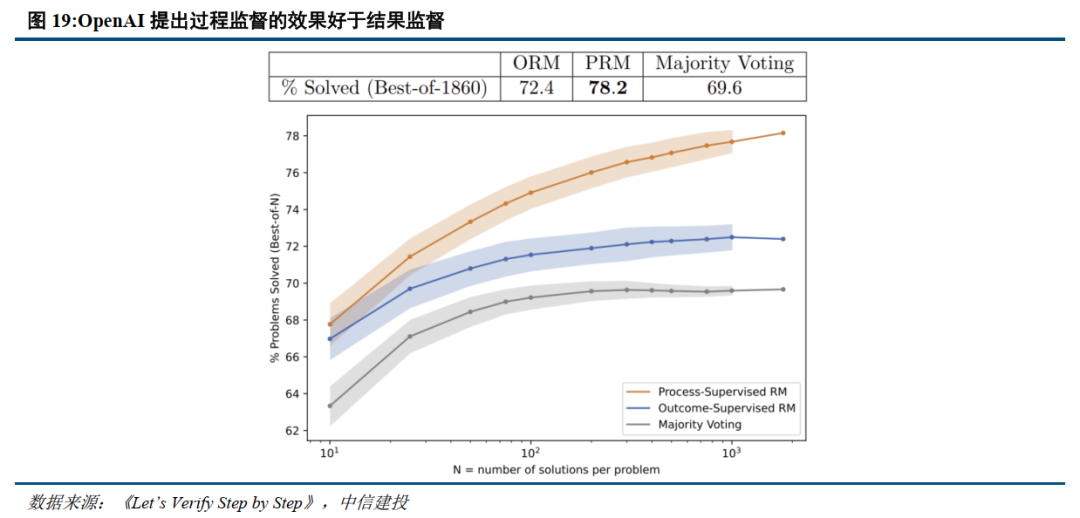

RFT适合答案清晰且可验证的任务,可以用代码执行grader、规则grader、LLM judge 来打分;如果一个任务“你根本没法写出grader”,那就不适合 RFT。它列出的用例里,一边是代码、结构化抽取、复杂规则判断;另一边又明确把基于病史和诊断指南的医疗诊断、从法律案例中定位相关段落这种高价值垂直任务列为适用方向,但前提是专家对理想输出能达成一致。同时,OpenAI也明确承认在更开放的任务上,模型裁判还不能取代专家裁判。GDPval 有自动grader,但还没有专家grader那么可靠,因此不拿它来替代专家。在人类偏好数据昂贵的场景里,AI feedback 与 RLHF 在概括能力/有用性上效果相当,而且AI标注成本超过10倍便宜于人工 。此外,《Let’s Verify Step by Step》 则进一步支持“判别/验证往往比生成便宜”这个工程经验:用大奖励模型去监督小建立模型,发现过程监督明显优于结果监督,并且主动学习让标注效率提升2.6倍,这说明在结构化推理任务里,把昂贵监督集中花在奖励模型上,往往比直接让人类写海量正确答案更划算。

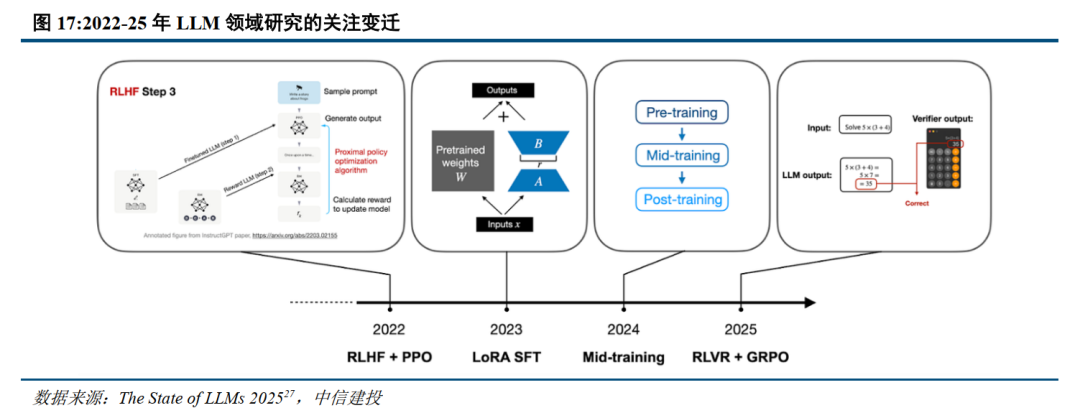

总结来看,2025 年的实证表明Scaling收益来自三个并行的来源 :①RL/RLVR 的算法改进(GRPO → DAPO → Dr.GRPO)带来训练效率提升;②推理时Scaling(Test-time Compute)带来推理性能提升;③架构效率改进(MoE、线性注意力混合、Engram 条件记忆),提升Scaling的效率换取相同算力更高的性能。

展望2026年,在上述三个方向的边际收益没有快速收敛的情况下,预计主流模型团队仍然会继续沿着既定路径优化迭代。①RL/RLVR算法改进。RL业界已转向模块化栈,SFT用于指令跟随,偏好优化(DPO/SimPO/KTO)用于对齐,RL with verifiable rewards(GRPO/DAPO)用于推理,关键转变是从人类标注奖励转向自动验证和自我博弈,GRPO实际上让长响应中的token共享一个奖励;DAPO在所有响应的所有token之间均匀分配权重;Dr.GRPO进一步调整了advantage函数的修改。λ-GRPO 将先前的聚合方案统一在一个可学习框架内,在准确性、探索效率和训练稳定性上提供了更优表现,且不增加额外计算成本。

②推理时Scaling。子方向之一是延续推理链路。DeepSeek-R1-0528继续延长思维链,R1-0528 更新显著改善了推理深度,AIME 2025 准确率从70%跃升至87.5%。但对于最具挑战性的问题,扩展test-time compute 带来的收益非常有限;子方向之二即并行采样,例如Google Deep Think采用模型内置并行思考,Grok采用外置多Agent。此外,DeepSeek 25年9月提出GRM,使用训练好的评分模型从并行rollout中选出最佳答案;子方向之三即提升推理效率,主要是强制施加thinking token budget,避免模型在简单问题上过度思考,目前主流模型一般都采用混合思考模式,在训练阶段就让模型学会何时该快答、何时该深想。

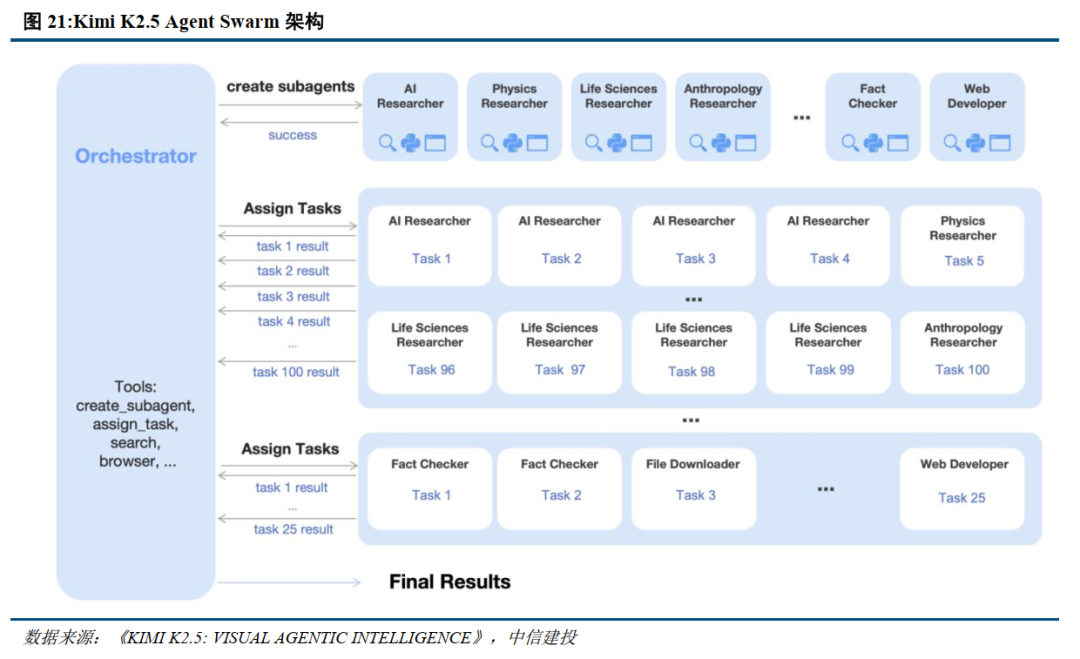

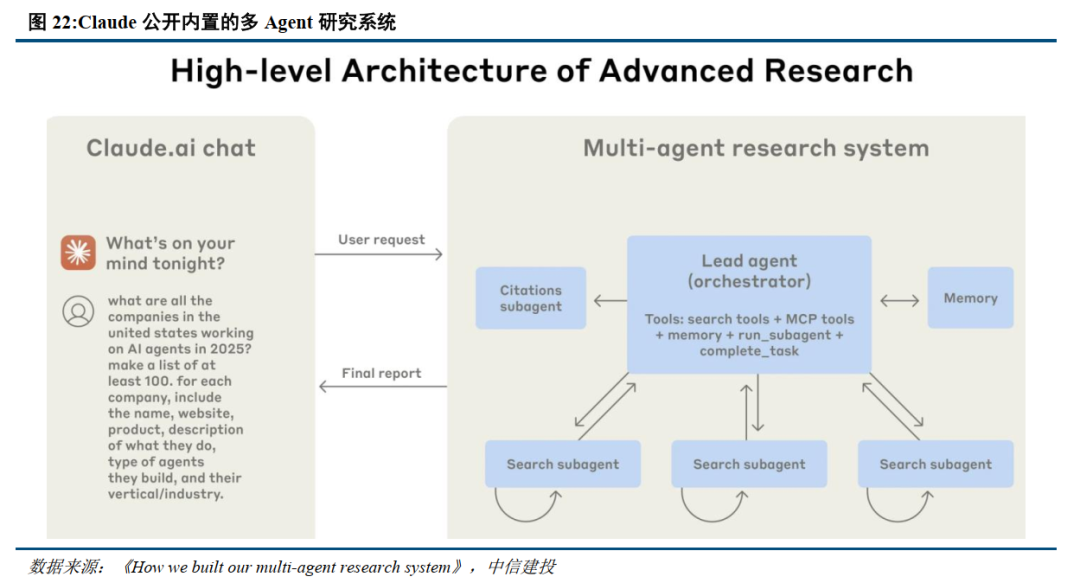

③架构创新。Kimi K2.5提出Agent Swarm并行化策略,K2.5通过PARL强化学习进行训练,能够协调多达100个子智能体,协同处理复杂的研究和推理任务。BrowseComp测试结果充分展现了其优势:集群模式下准确率高达78.4%,而单智能体模式下仅为60.6%,DeepSeek的BrowseComp 准确率在51.4%-67.6%,低于Kimi K2.5。类似地,Google Deep Think也引入并行思考模式 ,节约算力开销的同时提升推理性能 。Grok与Anthropic则是在模型外构建多Agent系统 ,2025年6月Anthropic提到通过构建多代理系统,从线性转向并行推理,大幅提升开放领域的性能,子代理通过并行运行于各自的上下文窗口来促进压缩,它们同时探索问题的不同方面,最终将最重要的信息项精简后提供给主搜索代理。每个子代理还实现了关注点分离——使用不同的工具、提示和探索路径——从而降低了路径依赖性,并支持彻底、独立的调查。博客中提到上下文窗口扩展,以及前后依赖脱钩是多Agent系统性能提升的主要原因。

通往垂直领域奇点的路径要在高价值的垂直领域把准确率做到人类专家级别,公式已经不再是“找一批行业数据做 Fine-tune”。真正的护城河路径是①用Mid-training 把行业数据库吃透;②构建一个极其拟真的垂直环境与可验证的奖励信号(Verifiable Reward);③利用RL逼迫模型学会该领域的深度逻辑推演,而非简单的表面模仿;④在实际业务部署时,给予模型充足的Test-Time算力,让它“三思而后行”。

软件板块:重新思考Scaling / Non-Scaling壁垒

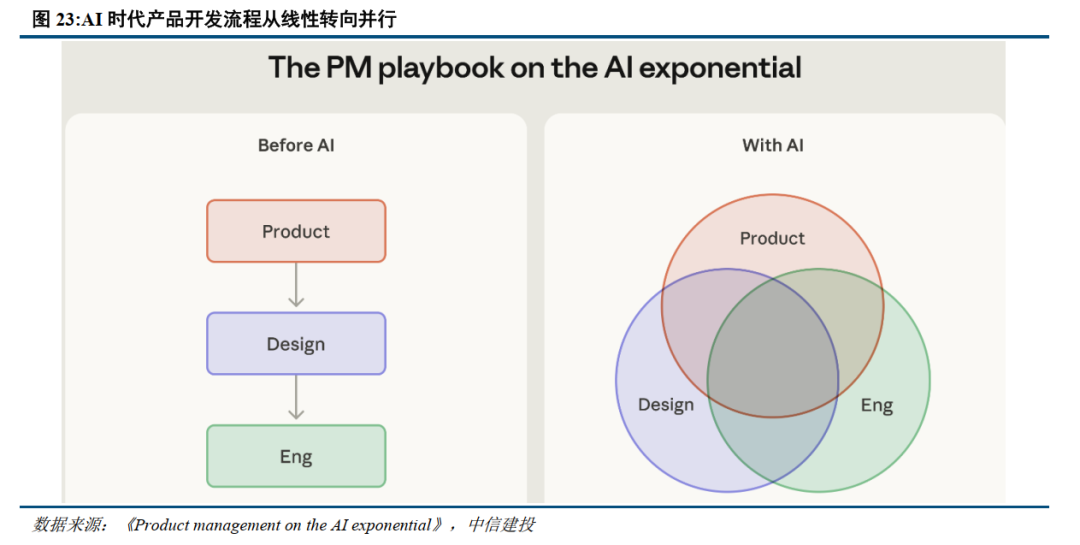

Claude Code产品负责人Cat Wu认为 ,传统产品经理的思维模式是将探索工作视为产品路线图最终确定之前的事情。产品经理首先进行调研,撰写产品需求文档(PRD),然后将其交给工程团队进行开发。而AI时代下其不鼓励制定长期路线图,而是鼓励团队中的每一位成员(工程师、产品经理、设计师)参与“支线任务”。支线任务是指在正式路线图之外进行的短期自主实验,例如花一个下午的时间制作某个想法的原型,测试你认为遥不可及的功能,或者仅仅是看看当你把模型推向超出预期的高度时会发生什么。

对于产品开发领域,其过往的基础是文档,目前则转向Demo,Claude Code团队不再召开内部产品开发会议,而是分享新想法的演示。内部用户试用这些演示,真正获得用户反馈的演示会被进一步完善并推广。因为原型可以在一个下午内完成,所以即使失败成本也很低。许多产品经理习惯于对整个产品体验进行严格控制,但产品经理现在的职责是找出少数真正不可妥协的要素,然后放手让其他要素自由发挥。在 Anthropic,产品经理并非唯一使用 Claude 改进工作流程的人员。数据科学、财务、市场营销、法务和设计团队也都自发地采用了这些工具,整个组织现在以相同的速度运转,无需再等待交接。

从Claude Code团队分享来看,产品全生命周期的价值在变化,①“从想法到原型”的时间从数周压缩到数小时,产品经理直接用Claude Code生成可工作的demo,绕过传统的”写需求→设计→评审→开发”流程。这意味着UI/UX作为中间产物的价值在迅速下降。②交互范式从GUI向CLI/自然语言迁移,开发者工具领域最明显,Claude Code、Cursor、Codex CLI都以终端/自然语言为主入口。但这个趋势不会完全取代GUI,GUI在视觉协作、设计系统管理、非技术人员可达性方面仍有不可替代的价值。③Figma的核心风险不是“GUI被CLI取代”,而是“设计阶段被整体压缩”,当PM可以直接生成可工作原型时,“先在Figma画图再交给工程师”这个工作流的必要性在下降。Figma的出路是从“设计工具“转型为”产品团队的协作操作系统“,但这需要和Google Stitch、Anthropic Claude Code、以及一众AI原生设计工具竞争。

仅仅依赖专有数据很难匹配通用大模型 少量专有数据。典型的反例就是Bloomberg GPT,BloombergGPT于2023年3月发布,是一个500亿参数的大型语言模型,专门为金融领域从头训练。它使用了一个庞大的金融数据集,来自Bloomberg 40年档案的3,630亿token金融特定数据与3,450亿token通用数据的混合。训练数据包括金融新闻、SEC文件、交易记录以及Bloomberg自有数据源。它在2023年发布时的性能不到一年后就被通用模型超越。GPT-4在几乎所有金融基准上都优于BloombergGPT,尽管GPT-4从未接受过金融特定数据的训练。FinGPT通过从Yahoo Finance、Reddit、Twitter等公开来源获取实时金融数据来实现这一点,展示了无需数十亿美元专有数据即可构建金融AI的可行性。Bloomberg最有价值的不是训练一个专有模型,而是它的数据、终端生态、客户关系和工作流嵌入。

Hebbia则围绕专有数据 工作流程,构建双向锁定效应。Hebbia不自建模型,而是把多个专有数据源 客户内部文档 前沿模型能力整合进工作流。任何一个单独的数据源(FactSet、Preqin、Fitch)都可以被其他渠道获取,但把它们全部整合进一个能处理数百份文档的结构化分析引擎,这个组合的复制难度明显更高。随着用户上传大量文档(SEC文件、私募备忘录、法律合同),用户习惯及内部工作流渗透,迁移难度大大提升,而垂直领域用户积累则强化对于专有数据源的议价能力。

Harvey AI在金融和法律领域构建协作空间,将服务提供商、客户及其代理连接到同一系统:使用平台的人和代理越多,平台的价值越高。Harvey构建的Workflow Builder可以把律所的专有知识变成结构化、可复用的系统。创新与知识团队可以设计出反映本所专有方法的Agents。它不只是"用AI回答法律问题",而是一个嵌入了律所专有know-how、跨组织协作能力和审计追踪的完整工作系统。律所还可以共享定制的工作流和Playbook,让客户生成初稿或获得结构化指导,同时保留律师监督的好处。跨组织的法律团队可以在安全的共享空间中协作。律所和客户可以在单一安全空间中并肩工作,以获得更好的成果和更深层的关系。

目前看比较强的壁垒仍然是工作流锁定/网络效应。企业应用层软件的多数规则都是商业惯例、法律规章等的抽象化积累,商业实践/法律强制性规定往往滞后于技术变化,AI原生软件想要完整复制这些面向历史(强调对个案、复杂案例的兼容)成本较高。以A16z《Why the World Still Runs on SAP》为例,SAP的"壁垒"本质上是三层嵌套:1)业务规则的编码化,SAP最大的资产不是代码本身,而是它将"各国各行业的商业惯例和法律要求"转化成了可执行的软件逻辑。每个国家的税务计算方式不同、每个行业的物料管理流程不同、每个企业的审批链不同——这些规则的总和构成了SAP真正的护城河;2)定制化配置的不可逆性。一家大型制造企业的SAP系统可能有数万个配置参数、数百个自定义报表、数十个与其他系统的接口。这些配置是几十年间由咨询顾问、内部IT和业务部门共同积累的;3)生态支持,围绕SAP有一个庞大的咨询、实施和维护生态系统,全球有数十万SAP认证顾问。企业与SAP之间的关系不只是"买软件",而是一个涉及数百人、跨越数年的持续关系。

SAP前工程师Thomas Otter提到 ,很多SAP功能不是"商业选择",而是法律强制要求。德国的薪酬计算可能是全球最复杂的薪酬系统之一,涉及教会税、社会保险分摊、多层级税率、病假工资计算等数十个相互依赖的变量。SAP在这个领域投入了数十年的开发,而且每年都必须随法律变化更新。任何AI系统要"替代"这个功能,不只是要理解逻辑,还要确保100%的法律合规性。在薪酬领域,哪怕0.01%的错误都可能导致法律诉讼。SAP的不同模块面临的AI颠覆风险完全不同。核心ERP(财务、物料管理、生产计划)的替代难度极高,因为它是"系统记录"(System of Record),所有其他系统都依赖它的数据。但外围模块(如差旅报销、简单审批流程)的替代难度低得多。SAP要求所有ECC客户在2027年前迁移到S/4HANA。绝大多数企业选择的是"从旧SAP迁移到新SAP",而不是"从SAP迁移到竞争对手"。这导致每一次强制迁移理论上都是竞争对手的机会,但实际上都变成了SAP的再锁定事件。

宏观经济:美联储降息节奏不及预期或全球经济衰退风险加剧,可能导致企业IT支出全面收缩,软件板块估值进一步承压。2026年AI支出可能因经济谨慎推迟至2027年,若宏观环境恶化,"2026续约悬崖"效应可能加速显现,AI试点预算被优先削减。此外,中美科技博弈升级可能影响全球AI供应链和算力基础设施的可获得性,进而影响模型能力的迭代节奏。

行业层面:模型能力的提升速度可能超出预期,导致AI agent对中高复杂度工作流的渗透快于预期,使得当前判定为"防御性壁垒坚固"的标的也面临提前被侵蚀的风险。模型厂商(OpenAI、Anthropic、Google)向应用层的扩张力度可能超预期,Claude Cowork、ChatGPT Operator、Gemini Agentspace等产品若快速获得企业客户采纳,将直接压缩传统SaaS的定价权和增长空间。席位制向消耗制/结果制的定价转型过程中,收入可预测性下降,可能引发阶段性的收入增速波动和估值重定价。

公司执行风险:若AI收入增长不及预期将面临显著的估值回调风险。本报告的"错误代价"测算基于美国医疗诉讼和信贷数据的特定假设,若实际误诊率、赔偿分布或AI准确率改善速度与假设偏离,相关结论的适用范围可能受限

VIP复盘网

VIP复盘网