AI模型:复杂任务能力提升,类Claw产品加快落地

本月模型演进的核心变化,是复杂任务执行能力开始成为重要评价维度,类Claw产品也进入加速落地阶段。国内类Claw产品正由“能不能用”转向“如何形成工作流产品”的竞争阶段,海外方面则继续强化推理、编码、工具协同和专业工作流能力。我们认为,随着多Agent协同和多工具调用逐步常态化,模型竞争正从单点能力比拼转向复杂任务交付能力竞争,Token消耗与推理侧算力需求也有望持续提升。

AI算力:Agent叙事强化,LPU商业化进程或加速

我们判断Agent正从能力验证迈向规模化应用,Claw生态加速成熟,推动长链任务、工具调用与多Agent协作普及,Token消耗斜率继续上行。推理需求放量下,算力租赁价格与基础设施景气度持续提升,LPU等高吞吐推理架构的商业化进程或同步加速。中国模型凭借能力提升与极致性价比优势加速Token出海,国内算力需求Beta有望持续上行。

AI应用:海外SaaS悲观预期缓解,OpenClaw催化Agent加速

本月我们看到海外AI应用商业化仍在持续推进,SaaS板块对“模型吞噬软件”的悲观预期有所缓解。与此同时,海外SaaS厂商的中台化转型已初见成效,数据中台与Agent管理平台有望成为企业级Agent落地的重要基座,26年应用侧放量值得关注。国内方面,OpenClaw热潮正推动Agent形态加快演进,并带动AI Infra需求提升;随着Agent逐步进入复杂数据场景,AI终端有望成为新的数据入口,进一步打开个人与企业Agent的发展空间。

AI4S:AI制药持续商业化落地,物理AI有望加速发展

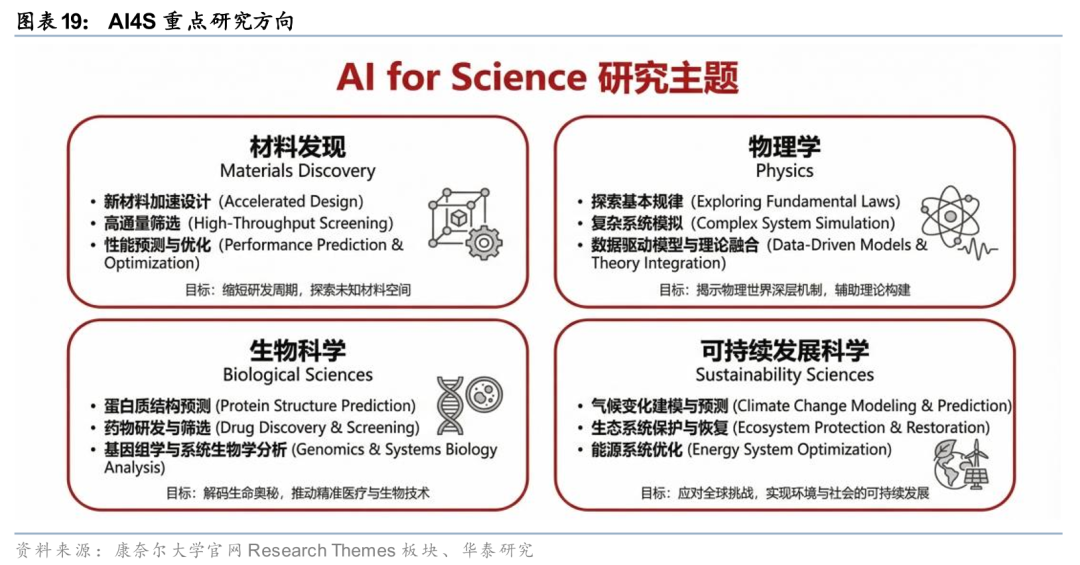

我们认为,AI for Science正从单点辅助工具加速演进为重构科研与产业研发范式的底层能力,在生物医药、材料科学与物理系统等方向持续打开应用空间。在AI制药环节,我们持续看好其在2026年的商业化前景,随着技术边界的拓展与产业化验证的深入,行业将迎来加速发展。此外,我们预计2026年有望成为物理AI加速发展的关键阶段,英伟达、谷歌加速物理AI布局,推动物理AI从实验室走向产业化落地。

AI Coding:国产Claw浪潮涌起,入口与模型是核心壁垒

本月国产Claw产品进入密集发布期,我们认为入口与模型将成为这一轮竞争的核心壁垒。互联网大厂抢占Agent时代的流量入口,模型厂则放大Agent能力并加速Token变现。Claw产品的运行机制决定其Token消耗显著高于普通场景,可能具备更高的幻觉与安全风险。我们判断,Claw类产品有望继续推动Agent应用加速落地,后续壁垒将进一步围绕生态连接深度、模型能力分化,建议持续关注算力、网安及端侧相关机会。

风险提示:宏观经济波动,技术进步不及预期,中美竞争加剧。研报中涉及到未上市公司或未覆盖个股内容,均系对其客观公开信息的整理,并不代表本研究团队对该公司、该股票的推荐或覆盖。

AI模型:复杂任务与推理能力加速类Claw产品落地

近期模型演进的共同指向,是复杂任务执行能力开始成为核心评价维度,类Claw的Agent产品加速落地。据智谱、Google、OpenAI及国内多家Agent产品公开信息,无论是GLM-5引入DSA与异步强化学习以提升长程任务能力,还是Gemini 3.1 Pro、GPT-5.4在推理、编码、工具调用和专业文档处理上的集中强化,其背后都对应着相同的行业趋势,即模型能力评估正从单轮对话、代码片段生成,逐步转向复杂任务交付、跨工具协同和持续在线执行。在模型能力持续提升的情况下,类Claw产品加速落地。我们认为,随着多Agent协同和多工具调用成为常态,Token消耗和算力需求均可能呈现非线性增长。

国内模型:智谱推进基座升级,类Claw产品加快落地

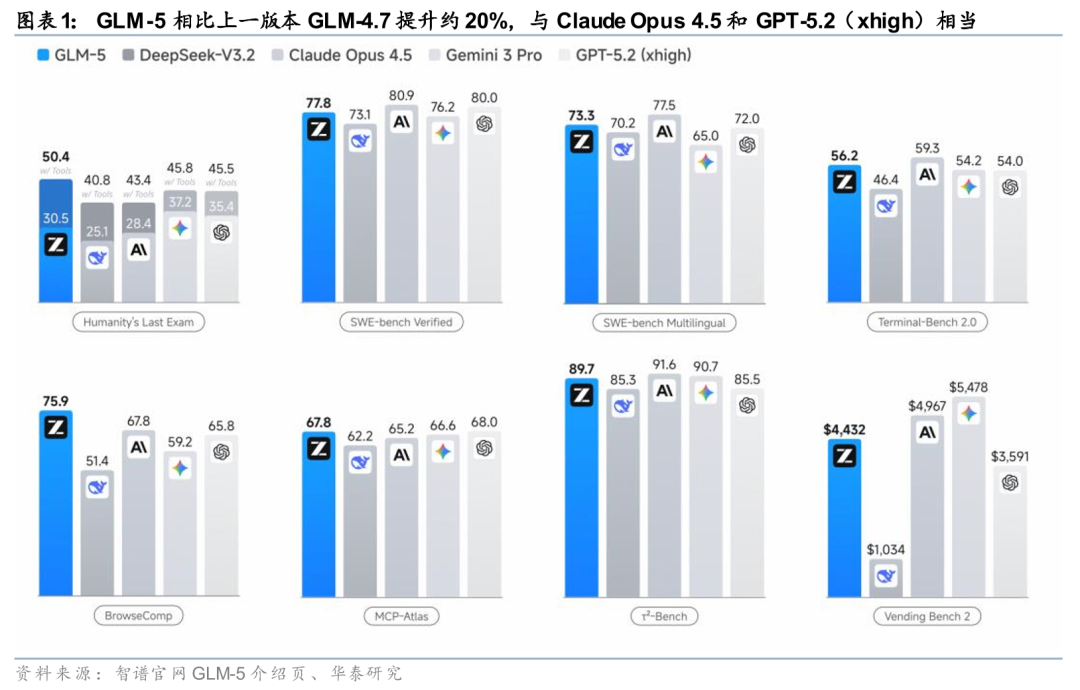

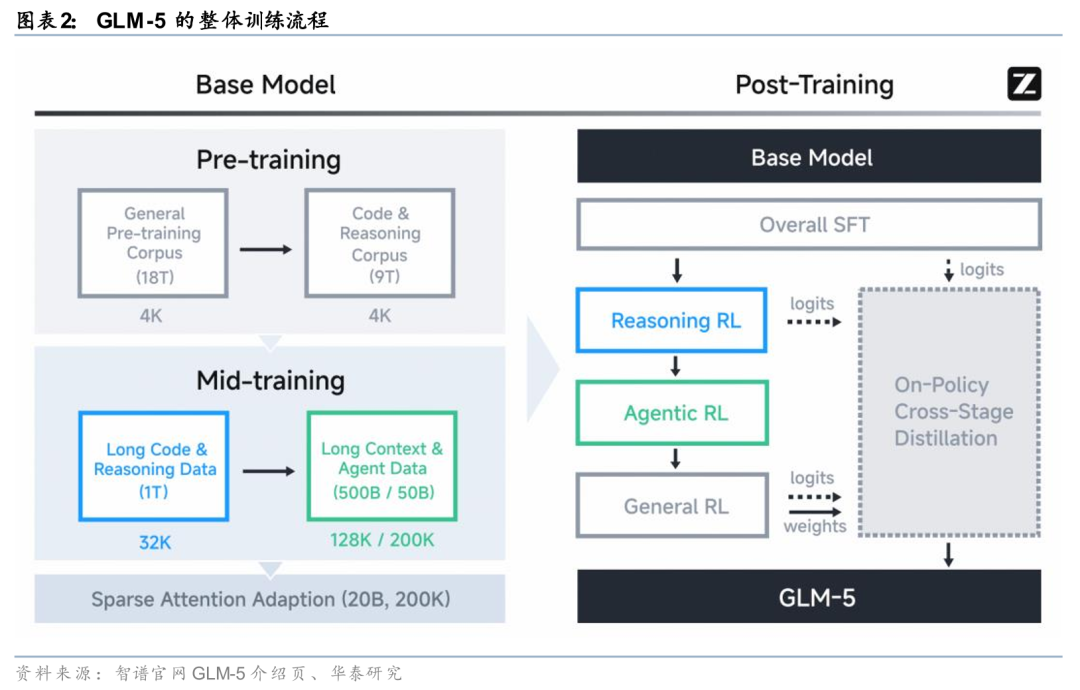

智谱GLM-5把国产模型迭代重点推进到“写工程、做任务”的阶段。据智谱官网2月12日博客,GLM-5强调从“Vibe Coding”向“Agentic Engineering”演进,目标是在复杂系统工程与长程Agent任务中提升端到端交付能力。技术层面,GLM-5参数规模由355B(激活32B)扩展至744B(激活40B),预训练数据由23T提升至28.5T;后训练层面构建了“Slime”异步强化学习框架,并引入异步智能体强化学习算法,使模型能够从长程交互中持续学习;推理层面则首次集成DeepSeek Sparse Attention(DSA)技术,在尽量维持长文本效果的同时降低部署成本并提升Token Efficiency。能力表现上,GLM-5在SWE-bench-Verified、Terminal Bench2.0、BrowseComp、MCP-Atlas、τ²-Bench等编码与Agent基准中均展现出较强竞争力,反映国产开源基座已开始由“生成能力提升”向“任务完成能力提升”过渡。

智谱同步将模型能力向AutoClaw产品侧延展,推动基座升级与产品化协同推进。据智谱官网产品介绍,AutoClaw支持macOS和Windows一键安装,并提供免费体验额度,降低了OpenClaw类产品的使用门槛;在模型接入上,AutoClaw开放任意模型的Coding Plan或API接入,推荐DeepSeek、Kimi、MiniMax、GLM等模型,兼顾灵活性与生态兼容性。与此同时,AutoClaw内置了面向OpenClaw场景优化的Pony-Alpha-2模型,其在工具调用稳定性、任务推进效率和持续执行能力上更适合Skill调用、定时任务等真实工作流;产品还集成AutoGLM Browser-Use能力,以补足复杂浏览器任务执行短板,并预置50 Skills,推动Agent从单轮调用走向连续工作流执行。我们认为,智谱本轮更新的意义不只在于基座能力提升,也在于其开始形成“模型升级—工具增强—产品落地”的完整闭环。

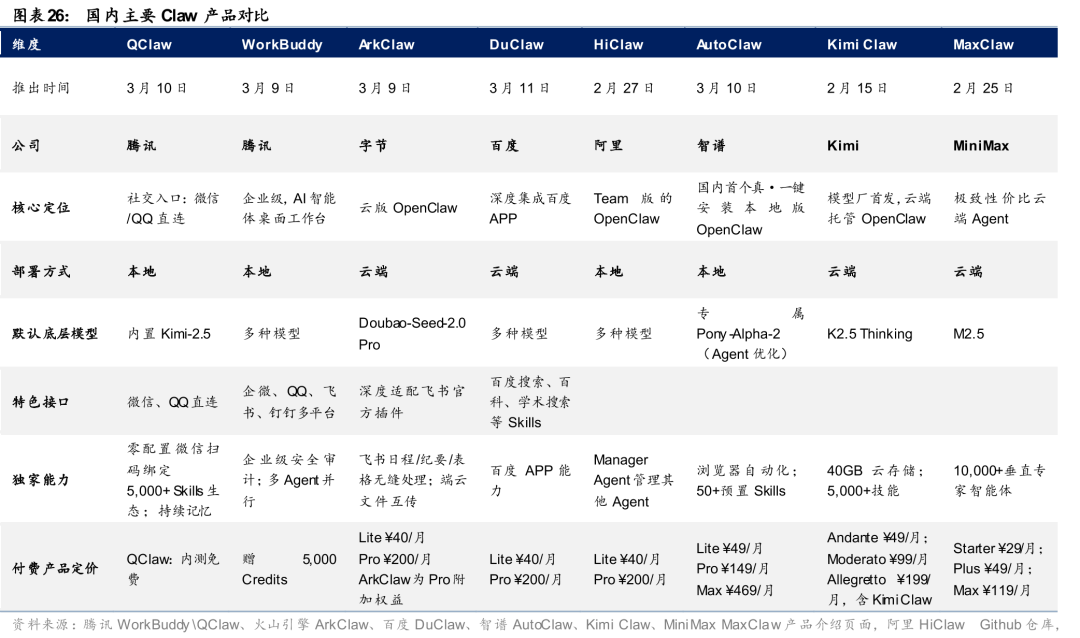

国内类Claw产品正由“能不能用”转向“如何形成工作流产品”的竞争阶段。据MiniMax和Kimi官网产品介绍,当前国内厂商已围绕部署门槛、云端托管、长期记忆、多IM接入和工具生态展开差异化布局。MiniMax方面,MaxClaw作为云端AI助手集成在MiniMax Agent网页端,无需自备服务器或API Key,提供50G云储存空间、长期记忆和持久储存,并打通飞书、钉钉、Telegram、WhatsApp、Discord、Slack等多个IM渠道;工具侧则在图片理解、视频理解、网页提取、搜索等能力基础上新增图片生成、视频生成、图片搜索和网页部署等工具。Kimi方面,Kimi Claw支持一键云端部署或关联既有OpenClaw,提供5000 社区技能、40GB免费空间,并接入专业财经信源实时数据API,同时可直接在kimi.com使用,也支持飞书群调用,目前处于早期实验阶段并向Allegretto及以上会员计划用户开放。上述变化表明,国内厂商已开始把OpenClaw能力嵌入更高频、更低门槛的使用入口,以加快Agent工作台的产品化。

海外模型:Gemini强化推理与Agent,GPT-5.4完善专业工作流闭环

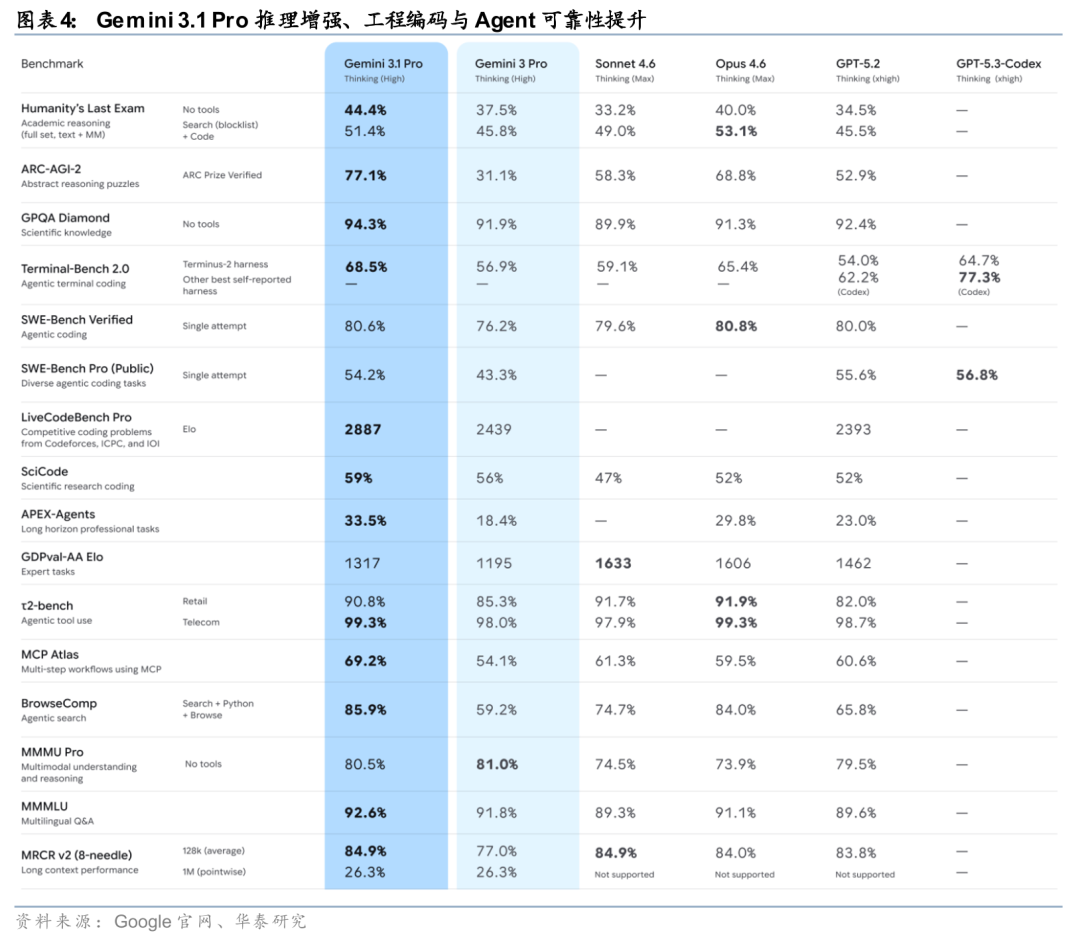

Gemini 3.1 Pro推理增强、工程编码与Agent可靠性提升。据Google官方2月19日发布的博客,Gemini 3.1 Pro已向Gemini API、Vertex AI、Gemini app和NotebookLM rollout,定位为面向复杂任务的升级版基座模型。据Google官方信息,Gemini3.1Pro在ARC-AGI-2上的得分由31.1%升至77.1%,在LiveCodeBench Pro上的Elo由2439提升至2887,SWE-Bench Verified达到80.6%,APEX-Agents由18.4%升至33.5%,BrowseComp达到85.9%;同时Google推出了gemini-3.1-pro-preview-customtools端点,用于优化bash命令与自定义函数混用的Agent场景。API层面,该版本还新增100MB文件上传、YouTube URL视频分析和medium级thinking level,在定价维持与Gemini3Pro一致的前提下,进一步提升了开发者在性能与成本间的调节空间。整体看,Google本轮升级并非单纯追求单点榜单改善,而是在把推理、编码和Agent协作能力收敛为统一的平台能力。

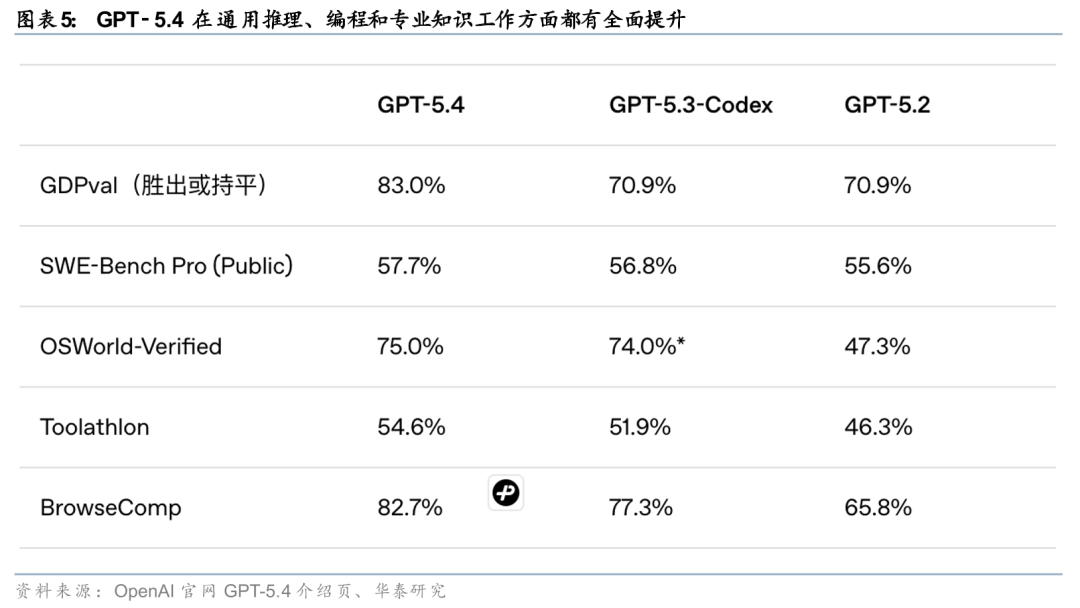

GPT-5.4则继续沿着专业工作、工具协同与Agent执行闭环推进。据OpenAI官方3月5日信息,GPT-5.4已在ChatGPT、API和Codex上线,并被定位为面向专业工作的前沿模型。能力侧,OpenAI明确强调其在电子表格、演示文稿和文档任务中的表现提升,其中在内部投行初级分析师类电子表格建模基准上,GPT-5.4均值达到87.3%,高于GPT-5.2的68.4%;同时,模型在工具、软件环境和智能代理任务中的执行深度也继续增强,并支持原生computer-use能力。效率侧,GPT-5.4引入tool search机制,使模型在面对大量工具时能够按需加载工具定义,OpenAI披露该机制在实现相同准确率的前提下可将总token使用量降低47%,而API价格调整为输入$2.5/百万token、输出$15/百万token。我们认为,OpenAI此次并非只是在做一次模型升版,而是在把专业工作流、工具调用效率和复杂任务执行能力进一步产品化。

GPT-5.4在能力升级的同时也同步上调了API定价,反映出OpenAI正尝试以更强性能和更高Token效率支撑商业化提价。据OpenAI官方页面,GPT-5.4标准版API输入价格由GPT-5.2的$1.75/百万token升至$2.50/百万token,缓存输入价格由$0.175升至$0.25,输出价格由$14升至$15;Pro版输入价格则由$21升至$30,输出价格由$168升至$180。与此同时,OpenAI强调,GPT-5.4是其当前Token效率较高的推理模型,相较GPT-5.2完成相同问题所需Token数显著减少,因此单价上升并不必然对应实际任务成本按比例抬升。我们认为,GPT-5.4此次定价调整体现出OpenAI对高性能专业工作流场景的商业化兑现意图正在增强。

Promptfoo的收购进一步补足了OpenAI在Agent安全评测侧的能力拼图。据OpenAI官网3月9日公告,OpenAI将收购Promptfoo,并计划在交易完成后将其技术整合进OpenAI Frontier平台,以增强AI系统开发阶段的漏洞识别、修复和Agent安全测试与评估能力。若结合GPT-5.4此次对工具生态、软件环境和computer-use能力的强化来看,海外头部厂商的竞争重点已经不只是“模型能否完成任务”,而是“模型能否在真实工具环境中稳定、安全地完成任务”。这意味着海外平台型厂商正同步推进三项建设:1)模型本体的推理与执行能力;2)大规模工具与连接器协同效率;3)面向Agent时代的安全测试与评估框架。上述变化也使海外模型迭代从单一能力竞争,进一步转向平台闭环竞争。

AI算力:Agent叙事强化,LPU商业化进程或加速

Agent生产力革命已来,Token斜率提升加速

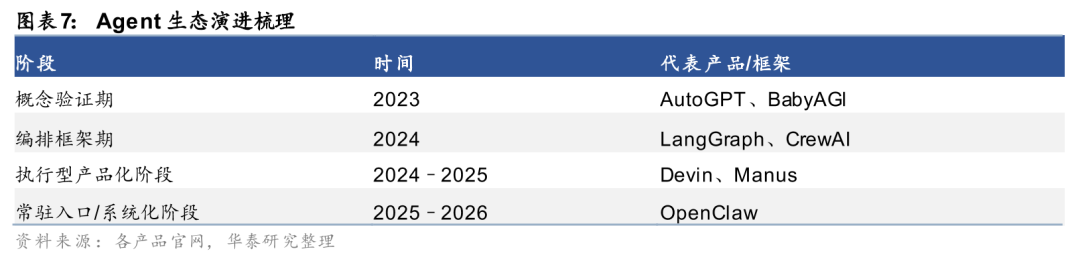

Agent生产力革命已来。回顾早期Agent框架(如AutoGPT、BabyAGI),虽然在技术社区中引发广泛关注,但整体落地程度有限,主要原因包括:1)交互入口仍以开发者环境为主,普通用户使用门槛较高;2)上下文与记忆能力相对有限,智能体难以在较长时间跨度内持续执行任务;3)工具调用机制尚不完善,缺乏稳定的模型路由与工作流封装,导致应用更多停留在演示层面。相比之下,OpenClaw在产品形态与系统架构上进行了更完整的整合。根据其官方文档,OpenClaw已从早期的单一CLI工具扩展为支持Gateway的多渠道系统。同时,通过skills与webtools机制,Agent能够持续扩展外部工具能力模型层面。近期模型更新来看,2月Opus 4.6直接从模型层面推出Agents team架构,多个独立Claude实例模拟人类项目组分工合作;Gemini 3.1 Pro在ARC-AGI-2测评集上能力翻倍,标志着模型逻辑泛化、工具调用、长任务能力提升;3月GPT-5.4更新直接赋予模型原生action能力,可以直接进行任务操作。Agent工程化层面,Claude Cowork、OpenClaw日日更新,各个大厂推出自己的“Claw”产品,Agent正式进入高价值生产工作场景,成为数字劳动力,Agent生产力革命已来。

国内大厂密集发布类Claw产品。自2026年2月起,字节、阿里、腾讯、百度、华为、小米、智谱AI、MiniMax、月之暗面(Kimi)等头部厂商密集发布类Claw产品或适配方案,形成云端SaaS、本地一键部署、企业级定制、IM深度集成四大主流路线。腾讯的代表产品WorkBuddy定位为SaaS形态的AI工作助手,主要嵌入企业微信、QQ及网页入口,在日常办公与协作流程中提供任务执行与信息处理能力。从架构角度看,腾讯更偏向“IM入口 Agent执行层 云服务能力层”:用户通过IM触发任务,Agent完成理解与规划,并通过插件体系调用企业应用或外部服务,底层依托混元大模型与腾讯云能力实现执行。字节跳动的OpenClaw相关能力主要体现在ArkClaw与Coze平台的协同体系。ArkClaw定位企业级AI执行助手,以云端SaaS形态提供服务,主要通过网页及飞书等入口接入;同时,字节通过Coze低代码智能体平台补齐开发侧能力,使企业和开发者能够快速构建并分发自定义Agent,形成“开发平台 执行Agent”的产品组合。

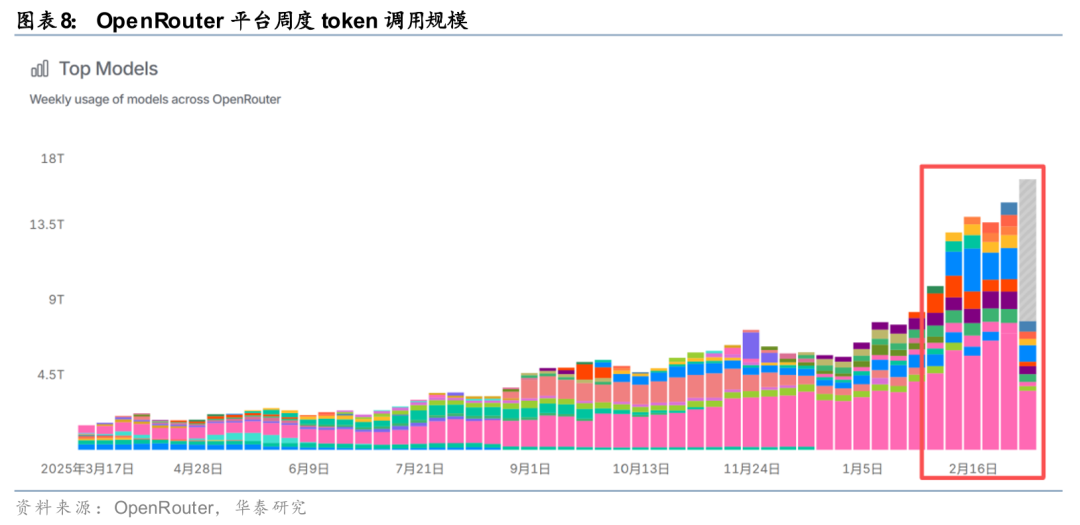

伴随OpenClaw等Agent工具的快速传播,Token消耗斜率加速提升。OpenClaw的快速出圈并非单一产品事件,而更多反映了通用Agent在产品形态和应用生态上的阶段性成熟。Agent对应的是连续任务执行,需要在规划、调用工具、读取环境、回写结果、再次规划的闭环中反复调用模型,因此token消耗不再是线性增加,而更接近随任务复杂度成倍放大。根据我们估计,OpenClaw轻度用户(查资料、简单文件整理)日均token消耗量在100w左右,日常办公场景(高频对话、基础工作自动化)日均token消耗量在500w左右,而重度用户(专业开发、复杂任务)日均token消耗量在2000w左右。根据OpenRouter平台最新数,周度token调用规模至约16 trillion token左右,2个月的时间增长2.5倍以上。根据OpenClaw 3月10日在Reddit披露,目前OpenClaw在OpenRouter平台的日均调用量在600B左右,约占OpenRouter总调用量的28%,占比迅速提升。

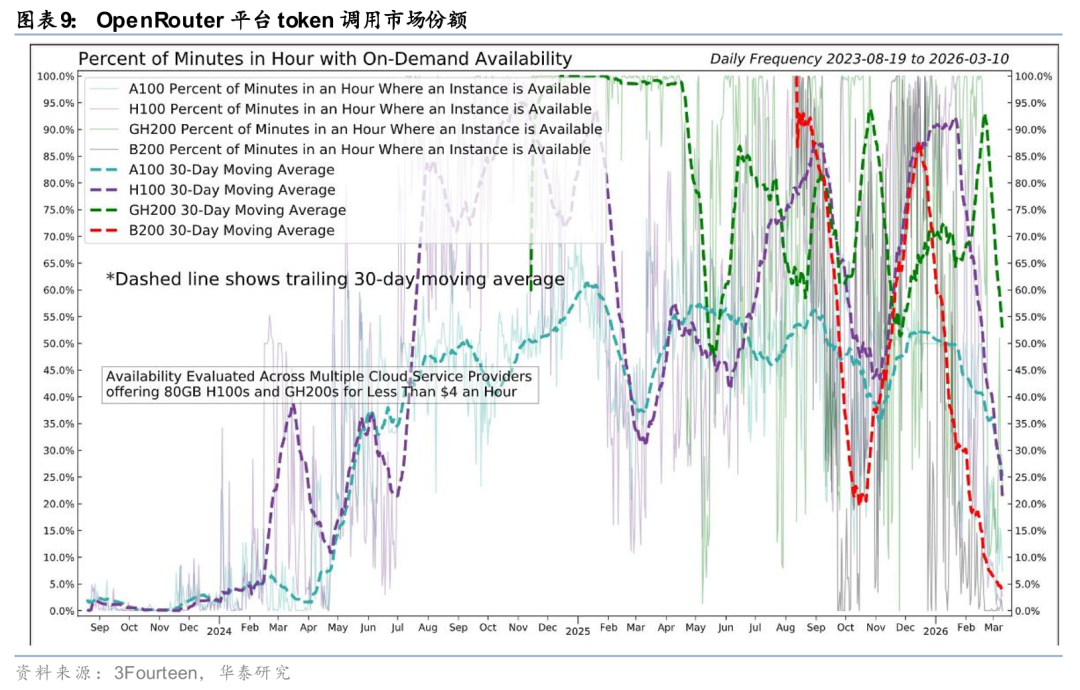

Token激增推动算力租赁市场进入新一轮涨价周期。截至2月底,英伟达高端GPU租赁价格较上月普遍上涨15%-30%,其中H200和H100型号涨幅最为显著,已成为本轮涨价的核心焦点。同时,根据3Fourteen数据,由于模型API Token调用需求的激增,各类GPU即时租赁的供应降至新低。我们认为,类Claw生态的Agent产品加速渗透有望推动推理需求进一步释放,并持续提振算力侧景气度。

展望下一阶段,Agent互联网形成带来算力需求数量级增长。

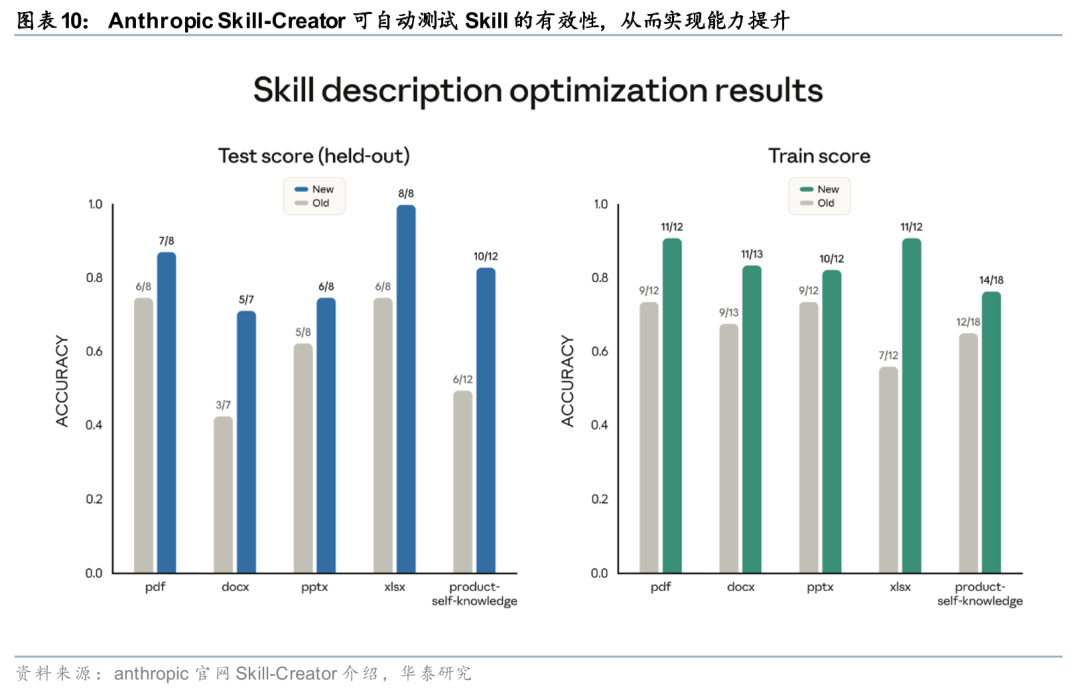

1) Agent具备Skill的自生成与共享能力,泛化技能或将涌现:当前Agent的一大特征为具备自动创建与复用skill的能力,3月3日,Anthropic升级了Skill-Creator用例,可以通过自动测试提升Skill的能力:当 Agent 在执行任务过程中发现新的操作模式或工具组合时,可以将这一流程自动抽象为新的 skill 并存入技能库,供后续任务调用与组合。这意味着 Agent 不再只是被动执行指令,而是能够在运行过程中持续积累能力模块,持续自主的迭代。随着Agent数量增长,这些技能库很可能在社区层面共享与传播,不同Agent之间互相调用能力模块,形成一个由大量自治 Agent 组成的协作网络。展望未来,互联网的交互主体或将不再仅仅是“人类用户-应用”,而会演变为“Agent- Agent-服务”的复杂系统结构,Agent 会代表用户持续执行搜索、分析、交易、编程、运维等长周期任务,并在任务过程中频繁进行多轮推理、工具调用以及跨 Agent 协作。

2) 同时Agent扩散开始具备一定的平台化特征,根据3月10日CNBC报道,Meta已确认收购Moltbook,后者是一家面向AI Agents的社交平台,平台上大量agent由OpenClaw驱动。Meta在公开表述中亦将此次收购与“为个人和企业探索AI Agents的新用途”联系起来。我们认为,这一事件反映出,大厂对Agent的关注已不再局限于模型能力或单点工具,而开始延伸至交互入口、分发场景与生态组织方式。

Agent有望由工具形态进一步向生态形态演进,从而形成“Agent互联网”。在Agent互联网形态下,如果未来出现数亿到十亿级活跃 Agent,并且每个Agent持续执行自动化任务与互相调用技能模块,那么全球AI推理的token消耗规模有可能在当前基础上提升一个数量级甚至数个数量级。

极致性价比带动中国大模型Token出海,国内算力景气度提升

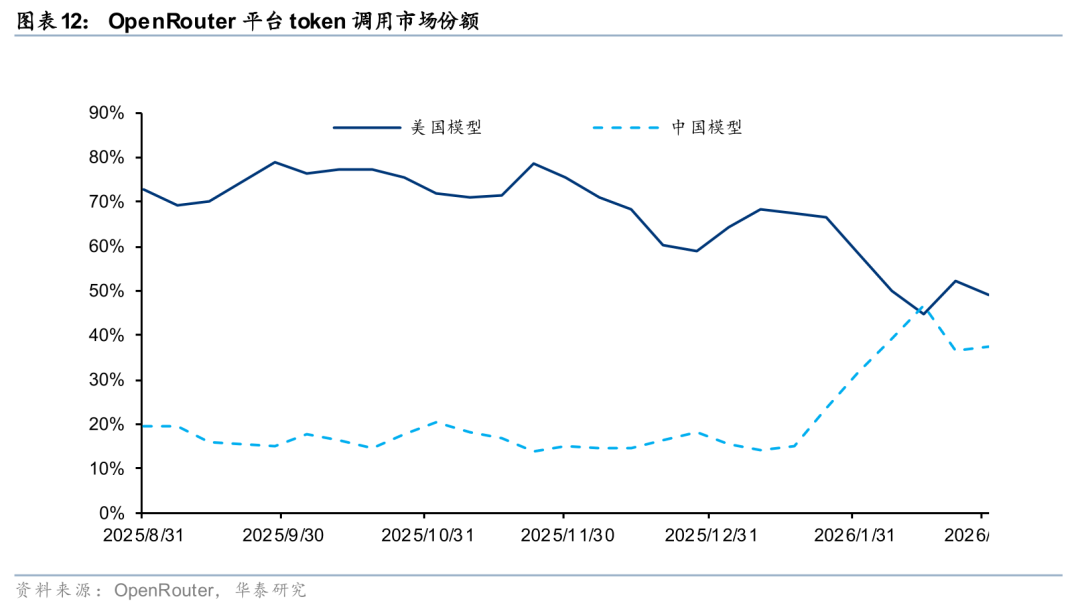

模型能力跃升 极致的成本压缩 算法优化带动中国Token出海。根据Minimax财报,2026 年 2 月,M2 模型系列日均 Token 消耗量是 2025 年 12 月的 6 倍以上;其中#编程场景Token消耗增长超过10倍 。M2.5发布后迅速登顶 OpenRouter 排行榜,得到 OpenClaw创始人的推荐。开放平台(企业客户 个人开发者)2026 年 2 月新注册用户数是 2025 年 12 月的 4 倍以上。2月底OpenRouter平台模型调用来看,由MiniMax、月之暗面、智谱、DeepSeek、阶跃星辰领衔的中国模型Token调用首次超越美国模型,根本原因在于:

1) 随着GLM-5、Minimax 2.5、K2.5等几个新模型发布,模型能力与海外头部接近,在某些任务场景重展现出不俗效果。

2) 更极致的MoE架构(国内模型更加稀疏大幅提升throughput) Infra优化(算法精耕细作提高硬件利用效率) 日常运营与电价优势=中国模型的推理成本极致压缩,进而转化为全球AI服务的定价权,国内模型的平均价格只有海外的1/10。

模型层已出现高端模型拼性能、二线模型拼性价比的格局。海外开发者、初创企业切换至中国模型实现Token出海,而目前OpenClaw单次任务Token调用海量,中国模型有望凭借极致性价比优势持续扩大份额,Token出海趋势有望延续,带动国内算力需求Beta持续向上,行业景气度将从核心算力芯片向AIDC、云与算力服务、配套电力设备及服务器等环节全面外溢。

AI应用:海外悲观预期缓解,国内OpenClaw带动Agent热潮

海外AI应用:多数公司上修26Q1指引,中台化转型初见成效

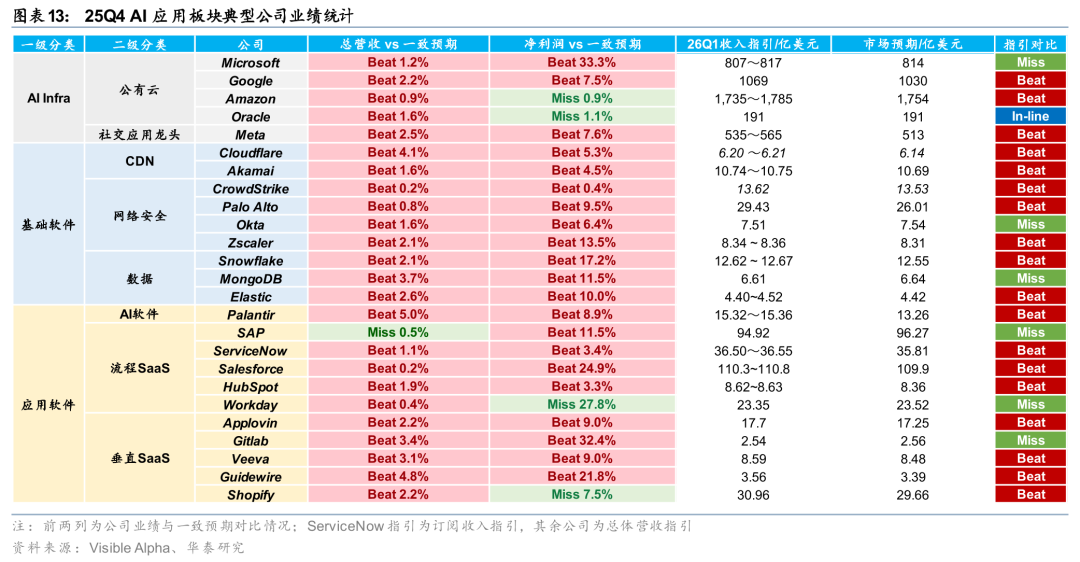

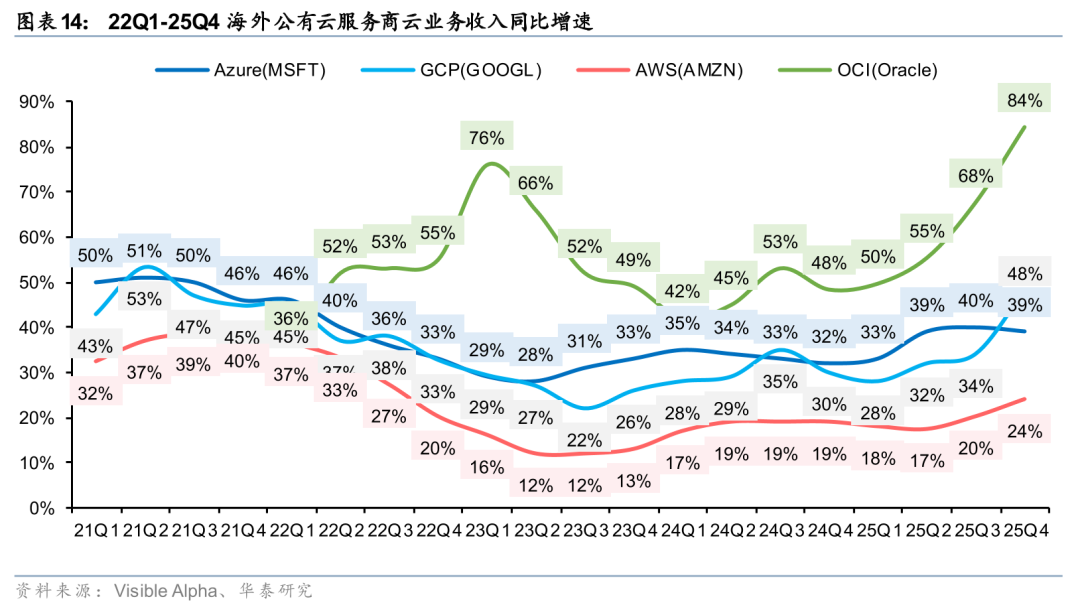

海外科技公司25Q4业绩持续披露,多数公司上修CY26Q1收入指引。25Q4 海外AI应用公司业绩基本超市场预期,CY26Q1收入指引呈小幅上修状态。1)AI Infra:云厂商业绩呈加速兑现趋势,Google、Oracle、Amazon云业务边际显著改善,云业务营收同比增速分别为48%、84%、24%,增速相较于25Q3环比提升14、16、4pct;2)基础软件:SaaS悲观预期下,CDN、数据服务等厂商存在较大错杀概率,主要原因在于到此类厂商多采用消费型计费,存在较低的席位下降风险;3)应用软件:模型厂商Anthropic在26年2月24日产品发布会上表示,“模型厂商与软件厂商是合作而非竞争关系”,介绍了其推出的Claude Cowork AI软件与DocuSign、LegalZoom、Salesforce等应用的数据协同;美股SaaS受模型吞噬的悲观预期略有缓解,核心关注26年应用软件的Agent放量节奏。

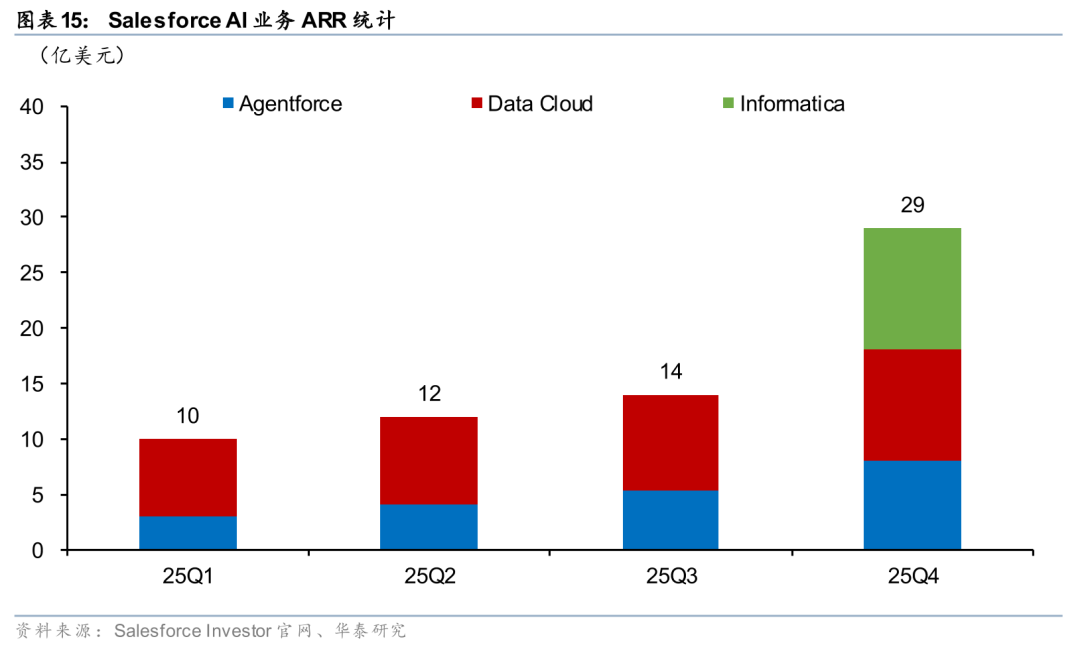

中台化转型初见成效,Agent数据环比加速。海外SaaS加速产品中台化转型,加速推广企业级数据中台、Agent管理平台等中台型产品。我们认为,中台产品有望成为企业级Agent运行的基座,率先实现中台化转型的厂商有望在AI时代占领较大的先发优势与卡位优势。以Salesforce为例,公司AI业务统计口径包括Data Cloud数据中台、Agentforce应用以及Informatica数据服务(25年收购)三类,25Q2-25Q4 Data Cloud ARR环比增速分别为14%、8%、16%,在中台产品逐步导入的基础上,Agent数据呈加速趋势,25Q2-25Q4 Agentforce ARR环比增速分别为33%、35%、48%。我们认为,25年海外SaaS中台化转型初见成效,已完成初步的客户覆盖,看好26年中台基础下的Agent应用放量。

国内AI应用:OpenClaw热潮持续,AI Infra放量可期

国内OpenClaw热潮持续,带动AI infra景气度提升。相较于早期Agent产品,海外的OpenClaw开源项目提供了更加贴近Agent形态的范式参考,即更大的数据权限、更主动的交互模式、更便捷的入口调用。以腾讯为代表的科技大厂迅速推出一键式部署版本,以深圳龙岗、无锡为代表的各地政府也陆续出台支持OpenClaw发展的相关政策文件。我们认为,OpenClaw范式引领下,个人Agent有望在26年加速发展,看好科技大厂的流量入口优势,同时看好Agent放量带动AI Infra(云托管、本地托管、流量分发)需求同步增长。

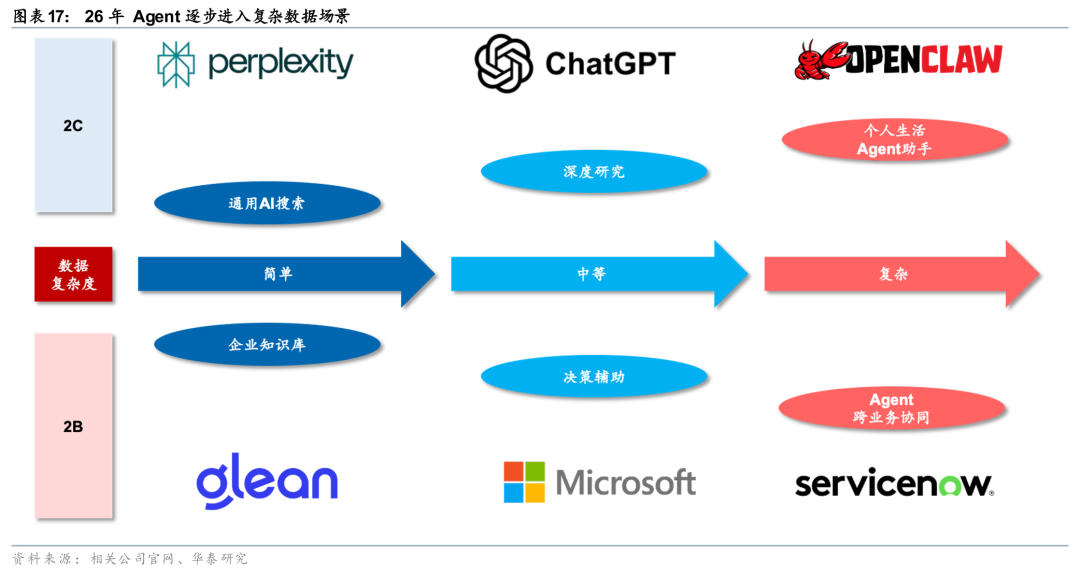

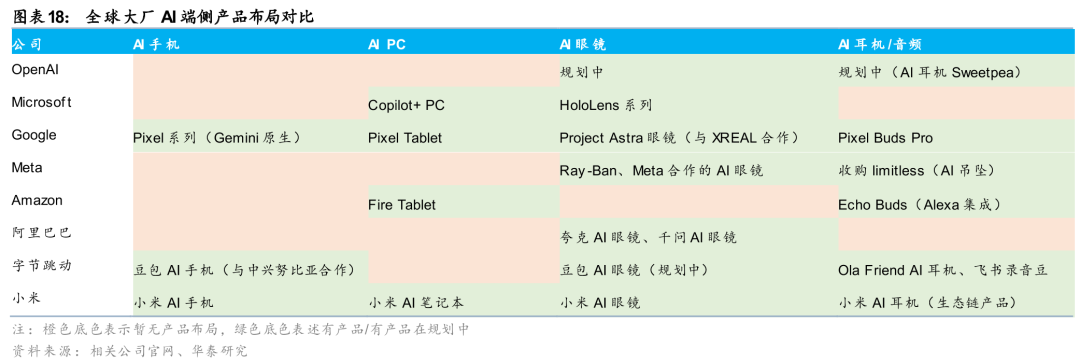

Agent进入复杂数据场景,AI新终端有望创造新数据来源。Agent能力边界拓展与数据访问权限高度相关,2C、2B Agent均逐步进入复杂数据分析场景。1)2C:OpenClaw提供个人Agent的复杂场景案例,用户可通过API配置或Skill调用,拓展“龙虾”的数据访问权限,执行更复杂的任务;2)2B:ServiceNow等软件厂商推出企业Agent平台,通过跨业务系统的数据打通,实现企业Agent的协同编排。我们认为,Agent能力拓展仍需要更多维度的数据拓展,AI眼镜、AI胸针、AI戒指等新AI终端有望成为Agent的数据获取来源,26年大厂的AI终端进展有望加速。以Limitless AI(AI吊坠形态,25年12月被Meta收购)为例,可无感收集用户佩戴时的所有音频信息,实现对话记录、摘要生成等功能,若此类数据进一步成为Agent数据源,个人Agent可执行的任务复杂度有望再度提升。

AI4S:AI制药持续商业化落地,物理AI有望加速发展

2026年,AI for Science作为跨学科创新的核心引擎,在材料科学、量子物理、生物医学与可持续性研究的交叉融合中,正催生多重产业机遇,推动科技与产业生态的深度变革。在材料发现领域,AI技术正重塑新材料研发范式。通过机器学习算法分析海量材料数据,AI可快速预测材料性能、优化合成路径,大幅缩短研发周期。2026年,以“可持续材料”为代表的绿色科技产业将迎来加速发展:AI驱动的环保材料(如可降解塑料、高效储能材料)将加速产业化,助力新能源、航空航天等领域的技术突破。在物理学方向,量子物理与AI的结合推动实用量子计算应用在2026年进入元年,混合量子-经典系统在药物发现和气候建模中实现数百万倍加速。在生物科学领域,AI在生物物理、气候生态系统分析中的作用愈发关键,借助深度学习模型,AI可解析生物分子结构、预测疾病机制,同时,AI驱动的气候模型将提升生态系统预测精度,为碳中和技术、生态保护方案提供数据支撑,带动环保科技产业升级。AI不再仅是科学研究的辅助工具,而是演变为探索物理世界的通用语言,推动从“实验验证”向“计算模拟与预测”的范式转移。

我们认为,2026年有望成为物理AI加速发展元年。以英伟达 Cosmos世界基础模型、谷歌Intrinsic工业机器人平台为代表,“合成数据-仿真训练-Sim-to-Real迁移”的闭环解决了机器人训练数据稀缺和物理测试成本高昂的瓶颈,使AI模型能够真正理解并操控物理实体。商业化场景逐步清晰,从富士康AI机器人电子组装线到建筑业的自主打桩系统,物理AI在制造、物流、能源等重资产行业实现从试点到规模化的跨越,企业客户对自适应生产工具的需求从“效率优化”升级为“柔性制造能力”。

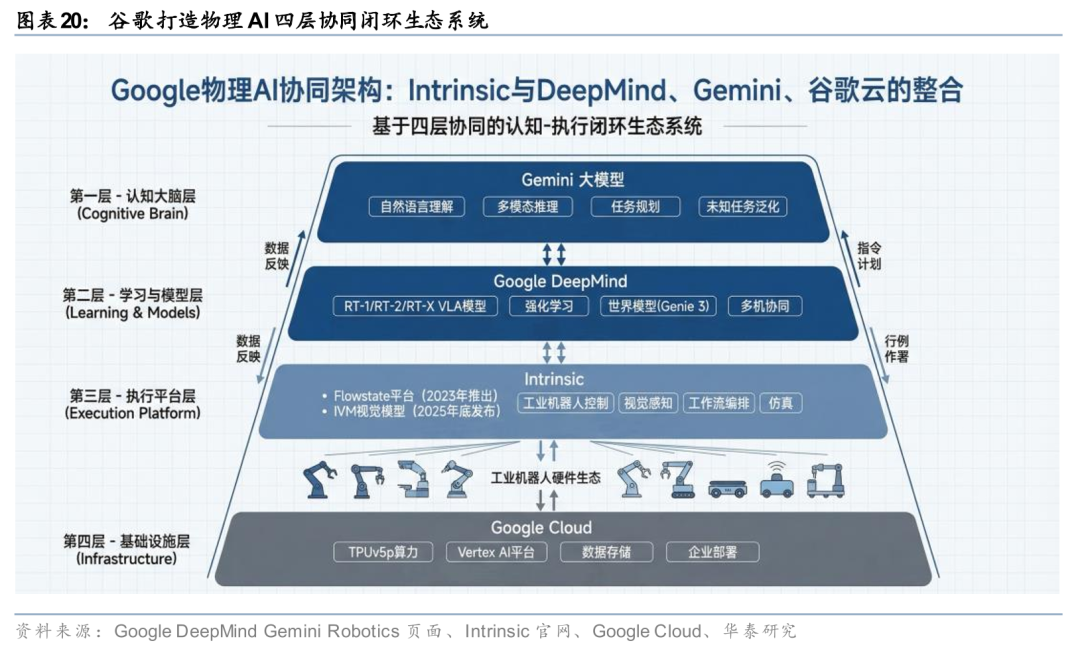

谷歌AI战略布局:加速走向“物理世界AI”

谷歌正通过战略重组构建物理AI时代的核心基础设施。2026年2月25日,Alphabet旗下工业机器人软件公司Intrinsic正式并入谷歌,标志着谷歌从AI算法研发向实体产业操作系统延伸的关键跃迁。此次整合将Intrinsic的工业机器人控制平台与谷歌 DeepMind的顶尖AI研究、Gemini大模型及谷歌云服务深度耦合,旨在为分散的工业机器人市场打造统一的、高度自适应的“安卓系统”。物理AI将从实验室走向规模化产业应用,重塑全球工业自动化的竞争格局与价值链条。谷歌将“机器人执行平台、前沿模型研究、通用多模态大模型、云基础设施”正式收束到同一套物理 AI 软件栈中。从能力分工来看,Gemini承担认知与任务理解,谷歌DeepMind承担机器人学习、VLA 模型与世界模型研究,Intrinsic承担工业机器人控制、视觉、仿真与工作流落地,谷歌云承担算力、部署、数据与企业连接。Gemini 和 DeepMind 的能力向下传导,赋予机器人系统语言理解、视觉推理、策略泛化和动态规划能力;另一方面,Intrinsic 在真实工业环境中获取的感知、任务和执行反馈,又能够通过谷歌云回流,用于模型训练、仿真优化与部署更新。通过四层架构的搭建,形成一个覆盖感知—理解—规划—执行—反馈迭代的完整“物理 AI 闭环”。

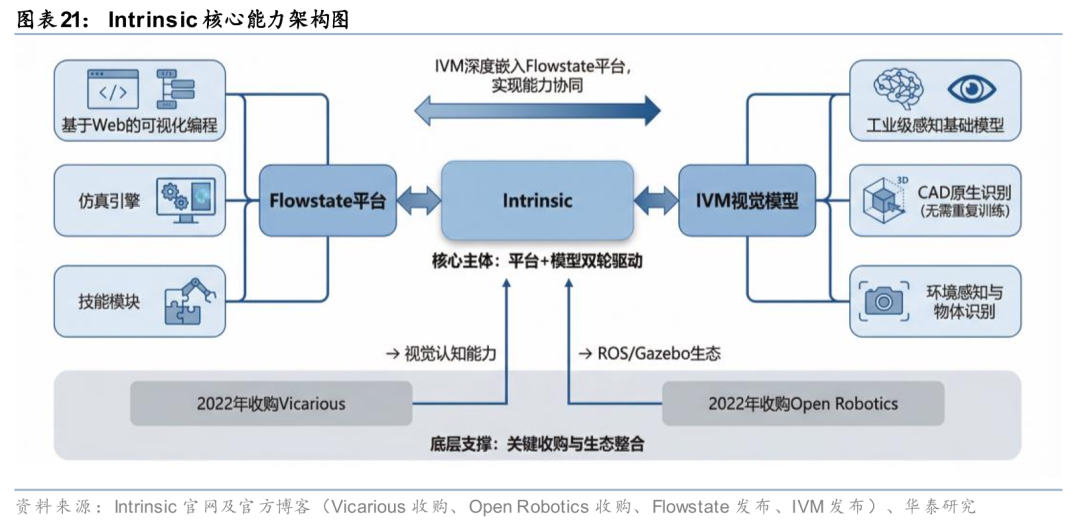

Intrinsic的核心是打造工业机器人的统一软件入口:Flowstate 让开发和部署从工程项目转向模块化工作流,IVM 则让机器人拥有更强的环境理解能力,从而支撑柔性制造。其中,Flowstate解决的是工业机器人“难开发、难部署、强依赖专家”的问题:以Web 化开发环境、可视化编排、仿真引擎、技能模块,将机器人项目从重度定制工程改造成更接近软件配置的流程,目标是把传统需要数周完成的编程压缩到数小时,并让非专业人士也能快速构建自动化工作流。IVM(Intrinsic Vision Model)则解决工业自动化里更难的一层——“看见并理解现场”。IVM作为Intrinsic Intelligence的一部分嵌入 Flowstate,提供环境感知、物体识别、CAD 原生定位等能力,使机器人不再需要针对每个新零件反复采集和训练数据,而能更快切入复杂装配、电子制造等原本依赖人工的工序。

谷歌加速落地物理AI战略,产业发展前景广阔。依托Intrinsic与DeepMind在自适应机器人系统领域的深厚积累,谷歌正推动刚性产线向柔性制造的根本性转变,实现产线重构从天到小时的跨越,精准适配小批量、短周期的生产新常态。同时,借助Gemini的自然语言交互与卓越的视觉理解,工业机器人将加速走出物理围笼,实现高度柔性、直观的人机协同,大幅拓宽汽车、电子、仓储等传统劳动密集型场景的增量市场。谷歌积极进行跨行业生态化布局,致力于将物理AI能力作为底层基础设施,横向复制至建筑、农业、医疗手术等机器人赛道,开辟产业价值第二增长曲线。

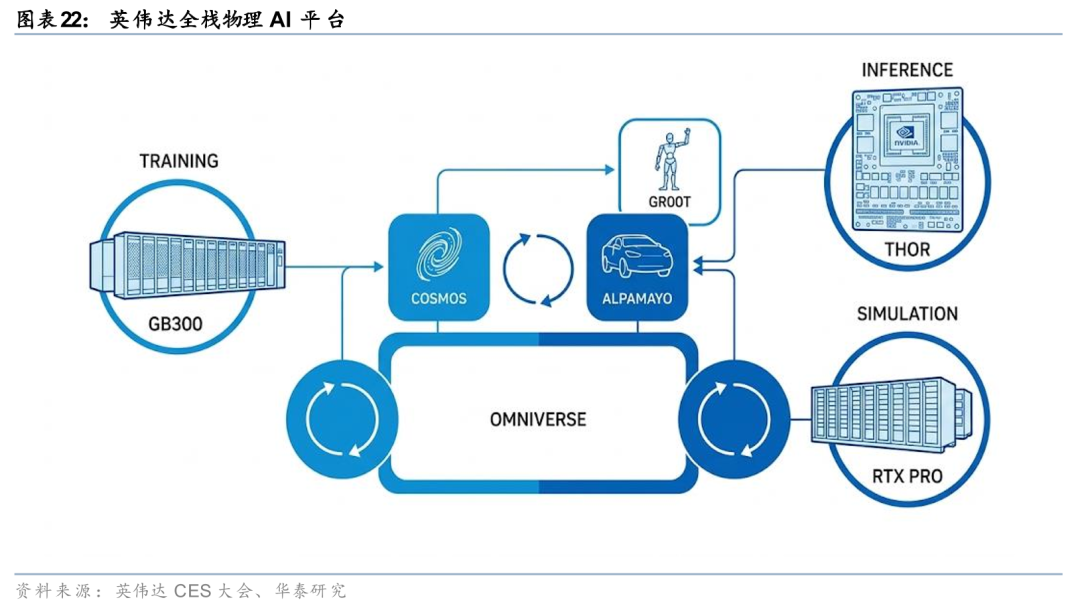

英伟达:物理AI先行者,积极推动产业化落地

英伟达全栈物理AI平台已形成"训练-仿真-推理"三位一体的完整技术闭环。在训练层,以GB300为代表的AI超级计算机为海量模型提供算力底座,支撑复杂物理AI模型的深度学习;在仿真层,RTX PRO专业显卡构建高保真虚拟环境,通过精确物理模拟生成合成数据,构成物理AI研发的基础支撑;在推理层,THOR芯片专为汽车、机器人及工厂边缘场景设计,实现毫秒级实时决策与自主控制。英伟达物理AI战略在2026年全面走向成熟,打通从云端训练到边缘部署的全链路,为机器人灵巧操作、自动驾驶感知决策、智能工厂运营优化等多元场景提供端到端的技术基础设施,加速物理AI从实验室走向产业化落地。

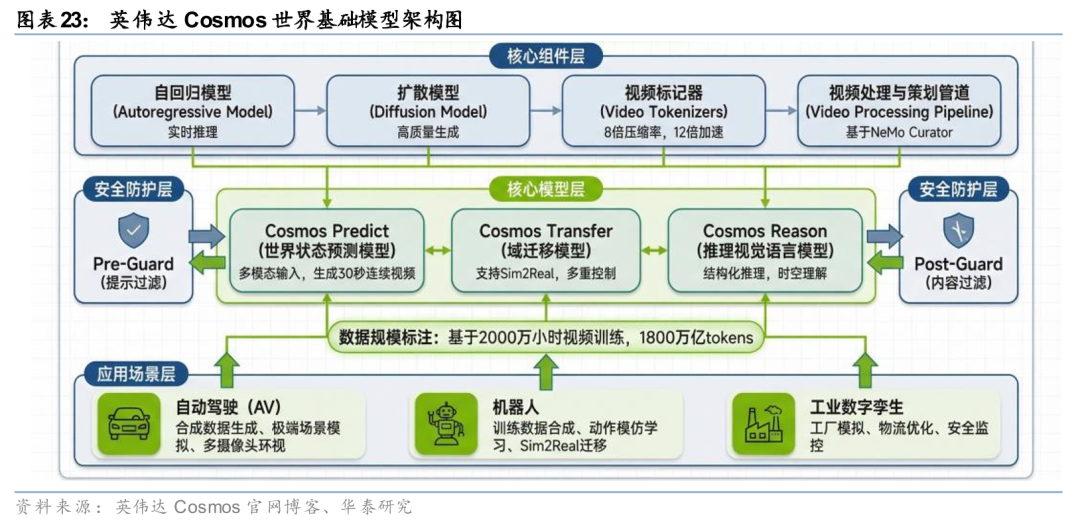

英伟达以Cosmos世界基础模型为核心积极布局物理AI。NVIDIA Cosmos 2.5是世界基础模型平台的核心升级版本,主要包含三大功能模块:Cosmos Predict 2.5统一了文本、图像到视频的生成能力,支持从单张图像或提示生成30秒高保真多机位视频;Cosmos Transfer 2.5体积缩减至前代1/3.5,可从分割图、深度图等结构化输入生成逼真的合成视频数据,实现仿真到现实转换;Cosmos Reason 2.5是专为物理AI设计、开放且可定制的视觉语言模型(VLM),具备物理推理与记忆规划能力,可执行复杂任务路径推断。Cosmos 2.5应用场景覆盖三大领域:机器人开发领域,为1X、Agility Robotics等企业提供大规模合成数据生成,支持机械手抓取、人形机器人训练及手术机器人精密操作;自动驾驶领域,助力Uber、小鹏汽车等生成高保真驾驶场景与长尾边缘案例,提升感知决策能力;工业与医疗领域,赋能仓库动态路线规划、工厂安全监控及手术导航等场景。

AI制药:全球大型药企加速AI竞赛

2026年以来,全球大型药企通过并购基础模型公司、共建算力实验室、深化平台合作等方式,系统构建“算力-算法-数据-实验”一体化体系。阿斯利康1月13日宣布将收购总部位于波士顿的人工智能公司 Modella AI,其多模态基础模型及 AI 智能体平台将被全面整合进阿斯利康的肿瘤研究与开发组织,用于加速临床开发、强化生物标志物发现能力。2026年3月5日,礼来正式启用AI制药工厂LillyPod——该设施搭载超千块英伟达Blackwell Ultra GPU,总算力高达9000 Petaflops,标志着头部MNC正加速推进研发“基建化”与基础设施“私有化”,旨在通过专有数据与自建算力的深度耦合,构建竞争优势。

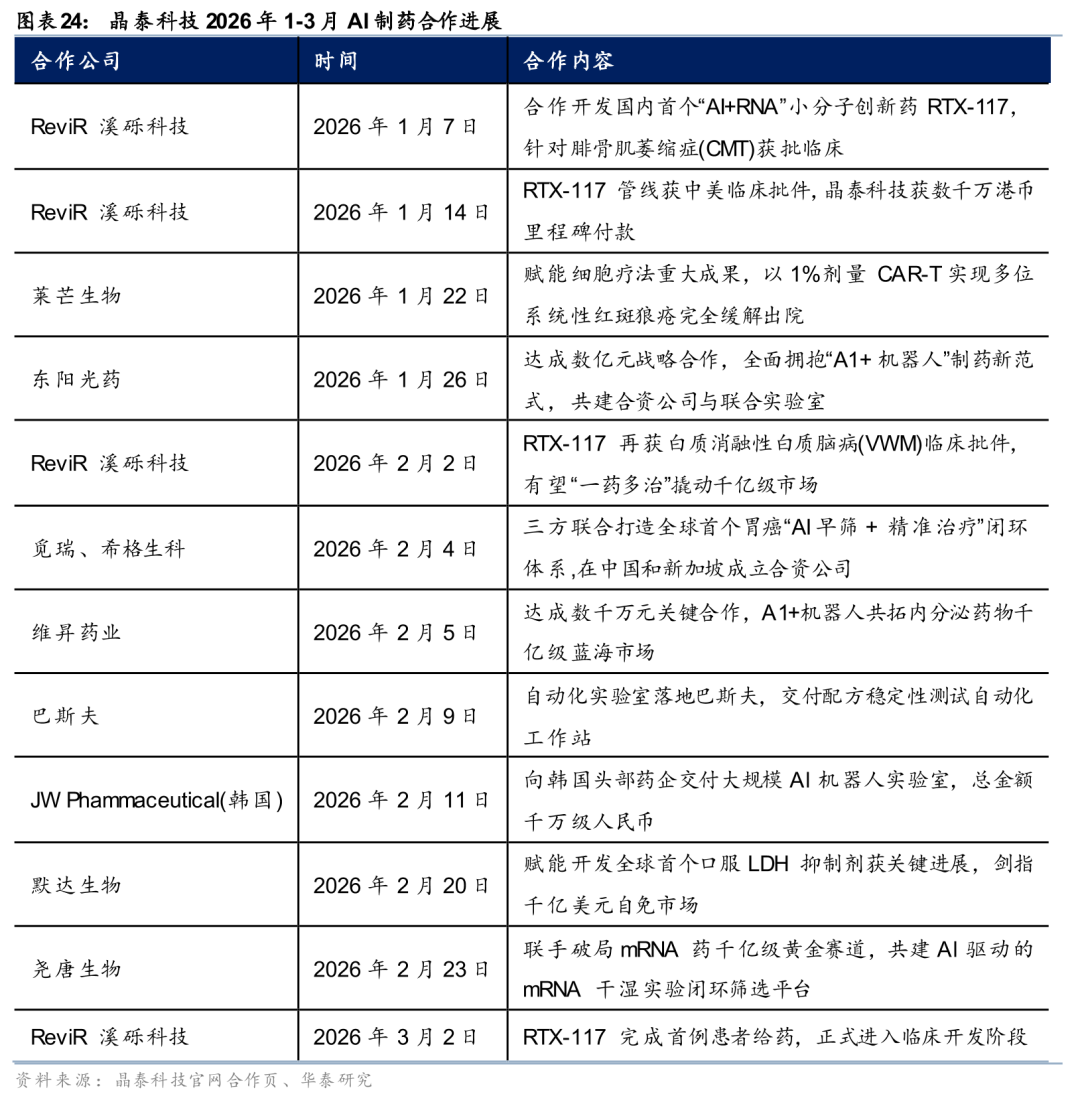

从商业化进展来看,各大型药企合作持续深入,AI制药领域商业化合作持续加速。2026年1月26日,晶泰控股与东阳光药达成数亿元战略合作,共建 AI 机器人联合实验室与非临床药物大模型,实现底层技术与新药管线开发及商业化的全方位合作。同时,晶泰控股孵化企业溪砾科技(ReviR)的创新药管线RTX-117成功实现中美双地IND获批,晶泰收到数千万港币里程碑付款,3月2日,RTX-117完成首例患者给药,正式进入临床开发阶段。

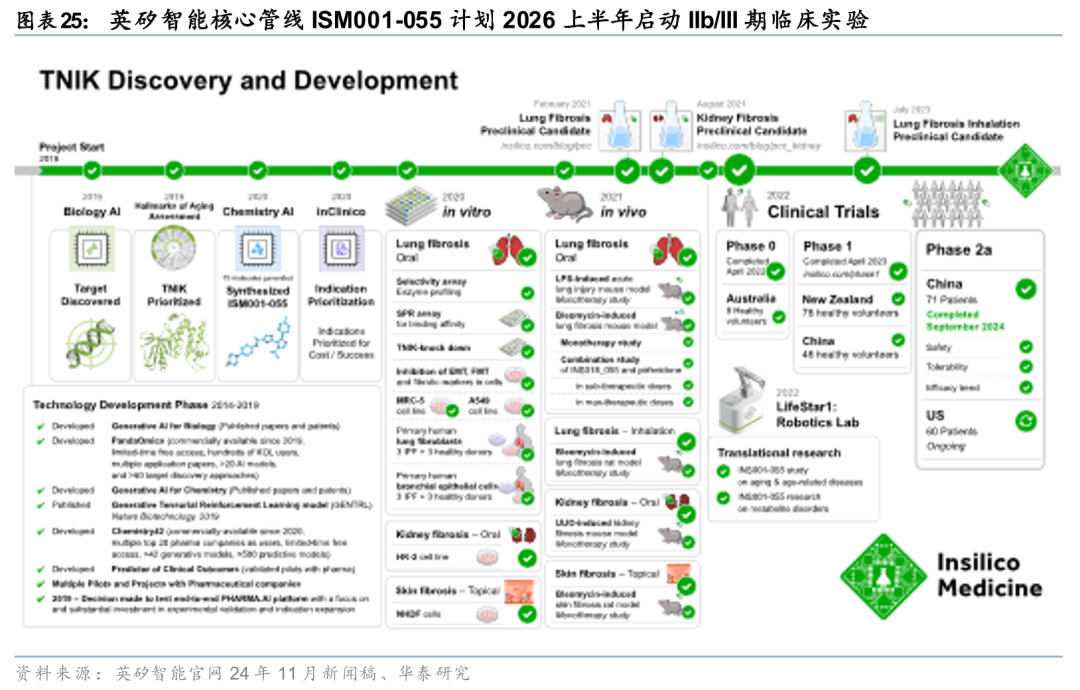

我们持续看好AI制药在2026年的商业化前景,随着技术边界的拓展与产业化验证的深入,行业将迎来加速发展。AI技术加速向小核酸、RNA疗法、细胞治疗等前沿领域渗透,不断拓宽创新药研发边界,为行业开辟第二增长曲线。技术纵深与新领域拓展的并进态势,正重塑药物发现的底层逻辑。临床与产业化验证正成为行业发展的核心主线。晶泰控股合作管线已进入规模化临床验证阶段,英矽智能核心管线ISM001-055作为全球首款由AI发现靶点并设计的小分子抑制剂,也即将在2026上半年启动IIb/III期关键临床研究。

月专题:国产Claw浪潮涌起,入口与模型是核心壁垒

降门槛、抢入口:国产Claw产品共性与分化

OpenClaw具备高部署门槛,国产Claw的共性是降低使用难度。与此前AI工具相比,OpenClaw显著提升了AI的执行能力,使其能够直接操控用户电脑,完成文件管理、邮件处理、代码编写、浏览器自动化等复杂任务。然而,原版OpenClaw的部署需Node.js环境、命令行配置,部署门槛高,对非技术用户不友好,甚至带动了付费上门安装等需求。在此背景下,国内科技公司在数周内密集推出了自己的Claw封装产品,强调一键部署、无需编程、开箱即用,同时接入国产大模型,嵌入本土应用生态,有望将OpenClaw从极客工具转化为大众级生产力产品。

在共性基础之上,各家产品沿云端、本地、平台级产品分化。第一类是云端托管路线(如ArkClaw、DuClaw、Kimi Claw、MaxClaw),主打7×24小时在线、关机后任务仍在云端执行,适合需要持续自动化的场景,但数据流经云端。第二类是本地部署路线(如AutoClaw、QClaw),强调数据不出设备、隐私可控,面向安全敏感型用户。第三类是平台级封装路线(WorkBuddy),我们认为产品形态比较接近Claude推出的Cowork,在具备一定AI执行能力的基础上,叠加企业级安全审计和多平台协同,安全性更强。

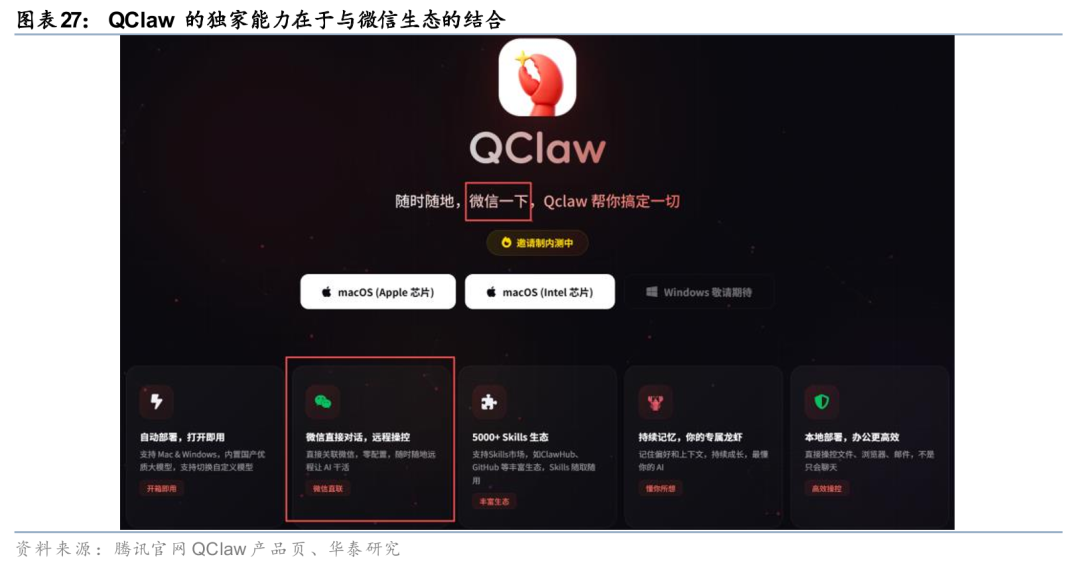

互联网大厂抢占生态入口,模型厂加速模型变现

互联网大厂:以平台入口为锚,抢占Agent时代流量分发权。我们注意到,互联网大厂将OpenClaw相关的AI功能与自身应用深度结合,使其成为Claw产品的核心卖点,例如腾讯接入微信和QQ、字节深度绑定飞书、百度接入百度APP。腾讯的QClaw可以通过微信与AI直接对话,使得用户可以通过微信便捷地使用AI,未来有望调用微信内沉淀的大量信息;虽然普通版本的OpenClaw已经可以与飞书集成,但字节的ArkClaw集成了更多飞书办公套件,实现更深度的应用。我们认为,互联网大厂有望通过Claw类产品将AI的入口从模型层聊天框转移到自身应用聊天框,抢占流量入口的同时提升自身应用的AI能力,并通过云服务变现。

模型厂:以Agent驱动Token消耗,Claw成为模型变现加速器。对于智谱、MiniMax和MoonShot而言,Claw产品最直接的商业价值是驱动自己模型的Token消耗,因为OpenClaw的Token消耗远高于普通对话和编码场景。从产品的差异化上来看,我们认为模型厂的壁垒更多来自模型Agent能力和性价比,例如智谱在AutoGLM中推出专用的Pony-Alpha-2模型,针对OpenClaw的常见场景如Skill调用、定时任务、持续执行等进行优化。

从OpenClaw特点看Claw类产品发展趋势

特点1:运行机制决定了OpenClaw更高的Token消耗

我们认为OpenClaw更快地消耗Token,主要源于任务次数、单任务API调用次数的增长和上下文的增加。将Token的消耗拆为:任务次数×单任务API调用次数×单调用消耗,而单调用消耗又与任务复杂度、上下文长度有关。

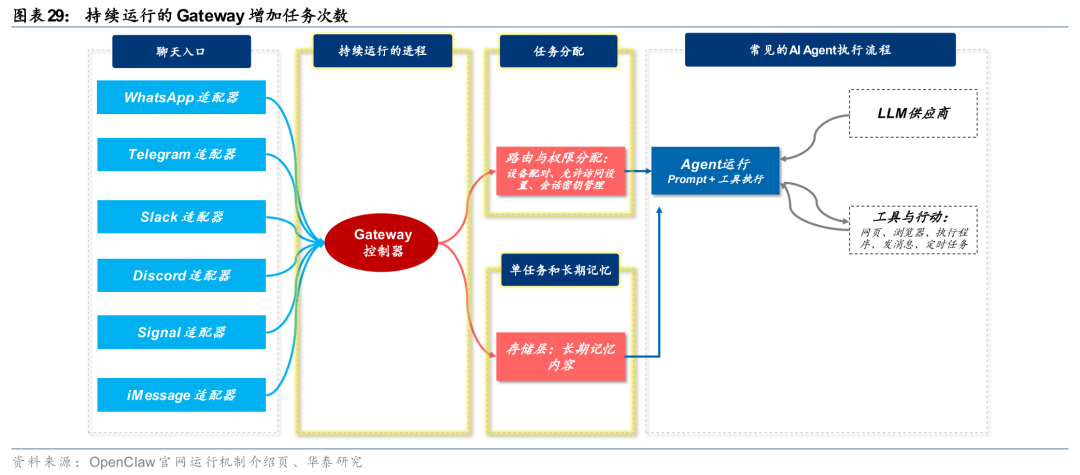

任务次数的增加源于Gateway设计。Gateway可以理解为一个持续运行的线程,正是Gateway使得OpenClaw可以完成需要持续工作的任务和定时任务,而此前的AI一般需要对话才能激活使用。从AI调用上来看,此前的AI是人为线性调用的,而OpenClaw则是Gateway控制下并行调用的。

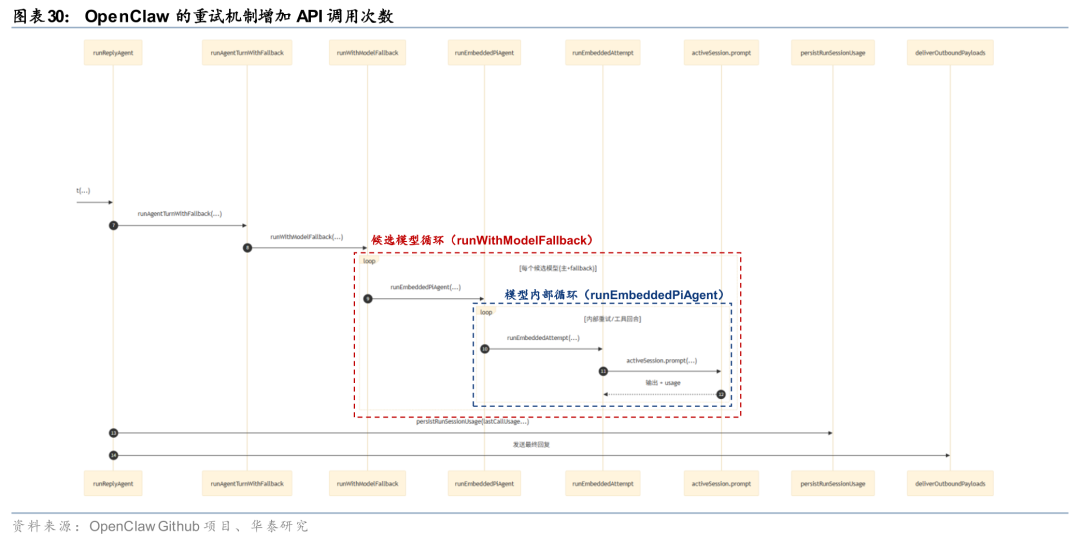

单任务API调用次数的增长与内部重试机制有关。在使用外部AI模型、框架本身无法决定AI能力的情况下,OpenClaw 为提升任务完成率设计了重试机制。其执行路径包含两层循环:第一层是候选模型循环(runWithModelFallback),当主模型出现限流、鉴权失败、超时、模型不可用等情况时,系统会切换到备用模型继续执行;第二层是同模型内部循环(runEmbeddedPiAgent),用于处理上下文溢出后的压缩重试、工具结果截断后重试、鉴权profile轮换等重试。重试机制虽显著提高了OpenClaw的任务执行能力,但客观上会使单个任务进行更多次的API调用,并在每次调用中重复携带会话上下文,导致总Token消耗增加。

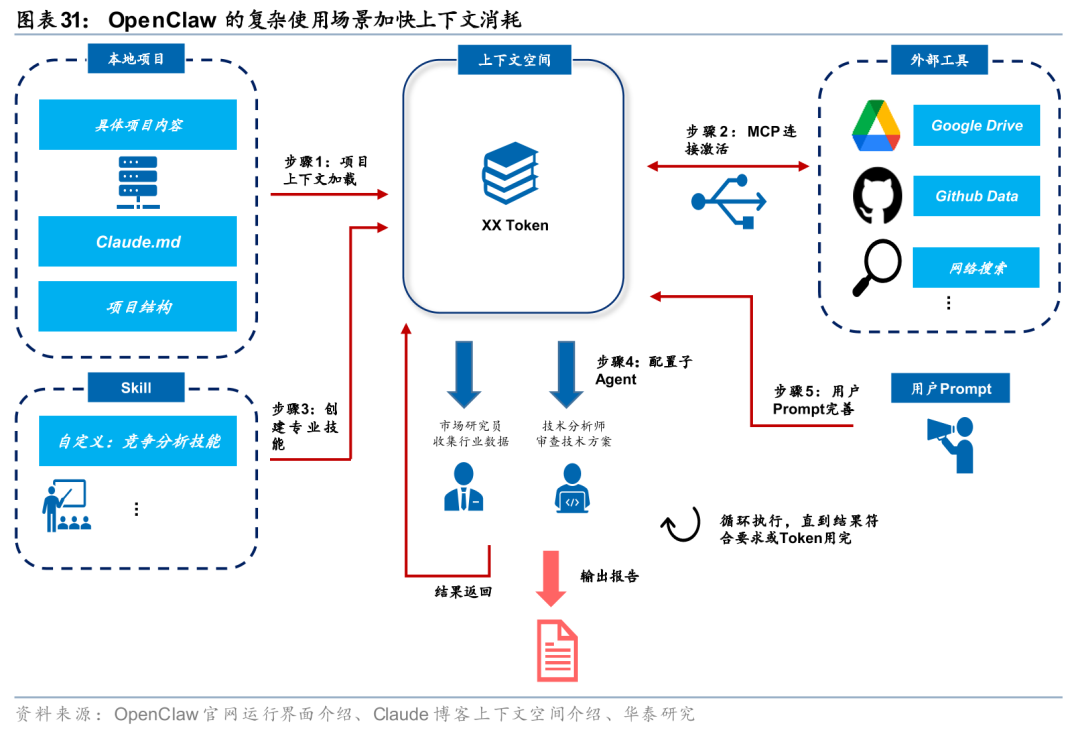

OpenClaw的复杂使用场景增加上下文消耗。OpenClaw能执行更复杂的任务,执行能力的提升部分源于更多的Skill调用和MCP外部工具连接,任务背景包含本地项目、云环境内容,复杂性则体现为更长的任务链路和多轮Prompt调试。在当前模型框架中,这些内容都将作为上下文传递给模型,长上下文将直接导致Token量的增加。此外,当任务上下文到达上限的时候,模型将调用压缩工具压缩上下文然后重新调用,进一步增加了调用次数。

特点2:复杂任务带来更高的幻觉,安全性仍然是推广的重大阻碍

我们认为OpenClaw在使用过程中有更多的幻觉,主要原因是更长的执行链路和更多的上下文压缩次数。OpenClaw可以执行更长链路的任务,涉及AI模型的多次调用,当AI模型的输入来自上一次AI模型的输出时,AI模型的幻觉将被指数级放大。上文中我们分析了OpenClaw的上下文增长速度更快,针对重要性不同的信息OpenClaw采用多种机制对上下文进行压缩,包含对内容进行摘要、修剪或直接删除。因此相较于普通AI,OpenClaw在执行任务时会更快地丢失上下文信息,从而因信息理解不充分而产生幻觉。

OpenClaw的高权限和高幻觉,带来持续的安全隐患。OpenClaw执行本地任务依赖较高的系统权限,在面临模型幻觉和外部攻击的场景下,可能给用户带来安全隐患。3月10日,国家互联网应急中心发布风险提示,强调OpenClaw可能存在的提示词注入、误操作、Skill投毒、安全漏洞风险。根据Cisco官网博客,其Skill扫描工具在31,000个Skill中发现26%至少包含一个漏洞,而一个名为“What Would Elon Do?”的Skill甚至包含两个严重漏洞和五个高危漏洞,能够主动窃取数据以及进行提示词注入。我们认为高权限将使得安全性问题放大,OpenClaw的后续推广依赖安全问题的解决。

产品壁垒沿生态与模型分化,继续看好算力、网安、端侧等环节。

我们认为Claw类产品的壁垒将沿生态与模型分化。互联网大厂的壁垒在于生态连接深度与安全治理能力,自有生态提供了流量入口,并具备天然的Skill集成优势和数据闭环,同时大厂在安全管控和权限分配方面的经验有望成为其重要优势。模型厂的壁垒在于Agent场景下的模型能力、幻觉情况与成本效率,Claw类产品在放大模型能力的同时,也放大了Token成本和安全问题。从整体产业链环节看,我们继续看好算力、网安等环节,运行机制决定了Claw类产品更高的Token消耗,安全问题仍然是产品推广使用的阻碍。

风险提示

宏观经济波动。若宏观经济波动,可能对AI产业资本投入产生负面影响,导致AI产业变革、新技术落地节奏、整体行业增长不及预期。

技术进步不及预期。若AI技术、大模型技术、AI应用进展不及预期,或对行业落地情况产生不利影响。

中美竞争加剧。中美竞争加剧,或影响国内算力基础设施布局,导致国内AI大模型技术迭代速度放缓。

研报中涉及到未上市公司或未覆盖个股内容,均系对其客观公开信息的整理,并不代表本研究团队对该公司、该股票的推荐或覆盖。

VIP复盘网

VIP复盘网