摘要

博通通过和CSP合作开发ASIC/XPU,打破了英伟达“GPU infiniband”的闭合垄断体系,其“开放解耦”网络生态在csp主导capex的时代具有重要意义,建议关注博通产业链。

【博通产业链:核心光模块龙头及上下游供应商】

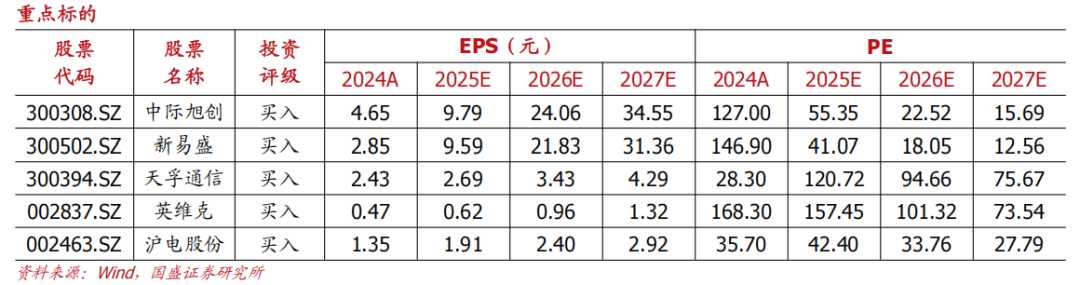

博通作为全球通信半导体巨头,凭借其在网络芯片和定制ASIC领域的深厚积累,成为众多超级客户的xpu合作伙伴。我们建议关注博通官方认可的深度合作伙伴新易盛,全球光模块龙头中际旭创,以及其上下游供应商:优迅股份、东田微、仕佳光子、天孚通信、光库科技等。

优迅股份:国内光通信电芯片龙头。优迅股份专注于光通信前端收发电芯片(LDD、TIA、LA、收发合一芯片)的研发与设计,采用Fabless模式,是光模块龙头电芯片的核心供应商之一。

东田微:卡位光通信上游核心元器件。公司光通信产品矩阵布局完善,WDM 滤光片、z-block 组件、隔离器实现出货。其生产的光隔离器等是高速光模块不可或缺的核心组件,公司作为光模块龙头的上游供应商深度受益光通信高景气。

光库科技:国内领先的光器件供应商。核心产品包括隔离器、合束器、光纤激光器、薄膜铌酸锂调制器等,在隔离器和光纤光栅领域具备技术优势,拥有较高市占率。

仕佳光子:国内领先的光芯片/光器件IDM企业。产品涵盖PLC光分路器芯片、AWG芯片、VOA芯片、DFB激光器芯片、EML激光器芯片、光纤连接器等,在AWG芯片领域具备全球竞争力,是头部模块厂的核心供应商。

天孚通信:光通信上游器件龙头。公司专注于光引擎、FAU(光纤阵列)、隔离器、陶瓷套管等核心光器件,不生产光模块整机,为模块厂提供核心部件。核心产品FAU在全球市占率超50%,在光通信关键环节拥有近乎垄断的地位。

【CSP主导capex下,解耦重要性突显】

博通通过与CSP厂商合作开发定制化ASIC/XPU,构建了开放、解耦、模块化的计算网络生态,打破英伟达“GPU NVLink InfiniBand”的封闭垂直体系。在CSP主导capex的当下,解耦的意义在于:

CSP从“被动采购”转向“自主定义”:在英伟达主导的时代,云厂商只能采购标准化的GPU产品,接受其定价和供应节奏。而博通通过ASIC定制化服务,使CSP厂商能够实现:自研符合自身需求的AI芯片(如谷歌TPU、Meta MTIA);摆脱对单一供应商的依赖,获得更强的议价能力;实现“芯片—互联—系统”一体化设计,优化单位token成本和能效比。

网络层从“私有协议”走向“开放以太网”:英伟达通过NVLink和InfiniBand构建了封闭的高速互联生态,而博通凭借其在高性能以太网交换机芯片领域的绝对优势,为CSP提供了另一种选择。以太网路线的开放性和标准化,使CSP能够自由选择不同厂商的交换机、光模块和网卡,构建解耦的网络生态。

光通信产业链从“单一客户”转向“双市场驱动”:在解耦生态下,光通信厂商不再依附于英伟达体系,CSP代表的开放阵营将长期与英伟达进行竞争博弈,以光通信为代表的网络设备商将同时受益于CSP和英伟达日益增长的互联需求。

博通通过与CSP深度合作开发定制化ASIC/XPU,成功打破了英伟达“GPU InfiniBand”封闭垂直体系的垄断,推动计算网络生态向“开放解耦”演进。在CSP主导capex的当下,解耦的意义在于:CSP从被动采购转向自主定义芯片,网络层从私有协议走向开放以太网,光通信产业链则从依附单一巨头转向“CSP 英伟达”双市场驱动,成长空间显著拓宽。

我们建议关注博通产业链,包括博通官方认可的深度合作伙伴新易盛,全球光模块龙头中际旭创,以及其上下游核心供应商:优迅股份(电芯片)、东田微(隔离器等核心元器件)、仕佳光子(AWG/DFB光芯片)、天孚通信(光引擎/FAU)、光库科技(隔离器/调制器)。在CSP主导资本开支的时代,上述公司作为开放解耦生态的核心受益者,有望伴随博通ASIC客户的放量增长,迎来业绩与估值的双重提升。

建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、太辰光、腾景科技、光库科技、光迅科技、德科立、联特科技、华工科技、源杰科技、剑桥科技、铭普光磁、东田微。铜链接:沃尔核材、精达股份。算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪、海光信息。液冷:英维克、申菱环境、高澜股份。边缘算力承载平台:美格智能、广和通、移远通信。卫星通信:中国卫通、中国卫星、震有科技、海格通信。IDC:润泽科技、光环新网、奥飞数据、科华数据、润建股份。母线:威腾电气等。

数据要素——

运营商:中国电信、中国移动、中国联通。数据可视化:浩瀚深度、恒为科技、中新赛克。

风险提示:AI发展不及预期,算力需求不及预期,市场竞争风险。

1. 投资策略:

博通产业链:解耦的意义

本周建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、太辰光、腾景科技、光库科技、光迅科技、德科立、联特科技、华工科技、源杰科技、剑桥科技、铭普光磁、东田微。

算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪。

卫星通信:中国卫通、中国卫星、震有科技、华力创通、电科芯片、海格通信。

母线:威腾电气等。

数据要素——

本周观点变化:

本周海外算力板块整体走势较好。AI芯片方面,英伟达(NVDA)本周累计上涨1.4%,在GTC 2026大会召开前夕,资金趋于谨慎,AMD本周累计上涨0.5%,博通(AVGO)本周累计下跌2.5%。甲骨文(ORCL)本周公布强劲财报,营收高速增长并维持高额资本支出,3月11日盘前涨超11%,本周累计上涨1.4%,美光科技(MU)、英特尔(INTC)及台积电(TSM)等半导体产业链周中一度同步走强。

我们继续看好光 液冷 太空算力,这三个方向按产业发展阶段,其所对应的风险偏好依次提升。继续推荐算力产业链相关企业如光模块行业龙头中际旭创、新易盛等,同时建议关注光器件“一大五小”天孚通信 仕佳光子/太辰光/长芯博创/德科立/东田微,建议关注国产算力产业链,如其中的液冷环节如英维克、东阳光等。

2. 行情回顾:通信板块下跌,量子通信表现相对最优

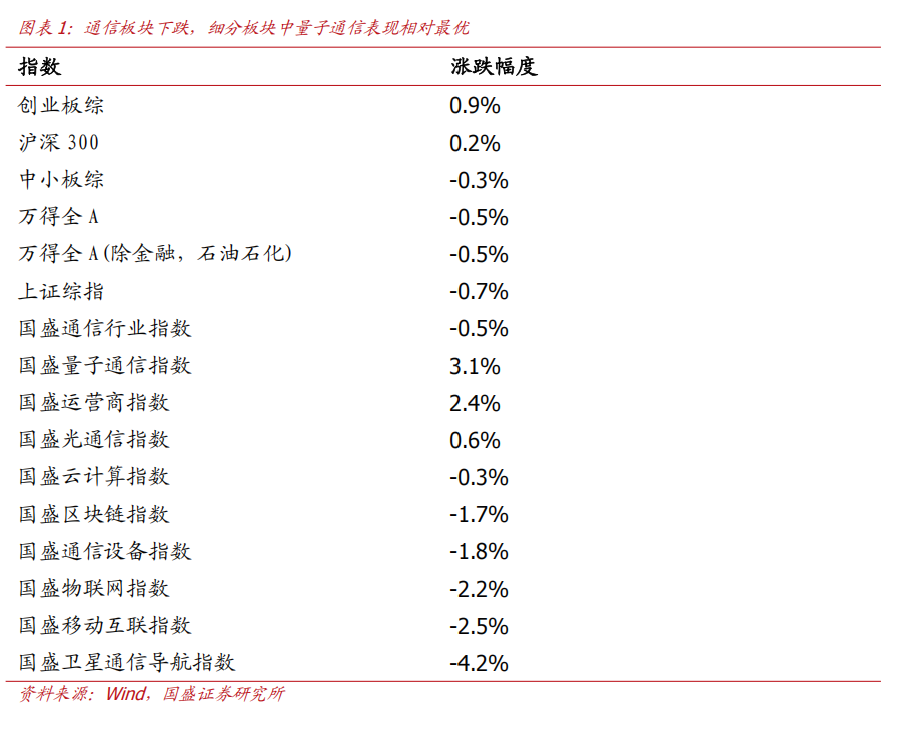

2026年03月09日-2026年03月15日上证综指收于4095.45点。各行情指标从强到弱依次为:创业板综>沪深300>中小板综>万得全A>万得全A(除金融,石油石化)>上证综指。通信板块下跌,表现强于上证综指。

从细分行业指数看,量子通信、运营商、光通信分别上涨3.1%、2.4%、0.6%;云计算、区块链、通信设备、物联网、移动互联、卫星通信导航分别下跌0.3%、1.7%、1.8%、2.2%、2.5%、4.2%。

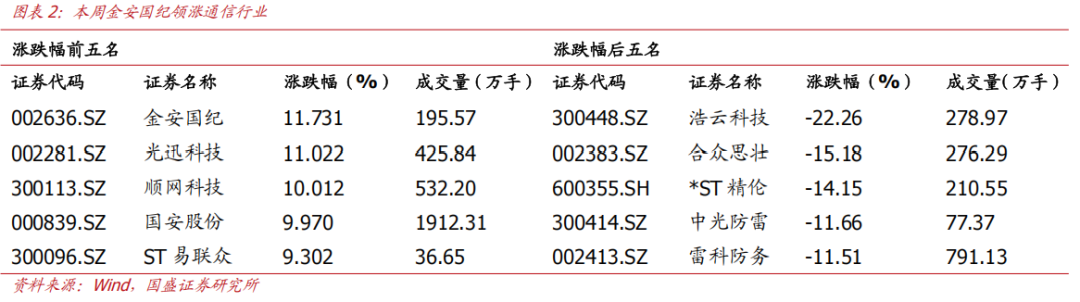

本周受益于PCB概念,金安国纪上涨12%,领涨板块;受益于液冷服务器概念,光迅科技上涨11%;受益于通信服务概念,顺网科技上涨10%;受益于AI智能体概念,国安股份上涨10%;受益于华为概念,ST易联众上涨9%。

3.周专题:

博通产业链:解耦的意义

博通通过和CSP合作开发ASIC/XPU,打破了英伟达“GPU infiniband”的闭合垄断体系,其“开放解耦”网络生态在csp主导capex的时代具有重要意义,建议关注博通产业链。

【博通产业链:核心光模块龙头及上下游供应商】

博通作为全球通信半导体巨头,凭借其在网络芯片和定制ASIC领域的深厚积累,成为众多超级客户的xpu合作伙伴。我们建议关注博通官方认可的深度合作伙伴新易盛,全球光模块龙头中际旭创,以及其上下游供应商:优迅股份、东田微、仕佳光子、天孚通信、光库科技等。

优迅股份:国内光通信电芯片龙头。优迅股份专注于光通信前端收发电芯片(LDD、TIA、LA、收发合一芯片)的研发与设计,采用Fabless模式,是光模块龙头电芯片的核心供应商之一。

东田微:卡位光通信上游核心元器件。公司光通信产品矩阵布局完善,WDM 滤光片、z-block 组件、隔离器实现出货。其生产的光隔离器等是高速光模块不可或缺的核心组件,公司作为光模块龙头的上游供应商深度受益光通信高景气。

光库科技:国内领先的光器件供应商。核心产品包括隔离器、合束器、光纤激光器、薄膜铌酸锂调制器等,在隔离器和光纤光栅领域具备技术优势,拥有较高市占率。

仕佳光子:国内领先的光芯片/光器件IDM企业。产品涵盖PLC光分路器芯片、AWG芯片、VOA芯片、DFB激光器芯片、EML激光器芯片、光纤连接器等,在AWG芯片领域具备全球竞争力,是头部模块厂的核心供应商。

天孚通信:光通信上游器件龙头。公司专注于光引擎、FAU(光纤阵列)、隔离器、陶瓷套管等核心光器件,不生产光模块整机,为模块厂提供核心部件。核心产品FAU在全球市占率超50%,在光通信关键环节拥有近乎垄断的地位。

【CSP主导capex下,解耦重要性突显】

博通通过与CSP厂商合作开发定制化ASIC/XPU,构建了开放、解耦、模块化的计算网络生态,打破英伟达“GPU NVLink InfiniBand”的封闭垂直体系。在CSP主导capex的当下,解耦的意义在于:

CSP从“被动采购”转向“自主定义”:在英伟达主导的时代,云厂商只能采购标准化的GPU产品,接受其定价和供应节奏。而博通通过ASIC定制化服务,使CSP厂商能够实现:自研符合自身需求的AI芯片(如谷歌TPU、Meta MTIA);摆脱对单一供应商的依赖,获得更强的议价能力;实现“芯片—互联—系统”一体化设计,优化单位token成本和能效比。

网络层从“私有协议”走向“开放以太网”:英伟达通过NVLink和InfiniBand构建了封闭的高速互联生态,而博通凭借其在高性能以太网交换机芯片领域的绝对优势,为CSP提供了另一种选择。以太网路线的开放性和标准化,使CSP能够自由选择不同厂商的交换机、光模块和网卡,构建解耦的网络生态。

光通信产业链从“单一客户”转向“双市场驱动”:在解耦生态下,光通信厂商不再依附于英伟达体系,CSP代表的开放阵营将长期与英伟达进行竞争博弈,以光通信为代表的网络设备商将同时受益于CSP和英伟达日益增长的互联需求。

博通通过与CSP深度合作开发定制化ASIC/XPU,成功打破了英伟达“GPU InfiniBand”封闭垂直体系的垄断,推动计算网络生态向“开放解耦”演进。在CSP主导capex的当下,解耦的意义在于:CSP从被动采购转向自主定义芯片,网络层从私有协议走向开放以太网,光通信产业链则从依附单一巨头转向“CSP 英伟达”双市场驱动,成长空间显著拓宽。

我们建议关注博通产业链,包括博通官方认可的深度合作伙伴新易盛,全球光模块龙头中际旭创,以及其上下游核心供应商:优迅股份(电芯片)、东田微(隔离器等核心元器件)、仕佳光子(AWG/DFB光芯片)、天孚通信(光引擎/FAU)、光库科技(隔离器/调制器)。在CSP主导资本开支的时代,上述公司作为开放解耦生态的核心受益者,有望伴随博通ASIC客户的放量增长,迎来业绩与估值的双重提升。

4.腾讯版“小龙虾”WorkBuddy 上线:下载安装就能用,兼容 OpenClaw 技能

据IT之家报道,3月9日,据腾讯云官方微信公众号消息,腾讯旗下全场景 AI 智能体 WorkBuddy 正式上线。

据介绍,WorkBuddy 完全兼容 OpenClaw 的技能,同时还做到了更易用、更安全、更懂办公。

据IT之家了解,在官网下载安装后,直接输入指令就能让 WorkBuddy 帮干活;如果用户想通过企业微信远程“遥控”,最快 1 分钟即可完成配置并连接。此外,它还能接入 QQ、飞书、钉钉等工具。这意味着,哪怕你在外通勤,只需掏出手机发条语音,它就能在你的办公电脑上自动查资料、写推文,直接交付可验收的结果。官网介绍如下:

WorkBuddy 不是一个只会聊天的网页框,而是“能听懂人话、带脑子思考”的桌面智能体。它内置了超 20 种 Skills 技能包与 MCP 协议。无论是海报生成还是自动化报表,都能一键导入或零代码新建,能力可以做到无限扩展。

WorkBuddy 甚至支持多窗口、多 Agent 并行工作。把复杂任务动态拆解,几个 AI 同步开工,让生产力直接拉满。想要用什么模型给你打工,你还可以自己定 —— WorkBuddy 国内版无缝切换 Hunyuan、DeepSeek、GLM、Kimi、MiniMax。

更重要的是,它还补齐了开源工具最缺的一环:企业级安全与管理。基于同源的腾讯 CodeBuddy 架构,它打通了统一账号与计费体系,具备完善的安全审计能力,让个人用得爽,更让企业用得放心。

在正式发布前,这位 AI 同事已经在腾讯内部经历了严苛的试用期。目前,已有超过 2000 名 HR、行政、运营等非技术同事,用它搞定了数据分析和自动化办公。

同源的 AI 编程工具 CodeBuddy 更是交出了一份不俗的成绩单:腾讯内部超 90% 工程师都在用,AI 生成代码占比超 50%,整体编码时间平均缩短 40% 以上,研发提效超 20%!

5. 阿里版“OpenClaw 龙虾”应用内测,“无影 JVS”更名为“JVS Claw”

据IT之家报道,3月10日,据《读佳》今日报道,年初内测的阿里版 OpenClaw“无影 JVS”,在近日更名为“JVS Claw”,可能也是为产品的最终上线做准备。

报道称,“JVS Claw”目前有独立 App 和网页版,不过均处于内测阶段,需要申请邀请码体验,内测期间,每位用户可创建 1 个 bot,免费模型额度为 8000Credits,有效期 14 天。

这款 AI 产品以可定制、可进化的 Clawbot 为核心,搭配独立云端 ClawSpace 环境。JVS Claw 打造了类似“AI 应用商店”的技能查找功能,用户可在对话中随时搜索、安装、卸载或更新来自 ClawHub 的前沿技能。

IT之家注意到,OpenClaw 赛道近期迎来大厂密集入局,腾讯、字节、百度等相继推出相关服务。腾讯云发布全场景 AI 智能体 WorkBuddy。字节跳动火山引擎也上线开箱即用的云上 SaaS 版 OpenClaw —— ArkClaw。百度智能云推出了可视化快捷部署服务,通过官方教程的四步指引,宣称零基础的技术小白也能轻松在线安装 OpenClaw。

6. 权限太高,国家互联网应急中心发布 OpenClaw 安全应用的风险提示

据IT之家报道,3月10日,国家互联网应急中心官方微信公众号发布了《关于 OpenClaw 安全应用的风险提示》。IT之家附原文如下:

近期,OpenClaw(“小龙虾”,曾用名 Clawdbot、Moltbot)应用下载与使用情况火爆,国内主流云平台均提供了一键部署服务。此款智能体软件依据自然语言指令直接操控计算机完成相关操作。为实现“自主执行任务”的能力,该应用被授予了较高的系统权限,包括访问本地文件系统、读取环境变量、调用外部服务应用程序编程接口(API)以及安装扩展功能等。然而,由于其默认的安全配置极为脆弱,攻击者一旦发现突破口,便能轻易获取系统的完全控制权。

前期,由于 OpenClaw 智能体的不当安装和使用,已经出现了一些严重的安全风险:

1.“提示词注入”风险。网络攻击者通过在网页中构造隐藏的恶意指令,诱导 OpenClaw 读取该网页,就可能导致其被诱导将用户系统密钥泄露。2. “误操作”风险。由于错误的理解用户操作指令和意图,OpenClaw 可能会将电子邮件、核心生产数据等重要信息彻底删除。3.功能插件(skills)投毒风险。多个适用于 OpenClaw 的功能插件已被确认为恶意插件或存在潜在的安全风险,安装后可执行窃取密钥、部署木马后门软件等恶意操作,使得设备沦为“肉鸡”。4.安全漏洞风险。截止目前,OpenClaw 已经公开曝出多个高中危漏洞,一旦这些漏洞被网络攻击者恶意利用,则可能导致系统被控、隐私信息和敏感数据泄露的严重后果。对于个人用户,可导致隐私数据(像照片、文档、聊天记录)、支付账户、API 密钥等敏感信息遭窃取。对于金融、能源等关键行业,可导致核心业务数据、商业机密和代码仓库泄露,甚至会使整个业务系统陷入瘫痪,造成难以估量的损失。

建议相关单位和个人用户在部署和应用 OpenClaw 时,采取以下安全措施:

1.强化网络控制,不将 OpenClaw 默认管理端口直接暴露在公网上,通过身份认证、访问控制等安全控制措施对访问服务进行安全管理。对运行环境进行严格隔离,使用容器等技术限制 OpenClaw 权限过高问题;2.加强凭证管理,避免在环境变量中明文存储密钥;建立完整的操作日志审计机制;3.严格管理插件来源,禁用自动更新功能,仅从可信渠道安装经过签名验证的扩展程序。4.持续关注补丁和安全更新,及时进行版本更新和安装安全补丁。

7.博通发布单通道400G PAM4 DSP,助力打造更低成本、更低功耗1.6T光模块

据C114报道,博通发布其3nm工艺的单通道400G PAM-4 DSP——Taurus™ BCM83640,该产品针对1.6T光模块解决方案优化,具备前所未有的带宽密度与能效。其采用400G/通道串行光接口,助力光模块制造商以更低成本交付低功耗1.6T可插拔模块,满足AI数据中心日益增长的带宽需求。

Taurus™ BCM83640是集成激光驱动器的单片3纳米1.6T(8:4)PAM-4数字信号处理器,在误码率(BER)和功耗方面业界领先,已验证与博通400G EML和PD的互操作性,同时符合所有IEEE和OIF标准,支持芯片至模块电接口的长距链路,支持从1.6T到3.2T的光模块。

400G/通道技术是200G/通道架构的下一代演进,为高性能网络和AI基础设施的带宽扩展迈出了关键一步。采用Taurus BCM83640的1.6T可插拔模块将每条光通道的带宽提升一倍,在1U高度系统中实现高达102.4T的交换容量,显著提升AI光互连的带宽密度。

此外,400G/通道光接口的部署也为未来基于400G/通道电接口的3.2T模块解决方案奠定基础,从而支持204.8T交换机的发展。

博通物理层产品事业部副总裁兼总经理Vijay Janapaty表示:“博通基于400G/通道的Taurus DSP平台正在为下一代AI网络和数据中心互联奠定基础。作为业内首款基于400G/通道I/O的1.6T DSP,Taurus将每通道吞吐量提升一倍,为下一代3.2T光模块铺平道路。更重要的是,Taurus将IMDD技术推进至400G/通道,进一步降低功耗,推动AI与云网络互联成本优化解决方案的路线图发展。”

8.Gemini 牵手五角大楼,美国国防部超 300 万人用上谷歌 AI 智能体

据IT之家报道,3月11日,据彭博社报道,谷歌宣布向美国国防部超过 300 万名文职与军职人员部署 Gemini AI 智能体。美国国防部负责研究与工程事务的副部长埃米尔 · 迈克尔表示,谷歌提供的工具初期仅用于非机密网络,将其扩展到机密和最高机密系统的计划尚待讨论。

首批上线的八个 AI 智能体主要用于自动处理行政事务,支持整理会议纪要、编制预算以及审查行动计划是否符合美国的国家防务战略。谷歌副总裁吉姆 · 凯利周二在博客中表示,美国国防部工作人员还可以通过自然语言自行创建定制 AI 智能体。

自去年 12 月以来,五角大楼约 120 万名员工已通过 GenAI.mil 门户提供的谷歌 AI 聊天机器人完成非机密任务。期间,工作人员提交了约 4000 万条不同提示,并上传了超过 400 万份文件。

不过,培训进度明显落后于实际使用情况。自 12 月以来,仅有 26000 人完成 AI 培训课程。展望未来,培训场次已经全部约满,越来越多员工正在加入 AI 工具的使用行列。

与此同时,美国国防部也在迅速扩大与 AI 公司的合作。此前美国国防部与 Anthropic 发生冲突,因为 Anthropic 拒绝移除其技术中针对国内监控和自主武器的安全限制。随后美国国防部将 Anthropic 列为“供应链风险”,而 Anthropic 则表示将通过诉讼挑战这一决定。

这一事件还引发科技公司内部争议。约 900 名谷歌员工和 100 名 OpenAI 员工签署公开信,呼吁公司坚持保留这些安全限制。谷歌也在 2 月初悄悄修改了涉及这些用途的“AI 原则”。

在与 Anthropic 关系紧张之后,美国国防部已经分别与 OpenAI 和 xAI 达成合作,将 AI 技术部署到受限网络中。

据IT之家了解,谷歌与五角大楼的合作曾在 2018 年引发公司内部强烈反弹。当时数千名员工抗议“Project Maven”项目,该项目利用 AI 分析无人机视频画面。谷歌最终没有续签这一合同,近年来却逐渐放松了对军事项目合作的限制。

9. 英伟达最强开源权重 AI 模型:Nemotron 3 Super 登场,120B 参数、吞吐量飙升 5 倍

据IT之家报道,3月12日,英伟达公司昨日发布博文,宣布推出 Nemotron 3 Super 开源大模型,是其迄今为止最强大的开源权重 AI 模型。

IT之家注:开源权重模型(Open-weight AI models)是指将决定 AI 模型行为的关键参数(权重)向公众免费开放的模型。与完全闭源的模型(如 GPT-4)不同,开发者可以下载并在自己的设备上运行或微调这些模型。

Nemotron 3 Super 模型拥有 1200 亿参数,采用混合专家(MoE)架构(推理时仅激活 120 亿),专为大规模运行复杂智能体(Agentic AI)系统设计。

该模型结合了先进的推理能力,能够为自主智能体高精度地完成任务。Perplexity、Palantir 和西门子等行业巨头目前已将其应用于搜索、软件开发、电信和半导体设计等核心工作流中。

随着企业将 AI 应用从聊天机器人转向多智能体,往往面临两大瓶颈:“上下文爆炸”与“推理税”。多智能体交互会产生最多 15 倍的 Token 量,导致成本飙升和目标偏移;同时,复杂智能体每步都需要推理,让系统变得昂贵且迟钝。

Nemotron 3 Super 为解决这些问题,配备了 100 万 Token 的上下文窗口。这让智能体能够将完整的工作流状态保留在内存中,从而防止目标偏移,并大幅降低多步推理的成本。

在架构与性能方面,该模型采用了混合专家(MoE)架构,将吞吐量提升了 5 倍,准确率比前代翻倍。具体而言,其 Mamba 层使内存和计算效率提高了 4 倍,而 Transformer 层则负责高级推理。

此外,模型引入了“潜在 MoE(Latent MoE)”新技术,以单个专家的计算成本激活四个专家;并支持多 Token 预测,让推理速度提升 3 倍。在英伟达 Blackwell 平台上,该模型以 NVFP4 精度运行,相比 Hopper 架构上的 FP8,内存需求更低且推理速度快 4 倍。

英伟达对该模型采取了高度开放的策略。官方不仅遵循宽松许可证开源了模型权重,还公布了完整的训练方法,包括超 10 万亿 Token 的数据集和评估配方。在实际场景中,它能一次性加载完整代码库进行端到端调试,或瞬间读取数千页财务报告。

开发者目前可通过 Hugging Face、各大云服务商(谷歌云、甲骨文,及即将上线的 AWS 和 Azure)获取该模型。同时,它已被打包为 NVIDIA NIM 微服务,支持无缝部署制本地数据中心和云端。

10.Meta 计划 2027 年底前部署四代自研 AI 芯片,应对算力需求并降低外部依赖

据IT之家报道,3月12日,当地时间周三,Meta 正式公布了这几款新芯片的规划 ——MTIA 300、MTIA 400、MTIA 450 与 MTIA 500。此举旨在实现硬件供应多元化、降低对外部芯片厂商的依赖,并在竞争激烈、成本高昂的人工智能竞赛中控制开支。Meta 同时也会继续从其他公司采购芯片,近期已宣布与英伟达、AMD 达成协议,斥资数十亿美元购买人工智能硬件。

Meta 表示,MTIA 300 已投入量产,用于内容排序与推荐模型训练;MTIA 400(代号艾瑞斯 / Iris)已完成实验室测试,即将部署。MTIA 450 与 MTIA 500 芯片(代号分别为阿尔克 / Arke 和阿斯特丽德 / Astrid)计划于 2027 年大规模部署。

Meta 工程副总裁宋义俊(Yee Jiun Song)称,这些产品正同步研发,MTIA 450 预计 2027 年初推出,MTIA 500 则在半年后上市。

“回顾整个人工智能领域的发展,即便在过去两三个月里,行业发展速度也快到超乎所有人想象。”宋义俊表示,“芯片研发必须跟上算力需求的迭代,因此我们会持续审视技术路线图,确保打造出最具实用价值的产品。”

Meta 正大举投入研发具备竞争力的人工智能模型与产品,这带来了前所未有的算力需求。公司一方面依靠英伟达与 AMD 支撑部分人工智能项目,另一方面也在扩充芯片设计人才团队,力求自研相关产品。

去年,因首席执行官马克 · 扎克伯格对公司自研进度失去耐心,Meta 曾试图收购韩国芯片初创公司 FuriosaAI。在对方拒绝 8 亿美元(IT之家注:现汇率约合 55.01 亿元人民币)收购要约后,Meta 转而收购了总部位于美国加州圣克拉拉的初创公司 Rivos Inc.,并将其 400 多名员工纳入麾下。

新增人员助力 Meta 自研芯片团队(即 Meta 训练与推理加速器团队,MTIA)同时推进多个项目。MTIA 专注于为公司内部需求打造更高效的计算架构,应用场景从决定 Instagram 信息流内容的排序与推荐系统,到大规模生成式人工智能推理(即通过训练好的模型根据指令生成文本或图像)。

尽管 Meta 高管一再强调自研芯片的优势,但该公司同时也是全球最大的图形处理器(GPU)采购方之一,GPU 主要用于训练和运行人工智能模型。Meta 近期与英伟达、AMD 分别签署了价值数百亿美元的协议,确保未来数年锁定海量人工智能算力。

这一战略体现了 Meta 的双轨思路:一方面从行业合作伙伴采购传统硬件,另一方面持续投入定制化芯片,用于适配 Meta 平台的专属任务。

“我们并非面向通用市场研发,因此芯片不需要具备全场景通用性。”宋义俊称,“我们可以去掉非必需功能,从而有效降低成本。”

不过,芯片制造的成本与难度依然巨大。一款产品从设计到交由第三方厂商(通常是台积电)生产,往往需要耗费数十亿美元与大量时间。宋义俊表示,其团队通常需要两年时间完成从设计到量产的全过程。定制芯片通常只有在大规模使用、高利用率的情况下才能实现盈利。

上月,The Information 报道称,Meta 因设计困难,已取消代号为“奥林匹斯”(Olympus)的最高端人工智能训练芯片项目,转而研发复杂度更低的版本。Meta 发言人拒绝对此报道置评,但表示公司会定期评估并更新芯片路线图,并从产品部署中积累经验。

Meta 首席财务官苏珊 · 李(Susan Li)本月早些时候在摩根士丹利举办的一场会议上表示,公司仍致力于研发可用于训练人工智能模型的处理器。

11.3.2 Tb/s 巅峰速度!英伟达、AMD 等科技六巨头联手定义未来 AI 光互连

据IT之家报道,AMD、博通(Broadcom)与英伟达(Nvidia)三大芯片巨头,联手微软、Meta 及 OpenAI 云计算和 AI 巨头,成立了光计算互连(OCI)多源协议(MSA)小组。

IT之家援引博文介绍,科技界六大巨头组建的 OCI MSA 小组,核心任务是开发一种通用的光物理层(PHY)及统一组件,用光缆取代传统的铜缆。这种转变不仅能显著提升带宽,还能提供更可预测的功耗表现。

根据规划,该标准将支持 AI 系统内部和机架间的纵向扩展连接,数据传输速度最终将飙升至 3.2 Tb/s。对于微软和 Meta 这种运营着庞大数据中心的超大规模服务商而言,这意味着他们可以在不牺牲性能的前提下,连接更多加速器,构建更强大的算力池。

与以往排他性的技术标准不同,OCI 规范采用了“协议无关”的设计理念,能够同时支持英伟达的 NVLink 以及 AMD、博通主导的 UALink 协议,意味着不同的处理器和互连协议可以在同一套光纤基础设施和交换机上运行。

值得关注的是,OCI MSA 与传统的行业标准组织(如 JEDEC)存在显著差异。首先,它由微软、Meta 等“用户端”而非单纯的“供应商”主导,更贴合实际应用场景。

其次,它采用了多源协议(MSA)模式,跳过了传统标准组织繁杂的共识流程,目的是快速达成电气和光接口的一致性。

12. 风险提示

AI发展不及预期,算力需求不及预期,市场竞争风险,测算假设的误差风险

VIP复盘网

VIP复盘网