当你的核心算法模型和客户数据,在AI服务器里‘裸奔’,你敢把所有业务都交给AI吗?”

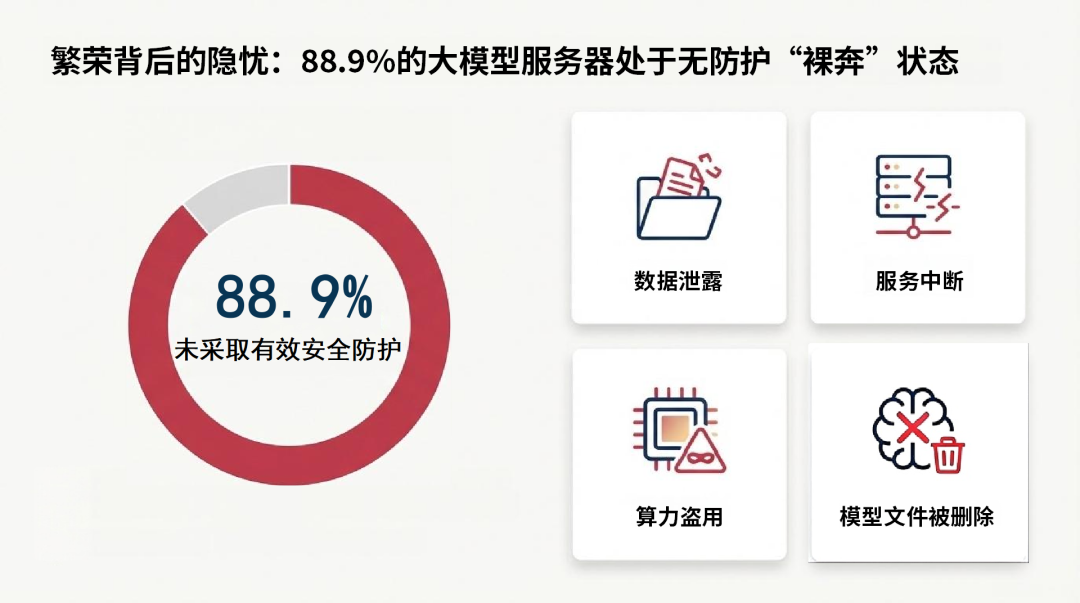

当前,以大模型为核心的AI浪潮正深刻重塑千行百业,DeepSeek、通义千问等国产大模型正加速普及,推动AI技术深入企业的核心业务场景。然而,伴随技术红利而来的是日益严峻且复杂的安全挑战。根据公开数据显示,近90%的私有化部署大模型服务器处于“裸奔”状态,无异于将核心数字资产暴露于公共网络之中。

对大模型厂商与私有模型开发者而言,模型权重等知识产权面临被窃取的风险。从Meta公司的LLaMA模型权重在一周内遭全网泄露被迫转向开源,到国内首例AI模型参数侵权案(某音诉某科,判赔320万元)——这些案例均表明,一旦模型被非法复制、微调乃至投入商用,模型开发者倾注巨资和时间构建的技术壁垒与市场优势可能顷刻瓦解。

对大模型用户来说,敏感数据泄露事件屡见不鲜。无论是近期国家安全部门披露的某单位内部文件因违规使用开源AI工具而被境外窃取,还是某三甲医院因病历数据违规上传至开源AI医学影像分析工具而遭受高额处罚,都暴露出企业在AI应用过程中安全意识与防护措施的薄弱。

这些事实警示我们:大模型在驱动效率革命的同时,也正成为数据泄露与知识产权侵权的“风险重灾区”。传统的网络安全防护已难以应对模型窃取、数据逆向、越权访问等新型威胁。

在此背景下,格尔软件推出“AI大模型安全保险箱”,专为AI核心资产打造的原生安全基础设施。它通过深度融合操作系统内核级防护技术与现代密码学算法,为大模型运行所需的“权重资产、训练数据、知识库、用户交互数据”提供从存储、访问到使用的全生命周期安全保障。它是一套能够无缝嵌入异构算力环境、实现“业务零改造”的内生安全基座。

设计理念:三位一体的安全闭环

格尔软件凭借多年密码技术实践积淀,结合大模型应用架构的深度研究,在大模型安全保险箱产品设计中通过“加密、权控、可信”三大核心技术机制,为AI核心资产构建了“防窃取、防越权、防篡改”的闭环防护体系。

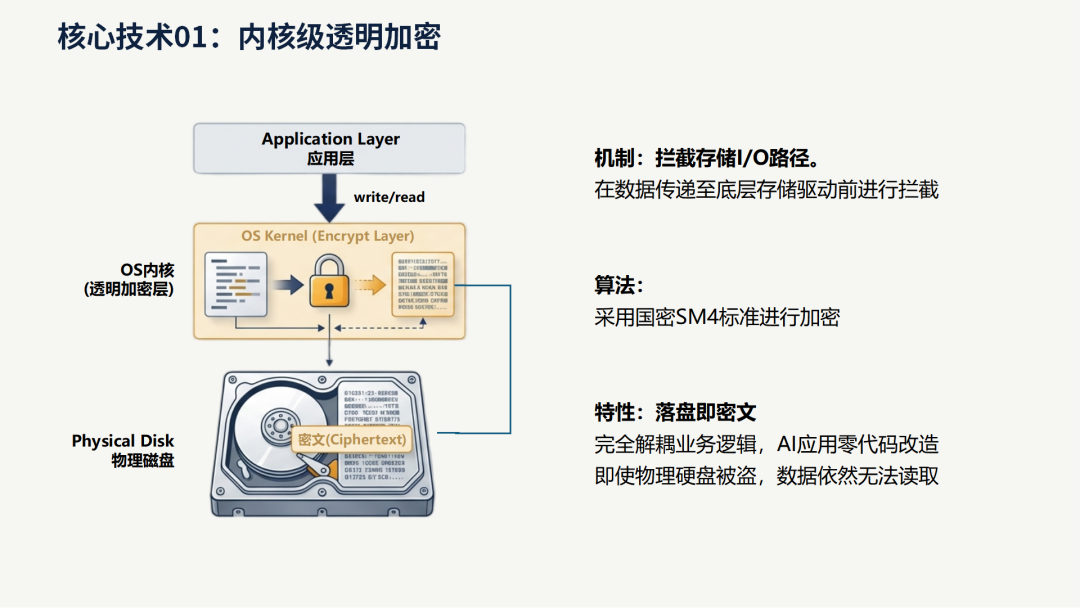

加密为盾:聚焦内核级透明加密,保障数据存储安全

AI核心资产,包括模型文件、训练数据、用户交互记录均可在存储时依据策略自动实时加密,读取时自动解密,对上层应用完全无感。即使存储介质被窃取,攻击者也无法解析密文,杜绝模型与数据的物理级泄露。

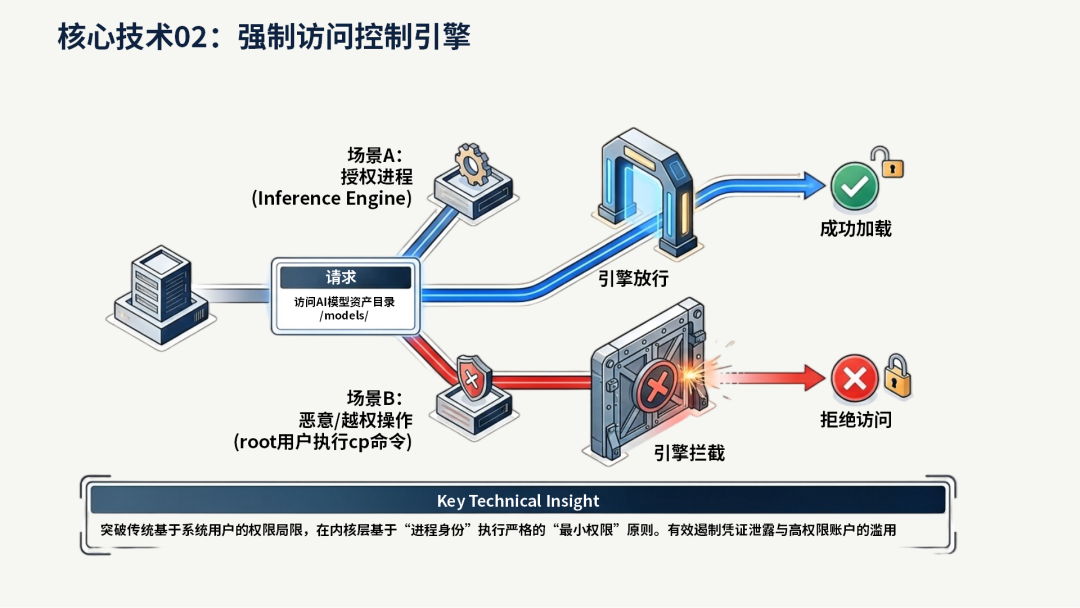

在传统的DAC(自主访问控制)模型中,Root就是上帝,我们引入了内核级MAC引擎。当我们在策略中定义了“非授权程序禁止读取模型目录”时,即使Root用户在终端执行cp /models/weight.bin /tmp/,内核会因发起进程的特征不在白名单内,直接回绝该操作。格尔AI大模型安全保险箱将模型资产的访问权限与操作系统的Root权限解耦。即使攻击者或内部人员获取了Root权限,也无法读写受保护的明文数据,从根本上防御了提权攻击和内部越权风险。

我们可以依据预设策略,为静态的AI核心资产(如模型文件、知识库)生成数字签名。在模型文件加载与知识库检索前自动验证签名有效性。任何非法篡改(如模型投毒、知识库污染)均会导致验证失败并被实时拦截,从而保障AI决策依赖的数据源头纯净、未被篡改。签名信息同时可作为知识产权溯源与审计的法定电子凭证。

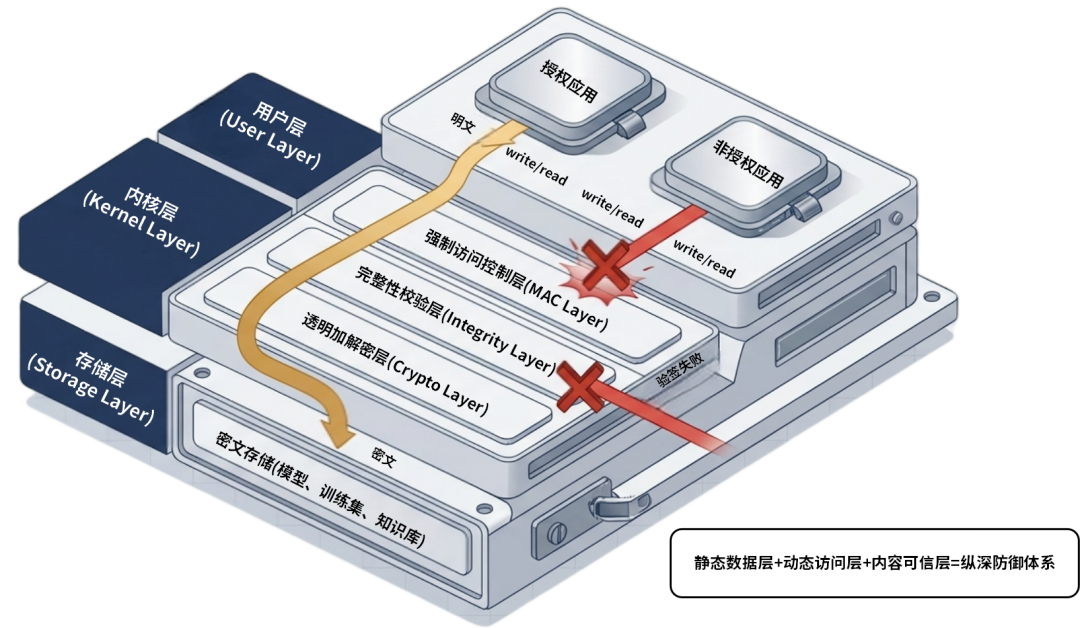

构建安全闭环

透明加密、强制访问控制与完整性校验三大能力并非孤立运行,而是在客户端的统一调度下,于AI资产的生命周期中构建了安全防线:

静态数据层:确保数据在任何存储介质中均为密文,解决了资产静止时的物理窃取风险。

动态访问层:在操作系统内核层强制执行最小权限,解决了访问时的越权与滥用风险。

内容可信层:通过实时或定期的校验,解决了数据使用时的篡改与污染风险。

这三层防御逐级递进、互为补充,即使某一层防护出现意外情况,后续层级仍能提供保护,构成纵深防御体系。同时,所有操作均被审计日志记录,形成可追溯的安全闭环,满足合规与事中事后分析追溯需求。

管理控制台:AI资产安全的指挥中枢

为应对企业AI资产分散、策略复杂、运维困难的挑战,格尔AI大模型安全保险箱配备了集中化的 “安全大脑”——管理控制台。它作为全局安全的指挥中枢,通过策略统一下发、密钥集中管控与运行状态全景可视,实现对分布式AI资产安全的体系化治理。

管理员可在控制台中,为不同AI资产、不同安全等级的AI应用,灵活配置数据加密策略、访问控制策略和数字签名策略,实现“一次配置,自动同步至所有目标服务器”。这彻底改变了以往需要逐台登录、手工配置的低效模式,极大提升了安全管理的敏捷性与一致性,确保安全基线全面覆盖。

所有加密操作依赖的密钥,由独立的密钥管理服务集中生成、存储与生命周期管理。密钥本身被高强度加密保护,支持与硬件安全模块(HSM)或国密硬件集成,实现密钥的硬件级保护,确保加密体系的根基牢不可破。

策略一经下发,即可通过客户端组件在各AI服务器上自动执行。控制台提供全景式监控仪表盘,实时呈现所有受保护AI服务器的安全策略合规状态、实时访问审计日志与威胁告警事件。任何异常访问、策略违规或签名校验失败行为均可被实时感知与记录,支持事中拦截与事后追溯。所有日志可对接至企业现有SOC/SIEM平台,使AI资产安全态势融入企业整体安全运营,实现真正的纵深防御与主动管理。

大模型厂商与开发者模型资产防窃取保护

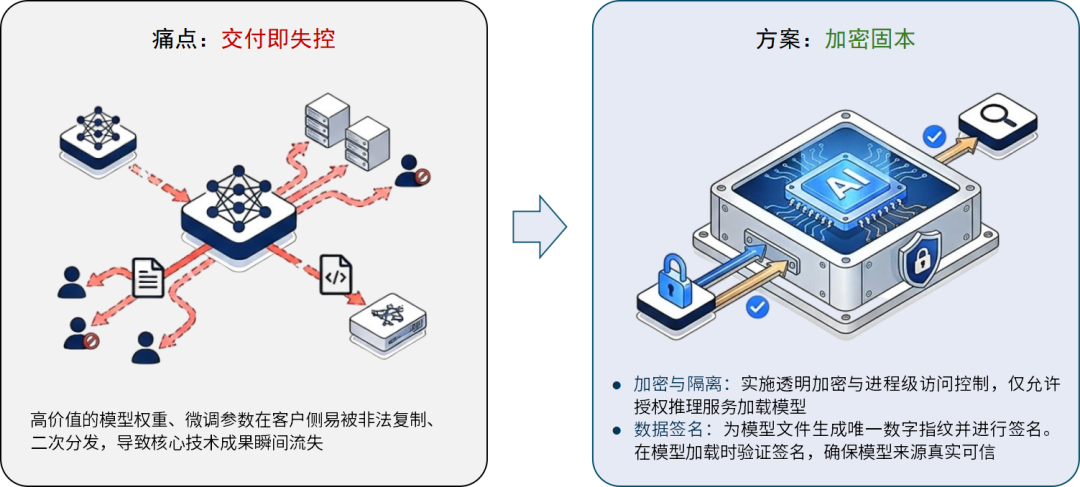

挑战:模型交付即失控

模型交付至客户环境后即面临失控风险,核心权重与算法可能被非法复制、二次分发或用于商业竞争,导致知识产权流失与商业利益受损;同时,交付后的模型也存在被恶意篡改的风险,可能导致模型行为异常,引发难以预料的输出错误与安全事件。

解决方案

在大模型或大模型应用产品出厂前,将大模型安全保险箱作为核心安全模块内嵌到大模型产品或解决方案中:

1. 对模型权重、配置文件等核心知识产权资产,实施文件存储级透明加密,确保数据落盘即密文。

2. 在操作系统内核层实施进程级强制访问控制,确保仅限大模型厂商或模型开发者授权的模型管理、推理服务等合法进程才能加载和解密模型,从根源上阻断任何非授权访问与拷贝。

3. 为模型文件生成唯一数字指纹并进行数字签名。在每次模型加载时均验证签名,确保模型完整、真实、未被篡改,守护AI服务的运行确定性。

方案价值

筑牢技术壁垒:从技术层面实现模型闭源,防止核心知识产权在交付后环节流失,维护商业壁垒。

保障模型运行安全:防止模型在客户侧被恶意替换或投毒,确保模型行为的确定性与安全性。

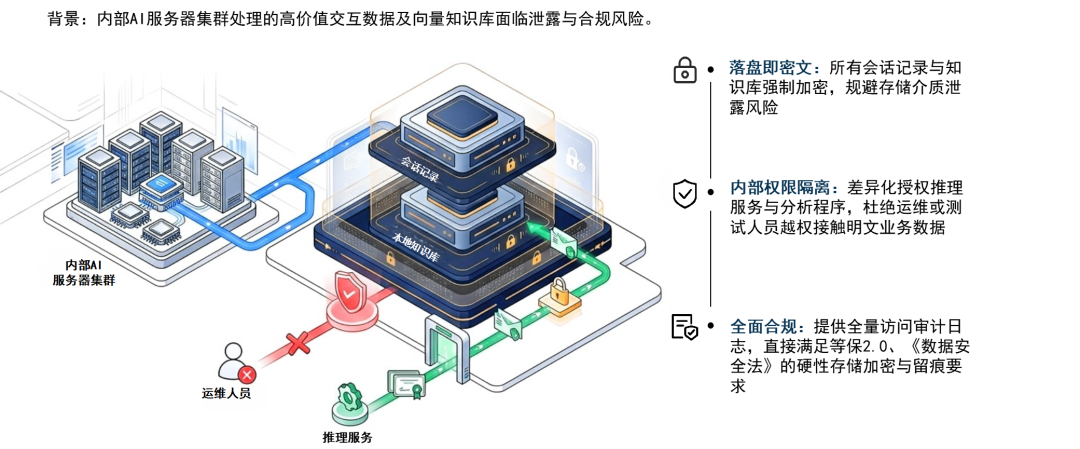

挑战:敏感信息泄露

企业及政府机构使用大模型时,对话记录、知识库等数据存储在数据库或文件中,一旦因内部越权、外部攻击或配置疏漏而泄露,将导致严重的数据安全事件。

解决方案

1. 敏感数据加密:对存储的数据进行自动透明加密,确保即使存储介质丢失,数据也无法被识别。

2. 强制访问控制:在系统内核层实施精细权限控制,确保只有授权进程能访问敏感数据。

3. 数字签名与完整性校验:为知识库等文件进行数字签名,在使用时验证其完整性与真实性,防止篡改。

方案价值

满足核心合规要求:直接满足数据安全法律法规对敏感信息加密存储、最小权限管理和操作留痕的硬性规定,规避监管处罚风险。

封堵内部泄露风险:通过进程级权限管控,有效防止运维、测试或其他非授权人员接触和泄露明文业务数据。

降低安全改造成本:以零代码改造的方式,快速为现有AI业务叠加数据安全能力,节省高昂的定制开发费用与时间成本。

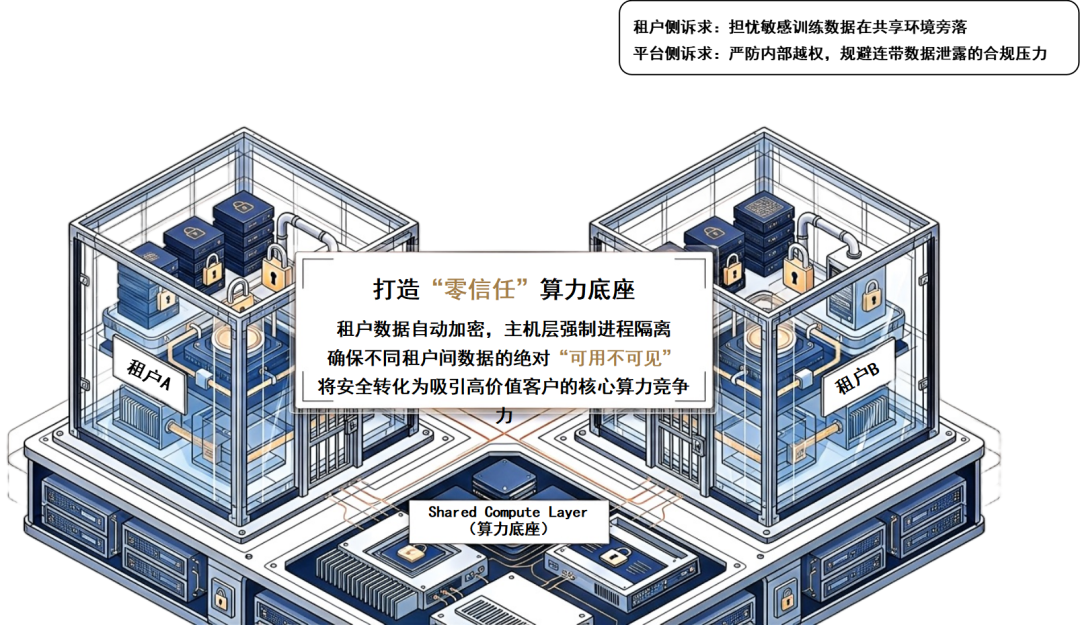

挑战:模型训练数据泄露

模型算力平台需平衡租户安全诉求与自身运营风险。租户担忧其托管的模型与敏感数据在共享环境中的数据主权旁落,存在被平台内部或其他租户不当访问的风险;平台方则需严防内部运维越权,抵御外部攻击导致的数据泄露,并应对由此引发的严峻合规与审计压力。

解决方案

将大模型安全保险箱作为算力平台的安全能力部署,为每个租户的数据资产构建“可用不可见”的防护层。

对租户的模型、训练数据自动加密,确保所有敏感数据落盘即密文。

在承载训练、推理任务的主机上,实施强制访问控制,确保只有授权的租户业务进程可访问解密后的数据,阻断非授权访问。

对模型文件等关键资产进行数字签名,防止被恶意篡改或植入后门。

完整记录数据的所有访问日志,并生成符合法规要求的审计报告,满足合规审查与事件溯源需求。

方案价值

企业租户:模型与数据在平台侧始终处于加密和受控状态,打消托管顾虑。

平台方:打造“零信任”安全底座,将其转化为吸引金融、政务等高安全需求客户的核心竞争力;同时,满足监管对云服务商的数据安全责任要求,有效规避连带风险。

产品五大优势

无需修改任何训练、推理或知识库服务代码,也无需调整现有业务流程。产品在操作系统内核层实现透明加解密,部署后立即生效,对应用与用户完全无感,真正做到开箱即用、零侵入集成。

在操作系统内核层实施强制访问控制,依据策略只允许可信进程(如指定推理引擎)访问特定模型目录。即使拥有系统root权限,也无法违规复制或提走受加密保护的模型文件,从底层杜绝越权访问与内部窃取。

加解密运算由硬件密码设备高效承载,对GPU的训练与推理算力实现零占用,保障AI任务全性能运行。实测显示,采用文件级加密防护系统性能损耗低于5%,在实现高强度安全的同时,保障业务高效稳定运行。

采用“根密钥-保护密钥-文件密钥”三层密钥架构,结合硬件安全模块(HSM)保护核心根密钥。即使服务器被完全攻破,攻击者也无法获取根密钥,从根本上降低数据被解密的一切可能,实现“攻破服务器也拿不到数据明文”的高级别防护。

采用国密算法,集成高强度访问控制与全链路审计,全面覆盖等保2.0、《数据安全法》、《个人信息保护法》及密评等核心合规要求。帮助客户将安全合规从被动成本转化为主动价值,有效规避法律与监管风险。

让安全成为AI生产力进化的第一块基石

当AI成为核心生产力,其资产——模型与数据——的安全便不再是“可选项”,而是决定企业AI战略成败的“关键基石”。传统的外挂式、边界式防护已然失效,我们需要的是一场从理念到技术的范式革命。格尔AI大模型安全保险箱,正是这一范式革命的产物,是对AI原生安全范式的重新定义。我们坚信,安全不应成为AI创新的掣肘,而应通过内核化的透明机制、不可僭越的强制权控以及数学化的可信基准,为AI资产构建一个如影随形、坚不可摧的“原生护盾”。在充满不确定性的未来,格尔软件将继续深耕AI基础设施安全,助力每一家企业在数字智能化的浪潮中,安心释放AI的无限潜能,构筑起资产安全的最强基座。

VIP复盘网

VIP复盘网