SRAM可提升AI推理速度。在大模型应用中,相比依赖外置HBM,SRAM可显著降低权重与激活数据的访延迟与抖动,从而改善Time-to-First-Token与尾时延表现。

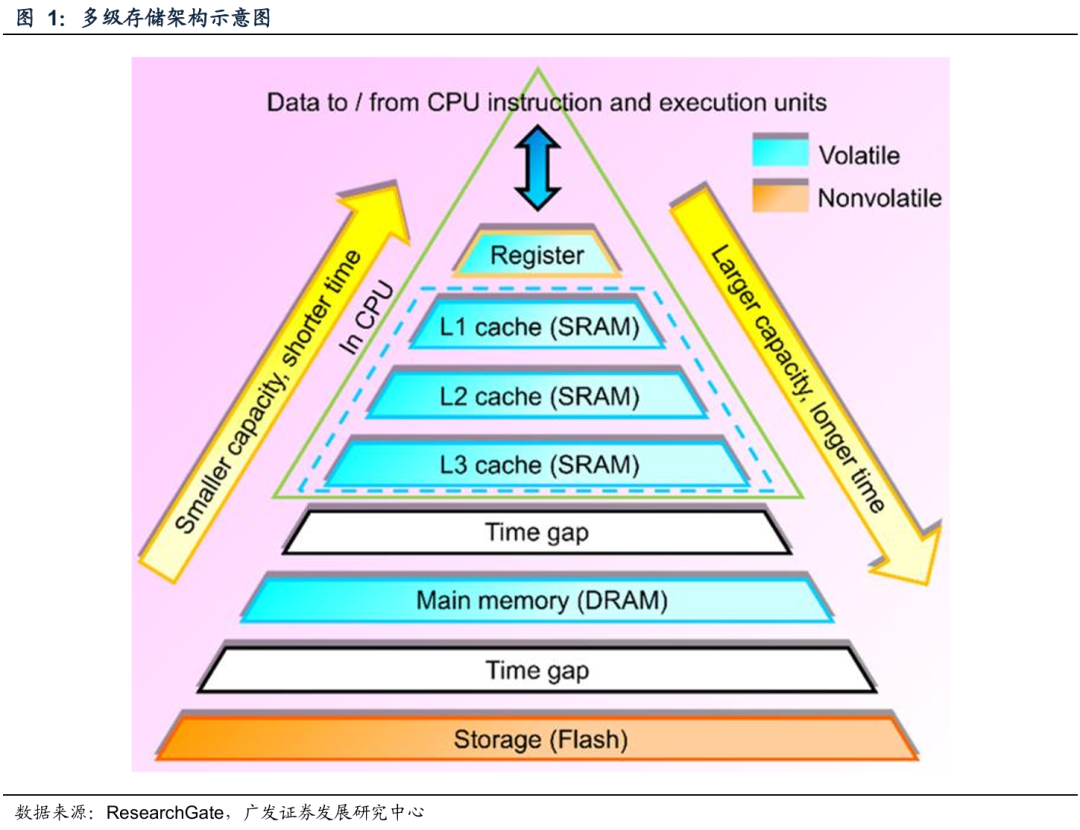

SRAM是片上高带宽存储层。存储分级为SRAM、HBM、DRAM和SSD,其中SRAM(静态随机存取存储器)集成在CPU、GPU计算核心附近的片上存储,具备纳秒级访问时延与高度确定性的带宽特性,带宽高但容量小、成本高。

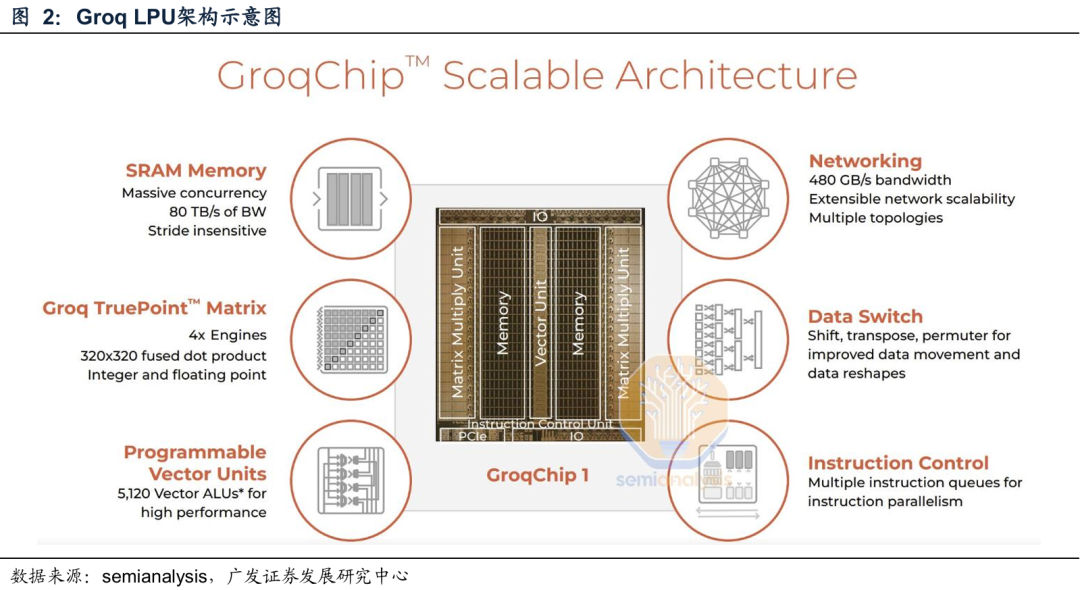

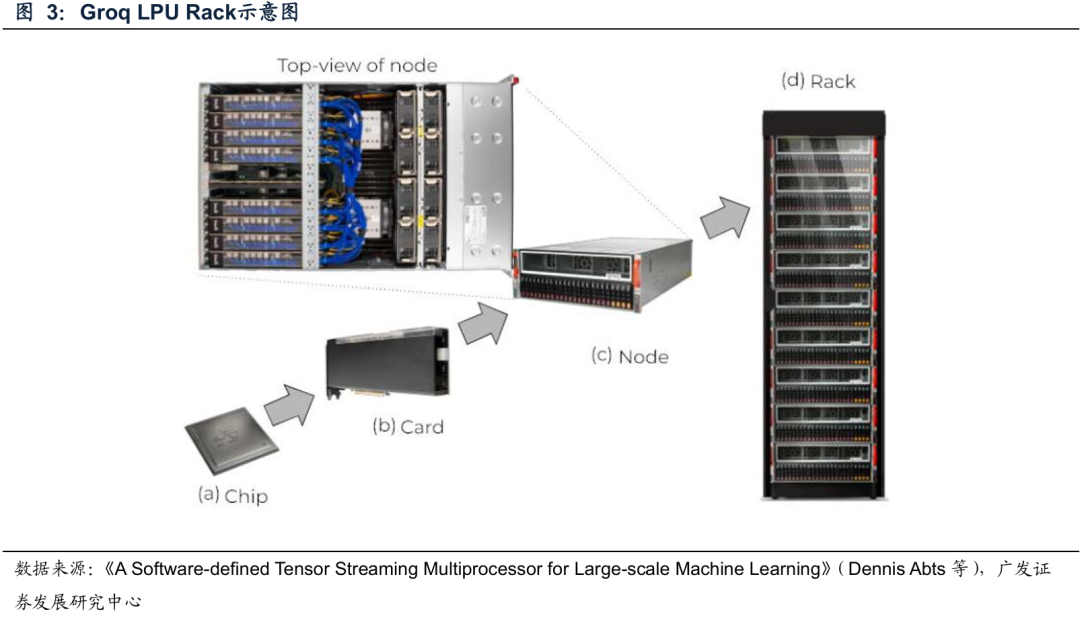

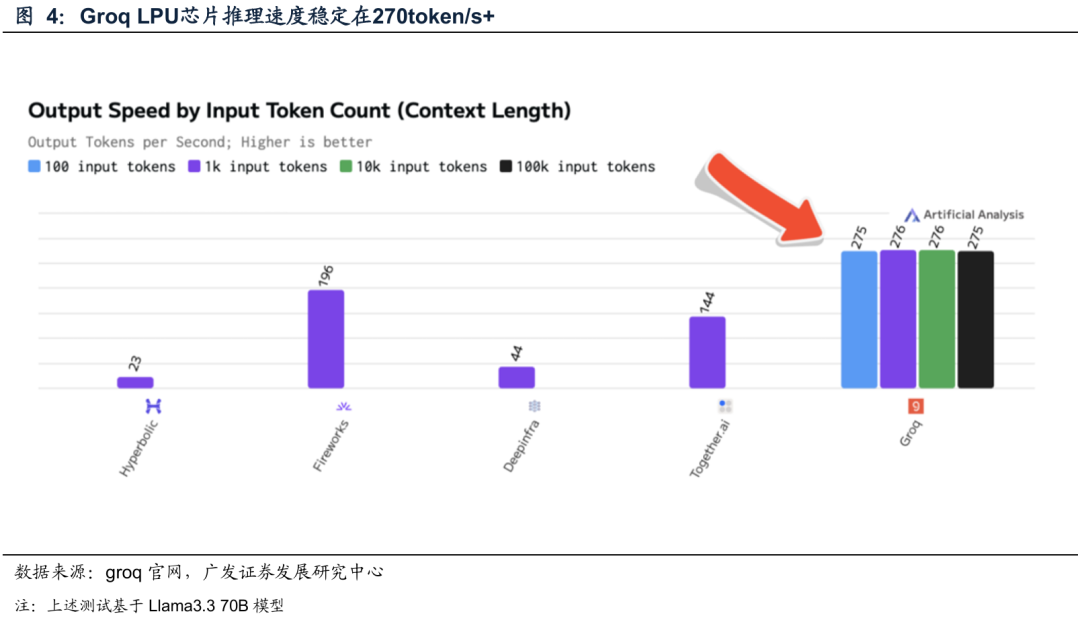

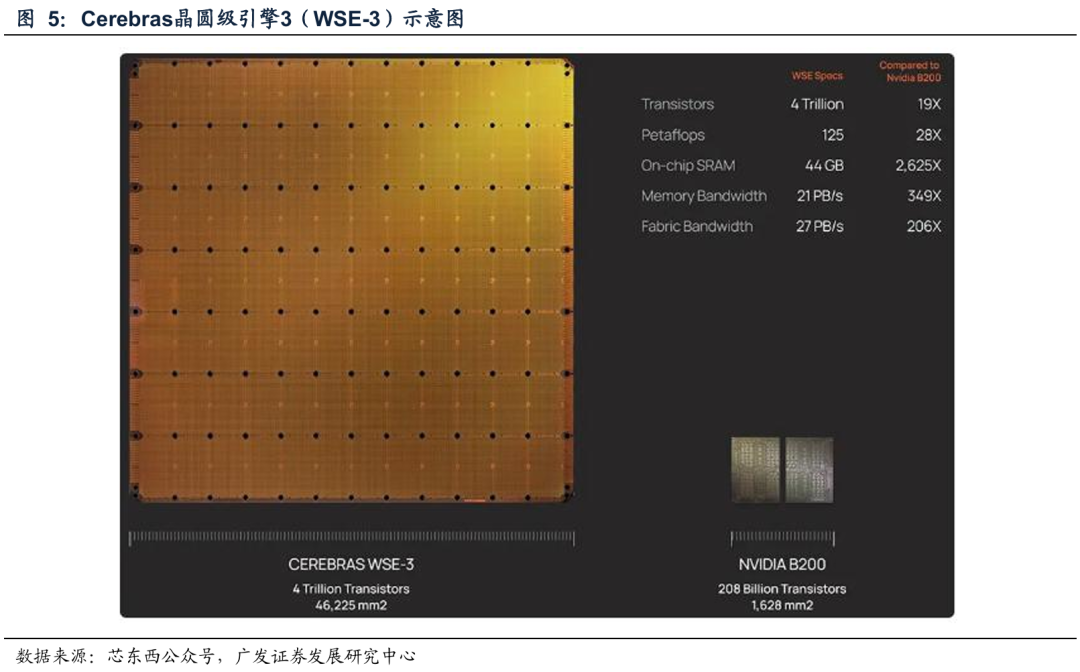

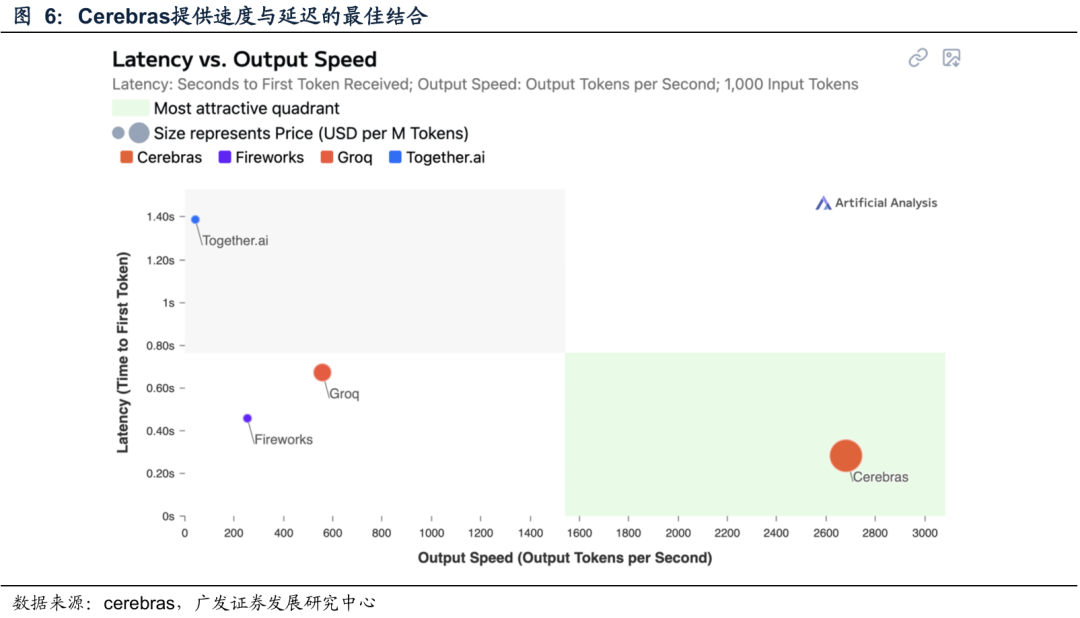

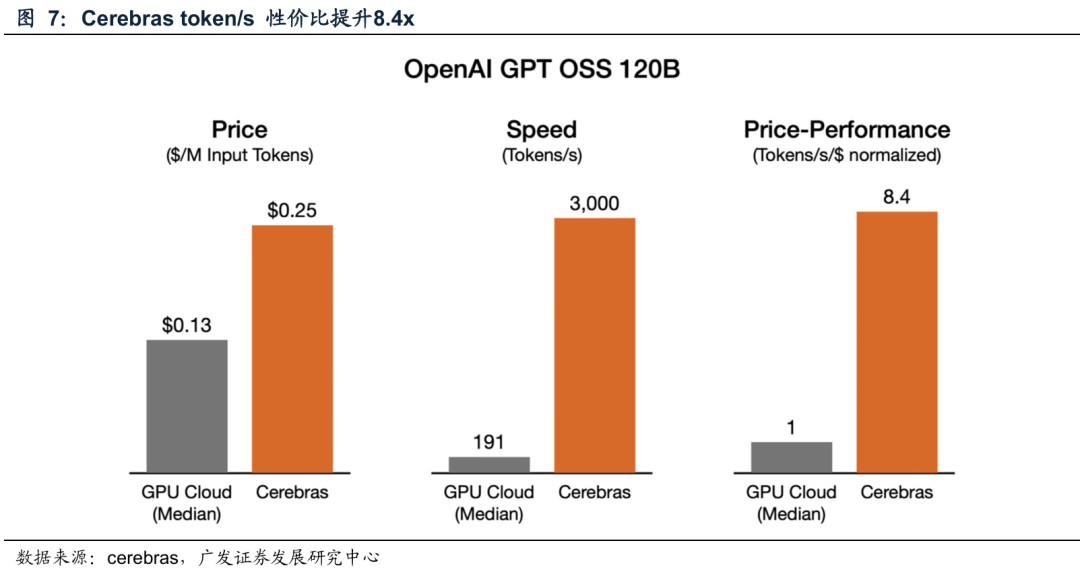

SRAM可提升AI推理速度。在大模型应用中,相比依赖外置HBM,SRAM可显著降低权重与激活数据的访延迟与抖动,从而改善Time-to-First-Token与尾时延表现。Groq和Cerebras两家创业公司都推出了基于SRAM的AI芯片。根据Groq官网,其LPU单芯片内集成约230MB片上SRAM,存储带宽高达80 TB/s(GPU片外HBM的内存带宽约为8 TB/s)。以Llama3.3 70B模型为例,根据Artificial Analysis的独立基准测试,Groq LPU芯片在不同上下文长度下均能维持稳定推理速度,达275-276token/s,显著优于其他推理平台。根据Cerebras官网,其晶圆级引擎3(WSE-3)芯片集成44GB SRAM,片上存储带宽达21 PB/s,在OpenAI GPT OSS 120B推理任务中实现>3000 tokens/s的输出速度,较主流GPU云推理快约15×。此外,2026年2月,OpenAI推出首个运行在Cerebras Systems AI加速器上的模型GPT-5.3-Codex-Spark预览版,支持>1000 tokens/s的代码生成响应速度,为用户提供更具交互性的编程体验。

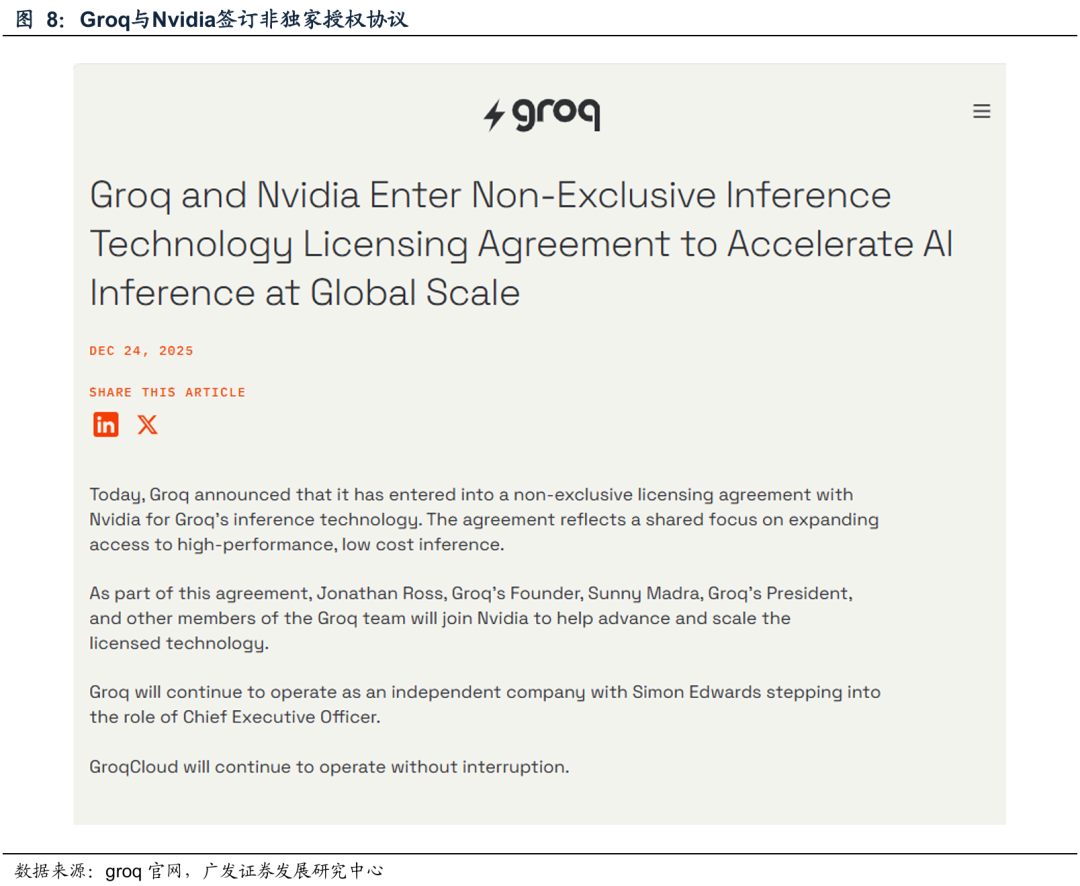

SRAM架构进入主流视野。根据Groq官网、半导体行业观察公众号数据,2025年12月,英伟达斥资200亿美元获得Groq的知识产权的非独家授权,其中包括其语言处理单元(LPU)和配套软件库,并引入Groq核心工程团队。根据Openai官网、芯东西公众号数据,2026年2月,Cerebras宣布完成10亿美元F轮融资,此外,OpenAI与Cerebras签署100亿美元合同,部署多达750兆瓦的定制AI芯片。

投资建议。AI的Memory时刻,AI记忆持续扩展模型能力边界,AI Agent等应用加速落地。AI记忆相关上游基础设施价值量、重要性将不断提升。建议关注产业链核心受益标的。

风险提示

AI产业发展以及需求不及预期;AI服务器出货量不及预期,国产厂商技术和产品进展不及预期。

一、SRAM是片上高带宽存储层

二、SRAM可提升AI推理速度

三、SRAM架构进入主流视野

四、投资建议

AI的Memory时刻,AI记忆持续扩展模型能力边界,AI Agent等应用加速落地。AI记忆相关上游基础设施价值量、重要性将不断提升。建议关注产业链核心受益标的。

风险提示

(一)AI产业发展以及需求不及预期

若AI相关模型和应用发展或下游需求发展不如预期,使得产业发展不如预期,进而影响AI服务器需求。

(二)AI服务器出货量不及预期

AI服务器出货量一方面受到企业IT支出,尤其是云计算厂商的Capex支出影响,因此若企业对算力设施的投入不及预期,可能影响AI服务器的出货量;另一方面AI服务器价值量占比较高的GPU和CPU若出现供应紧张等问题,也会对AI服务器的出货量级和节奏造成一定消极影响。

(三)国产厂商技术和产品进展不及预期

目前国内厂商不断开发模型以及相关应用,若在算力、数据、算法等某一因素上支撑不及预期,则可能导致国内厂商技术和产品进展不及预期。

VIP复盘网

VIP复盘网