摘要

■ 投资逻辑

行业观点

从央视春晚Bot火热看人形机器人四大潜在商业化场景。马年央视春晚“含Bot”量再度提升,松延动力、宇树科技、魔法原子、银河通用&Sharpa为全国人民贡献了四台兼顾科技属性与人文关怀的精彩节目,也展示出人形机器人产业面向商业化落地的最新尝试。以星海图前首席科学家许华哲博士的思考为蓝本,我们认为人形机器人所面向的工作环境必然是“高价值量 低重复性”的场景,上述场景又会在ToB/C客群差异、大脑/小脑层面泛化性要求的区分下形成四类买单方画像清晰且现阶段具身智能足以胜任的商业化场景——1)ToB 大脑泛化:导览、导购、导巡场景,比如小鹏Iron机器人的展厅导览、汽车门店导购、公司前台导流与巡逻场景,底层能力是流利流畅的语言智能沟通 亲切的人形姿态。2)ToB 小脑泛化:特种行业场景,比如央视春晚《武Bot》节目中宇树科技在高动态集群控制下,实现16台机器人毫秒级协同响应的醉拳、后空翻、双节棍、跳马、队列穿插变阵等高难度动作的能力,底层能力是类人的运动控制 蜂群协同作战。3)ToC 大脑泛化:个人陪伴场景,比如央视春晚《奶奶的最爱》节目中,松延动力机器人展示出的情绪价值拉满的唠嗑、玩梗能力,底层能力是基于语言智能的情绪价值供给,用户数据、情感投射、品牌心智形成正向飞轮。4)ToC 小脑泛化:家庭照护场景,比如央视春晚贺岁微电影中,银河通用机器人使用Sharpa的灵巧手完成盘核桃、叠衣服等任务,底层能力是触视觉协同的长程精细操作能力。

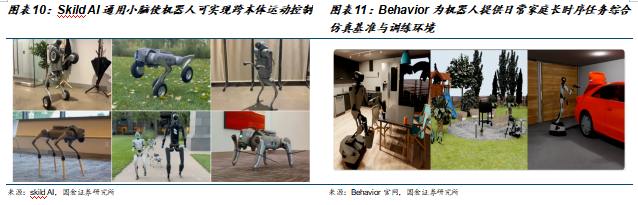

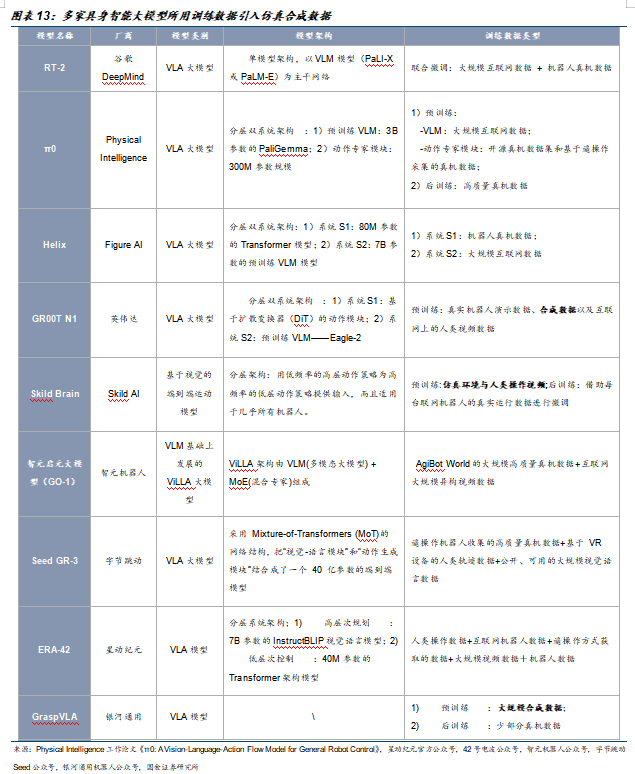

模型:具身智能泛化的曙光。泛化是机器人区别于自动化机器设备的本质区别,也是解锁上述商业化场景的钥匙。1)一段式学习系统取得阶段性突破。26年初,Figure AI发布Helix 02,新增运动直觉S0系统,能够在整个房间范围内实现“灵巧、长时程的自主行为”;同期,特斯拉选择将Optimus与无人驾驶共享一套闭环仿真世界模型,并希望将Grok大模型作为Optimus机器人集群的高级调度中枢。2)大脑侧模型的预训练已跨越ScalingLaw门槛。25年11月,北美创企Generalist AI发布GEN-0,首次验证了激活具身智能的参数门槛大约在7B。我们认为,由于Scaling路径已基本被LLM摸清,所以具身智能大脑侧的卡点更多是一个数据与工程问题而非复杂的科学问题。3)小脑侧,25年9月底北美创企Skild AI发布通用小脑,在相对于传统单一模型训练量提升500倍的情况下意外训练得到了能够跨本体实现运动控制的通用小脑能力——比如在被锯断了小腿的四足机器狗、锁定了一个电机关节只剩下三条腿的四足机器狗以及锁定了轮足的机器狗上,通用小脑均展现出快速的泛化适应能力。同期,李飞飞博士在发布ImageNet的十五年后启动首届BEHAVIOR挑战赛,开放总计1,200 小时的10,000条专家遥操作示范,细致标注物体状态、空间关系和自然语言描述。ImageNet曾推动计算机视觉进入大模型时代,我们相信BEHAVIOR也将为机器人时代设定第一个统一的Benchmark,推动大小脑协同进化。

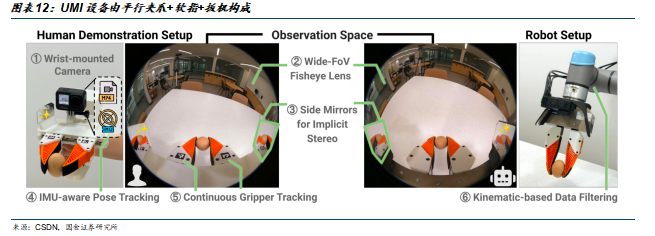

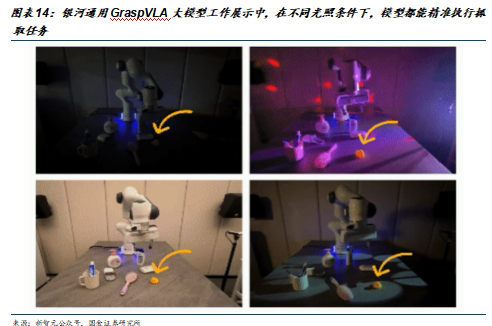

数据:三线交织,虚实融合,加速演绎。我们认为,具身训练中,真机数据是刚需,而仿真与人类视频可以提供数据扩展必要的数量级补充,以上三条路线均在过去一年中取得突破性进展。1)真机数据:UMI作为一种轻量化、无本体、低成本的真实数采方案,由3D打印的平行夹爪 软指 扳机构成,整套成本约400美金。2)仿真合成数据:英伟达Isaac&Sim与索辰开物机器人训练平台持续迭代,北美Skild AI 国内银河通用都证明足够多样性的仿真数据可以一定程度上弥补Sim2Real的gap问题。3)人类视频数据:Gemini 3.0/3.1 Pro在屏幕理解、抽象推理层面取得显著能力提升,有望加速解锁机器人理解真实世界的能力,北美Tesla与Figure都在转向人类视频数据进行模型的训练。

相关标的:智能迫近临界点有望推动人形机器人进入大规模量产前奏,建议关注人形机器人核心供应链企业,如斯菱智驱、科森科技、福赛科技、新泉股份、三花智控、恒立液压、泛亚微透、唯科科技、领益智造、蓝思科技、海康威视、大华股份等; 具身智能AI大脑和世界模型,建议关注协创数据(旗下奥佳科技Fcloud与NV合作提供Ominibot具身智能大脑训练平台)、索辰科技(中国物理AI稀缺资产)、群核科技、智微智能等。

风险提示

北美人形机器人量产节奏不及预期的风险;通用机器人Day1 L4路线缺乏商业化基础的风险;仿真合成数据质量不及预期的风险;模型及软件解决方案三方公司长期产业链话语权较低的风险。

目录

1. 引子:从央视春晚Bot火热看人形机器人商业化提速

2. 模型:具身智能泛化的曙光,一段式学习系统取得突破

2.1 端到端:Figure AI布局全身推理系统,特斯拉Optimus与无人驾驶共享一套世界模型

2.2 大脑:预训练跨越Scaling Law门槛,激活参数或为7B

2.2 小脑:跨本体通用小脑问世,Behavior牵动具身智能ImageNet时刻

3. 数据:三线交织,虚实融合,加速演绎

3.1 真实数采:刚需,UMI解锁轻量化、无本体、低成本方案

3.2 仿真合成:增广,不断逼近真实世界的性价比方案

3.3 人类视频:潜力,AI多模态能力突飞猛进

4. 风险提示

正文

1. 引子:从央视春晚Bot火热看人形机器人商业化提速

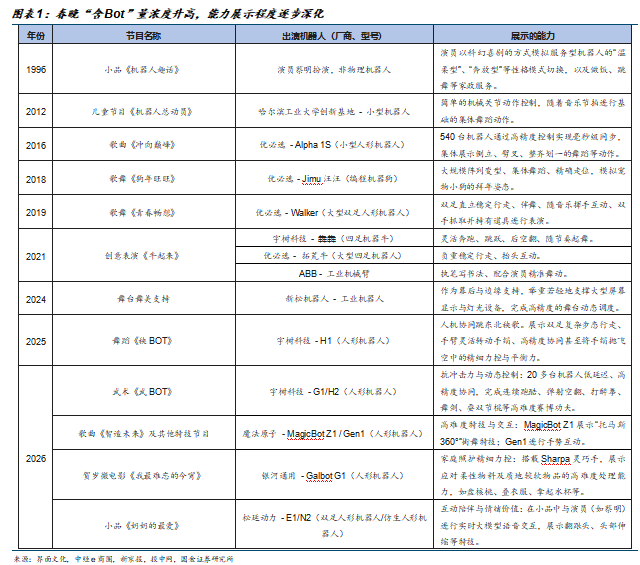

春晚作为国内前沿科技商业化落地的集中展示窗口,其历年展示的机器人形态变化反映了行业从预编程执行向具身智能迈进的发展轨迹。回顾历年春晚,从1996年科幻小品中的服务概念萌芽,到哈工大与优必选展示的小型机器人阵列,再到优必选Walker与宇树四足机器人的双足稳定行走与动态起舞,早期阶段仍以预编程序的机械同步与基础动态平衡为主,整体处于运动控制与硬件底座的打磨阶段。2025年成为关键技术拐点,宇树H1完成人机协同、手绢抛接等动作,标志着国产机器人已跨越复杂步态与基础精细力控门槛。2026年实机展示进一步体现出多场景商业化能力跃迁:宇树G1/H2集群与魔法原子产品集中验证了低延迟协同与极限动态抗冲击控制;银河通用GalbotG1凭借灵巧手完成盘核桃、叠衣服等柔性物料处理,攻克了复杂物理环境下的高精度力控难点;松延动力E1/N2则依托大模型实现了自然语义交互与情绪陪伴。上述能力集中突破,印证了大模型大脑与通用运动小脑的融合已初见成效,标志着人形机器人正式具备了向真实复杂商业场景渗透的物理与智能基础。

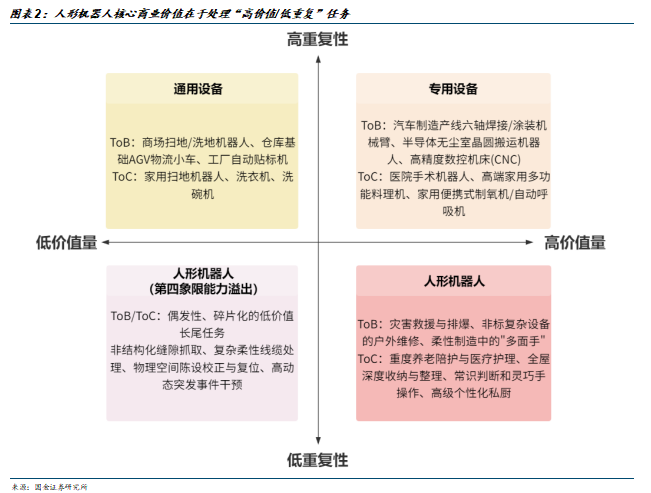

人形机器人的商业化价值几乎必然面向“高价值/低重复”任务。我们将机器人面向的商业场景抽象为四大象限。第一象限(高重复、高价值)是典型的专用设备领域,如汽车组装车间的机械臂或医疗领域的达芬奇手术机器人,客户愿意为特定高价值任务买单,但设备泛化性弱;第二象限(高重复、低价值)多由通用型自动化设备主导,如仓储AGV或家用扫地机,以标准化方案解决低附加值劳动;我们认为,人形机器人由于初期研发成本较高,其必须面向具有高额支付意愿的“高价值”领域;同时,其通用形态与泛化智能的溢价,只有在面对非标准化、高度复杂的“低重复性”任务时才能得到真正释放。因此,人形机器人真正的星辰大海在于第四象限(低重复、高价值)。此外,第三象限(低重复、低价值)中长尾且琐碎的日常杂务(如捡拾零散纸团),目前并不具备独立的商业化土壤,我们预计这类场景将在第四象限核心技术成熟后,受益于技术外溢被顺带解决。

在“高价值、低重复”的核心市场中,基于机器人能力侧重点(大脑思考泛化/小脑动作泛化)与客群属性(ToB/ToC)的进一步解耦,人形机器人的商业化落地可划分为四大细分场景。

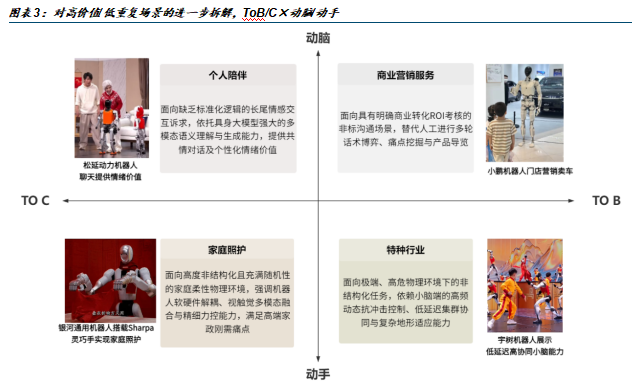

其一,多动脑×ToB端的营销服务场景,主要聚焦商业环境下的逻辑推理与信息交互。该场景对机器人物理运动能力要求较低,仅需完成平地行走、手势引导等基础动作,却对模型“大脑”的动态认知能力要求颇高。小鹏汽车全新人形机器人IRON率先落地自有门店“导览、导购、导巡”核心商业场景,在展厅动态复杂环境中,可实时调用VLM/VLA架构的底层物理大模型,除完成引路导览外,还能精准解析客户非标准化需求、自主开展产品答疑,并在多轮对话中挖掘客户痛点、输出定制化营销话术,核心商业价值体现在提升门店获客转化率、优化终端运营效率、实现服务人力成本替代上。

其二,多动脑×ToC端的个人陪伴场景,核心在于提供情绪价值与非结构化对话。该场景对机器人的物理动作复杂度要求有限,基础的肢体回应与表情反馈即可满足需求,但高度依赖大语言模型的语义共情、意图识别与长程多轮交互能力。以春晚小品中亮相的松延动力机器人为例,其面向老年群体的陪伴功能颇具代表性,不仅能流畅完成日常聊天、兴趣互动等对话任务,还可实时感知情绪变化并给予针对性回应。该场景核心是通过高频次的情感交互建立深度用户粘性,将机器人转化为家庭中的智能陪伴终端,从而挖掘长期的服务价值。

其三,多动手×ToB端的特种行业场景,对机器人的动态平衡、抗冲击力及全地形机动能力提出高要求。以宇树科技在2026年春晚《武Bot》节目中的表现为例,其技术底座已具备向特种场景落地的清晰可行性:一是具备较强的高动态运动控制能力,机器人在连续后空翻、武术动作中展现的姿态控制、落地缓冲与动态稳定能力,可为复杂地形通行、应急越障、高危环境作业提供运动基础;二是具备人机协同与精细力控能力,可完成精准器械操作、高速动作协同,并与人员安全无碰撞交互,感知与操控精度已满足协同作业、制式装备操作等场景的硬件条件;三是具备集群协同作业能力,20 余台机器人在直播环境下完成高速编队与队形变换,验证了低延迟通信、路径规划与避障算法的成熟度,形成了多机协同作业的技术闭环。更为关键的是,依托全栈自研,宇树将单机成本压降至10万元以内,而海外竞品波士顿动力Spot的售价约 53 万元且未实现规模化量产,其成本优势为规模化部署提供了商业基础,其早期产品甚至曾获美国海军陆战队的批量采购用以侦察运输。这种兼具高机动性能、集群协同潜力与低成本量产能力的产业化进展,已引发战略层面关注。2026年2月14日,美国国防部将宇树科技列入“1260H”清单,实施投资与采购限制。我们认为,此类管制措施从侧面印证了高机动性小脑机器人在特种行业及关键领域的战略价值与应用潜力。

其四,多动手×ToC端的家庭照护场景,需要应对高度非结构化且随时变动的家庭物理环境。该场景需要机器人具备稳定的底盘移动能力,以适配居家多样的空间布局,同时要求针对各类柔性物料的精细力控与灵巧操作能力,精准把控施力幅度与动作精度。如银河通用机器人搭载Sharpa灵巧手,可灵活完成盘核桃、折叠衣物、平稳端水杯等精细化操作,精准适配居家日常的各类操作需求,以此高效替代人类从事兼具精细度与实用性的高价值家政劳动,释放家庭照护中的人力成本。

2. 模型:具身智能泛化的曙光,一段式学习系统取得突破

2.1 端到端:Figure AI布局全身推理系统,特斯拉Optimus与无人驾驶共享一套世界模型

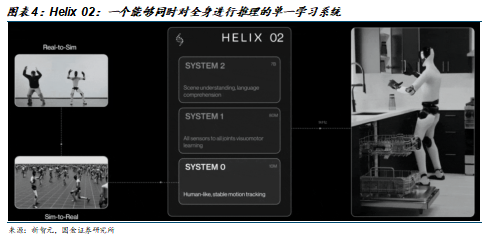

2026年初,Figure AI发布Helix 02,采用了单一的神经系统,新增S0系统,能够在整个房间范围内实现“灵巧、长时程的自主行为”:

S2(大脑)负责理解复杂的指令,缓慢地进行目标推理:解读场景、理解语言并规划行为序列。

S1(脊髓)负责敏捷的动作执行,快速思考,以200 Hz的频率将感知转化为全身关节的目标指令。

S0(小脑)负责稳健的身体控制,以1 kHz 的频率执行,负责全身的平衡、接触与协调。

新增的S0系统为机器人提供“运动直觉”,它是一个用于机器人全身控制的基础模型,是Helix 02物理具身的核心基础。当更高层级负责任务推理与规划时,S0确保每个动作都能平稳、安全且稳定地执行。S0并非为行走、转向、蹲下或伸手等动作分别设计奖励函数,而是直接从大量且多样化的运动数据中学习追踪人体动作。Figure投喂了超过1,000小时的关节级重定向人类运动数据,而S0则是在不断的仿真模拟中,模仿这些人类的动作。

在2026年Scaled ML大会上,特斯拉人工智能软件副总裁阿肖克・埃卢斯瓦米发表主题演讲,提及将奥斯汀上线的无人驾驶robotaxi服务与即将量产的Optimus串联起来。在此背景下,特斯拉研发出世界仿真模型——这一模型基于状态与动作的配对数据训练而成,只需输入当前的摄像头画面和执行动作,就能精准生成摄像头的下一帧画面,构建出高度逼真的虚拟场景。当世界仿真模型达到预期效果后,便可与策略神经网络对接,形成闭环仿真系统:模型生成后续视频帧,策略神经网络依据画面规划下一步动作,动作再反馈至模型进行迭代,最终构建出连贯、多样的仿真环境。值得注意的是,这款世界仿真神经网络并非专为自动驾驶设计,由于采用通用数据训练,它同样可完美适配Optimus人形机器人。

目前,Optimus能在这一虚拟环境中流畅完成移动、操作等任务,而画面中的所有像素均由模型生成——借助这一工具,机器人智能体可在精准还原的极端场景及其各类变体场景中反复测试,大幅降低现实测试的成本与风险。马斯克透露,特斯拉正基于这一模型,打造一座“Optimus学院”,未来将让数万台机器人在这一实体训练基地中,通过现实场景的“自训练”掌握各类任务技能。

此外,为了打通“仿真到现实的鸿沟”,特斯拉计划在现实场景中部署1万至3万台Optimus机器人,一方面用于验证虚拟训练的效果,另一方面通过采集现实场景中的海量数据,持续优化虚拟训练所使用的“现实生成器”,实现虚拟与现实的双向迭代。同时,马斯克也提到xAI研发的Grok大模型,或将成为Optimus机器人集群的高级调度中枢。

2.2 大脑:预训练跨越Scaling Law门槛,激活参数或为7B

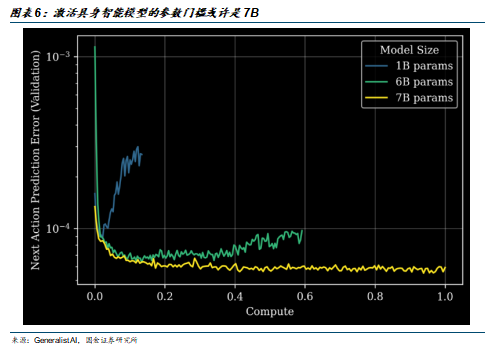

具身智能大脑模型的预训练阶段正加速跨越Scaling Law的激活门槛,行业面临的卡点已从科学探索转向工程与数据堆叠。2025年11月,北美初创企业Generalist AI发布GEN-0模型,首次在业内验证了具身智能模型存在类似大语言模型(LLM)的参数激活现象,且其门槛当量约为7B,而当前市面现有模型参数普遍停留在4B左右。

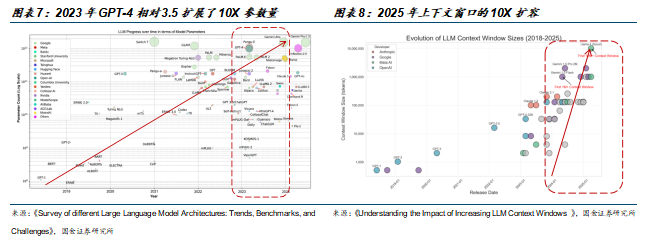

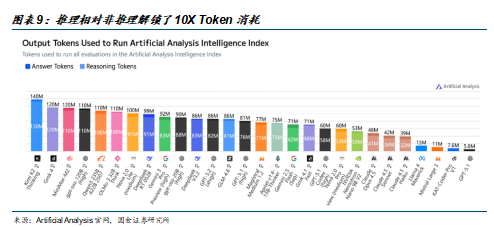

复盘LLM过去3年的演进轨迹,每一年都是在特定技术维度上通过资源堆砌的暴力美学实现了10倍级以上的跃升。2023年是预训练的Scaling Law,以GPT-4为代表,行业将模型参数量从千亿级拉升至万亿级规模(第一个10倍),成功将海量互联网数据压缩进权重,彻底解锁了模型的通用常识底座;2024年是后训练的Scaling Law,以DeepSeekR1及GPT-o为代表,通过强化学习与思维链技术解锁了深度逻辑推理能力,同一模型在响应复杂任务时的推理Token消耗量是单纯回答问题的10倍以上(第二个10倍);2025年则是存储的Scaling Law,随着Gemini3等新一代模型的面世,通过堆高存储硬件与架构优化,将模型的上下文窗口长度从100k拉升至1M 甚至10M 级别(第三个10倍),解锁了模型的长期记忆与海量信息吞吐能力。

我们认为具身智能正处于复刻该指数级跃升的前夕。随着模型跨过7B这一幂律定律的激活临界点,后续能力的提升将主要依赖于算力与多维空间数据的暴力美学灌溉。换言之,具身智能大脑的发展路径已相对明朗,其核心矛盾已由复杂的科学算法问题,降维为算力供给与数据获取的工程问题。

2.2 小脑:跨本体通用小脑问世,Behavior牵动具身智能ImageNet时刻

跨本体通用小脑的问世与标杆数据集的开源,标志着机器人运动控制领域逐步迈向范式升级,有望迎来类似计算机视觉领域的“ImageNet时刻”。

传统机器人运动控制高度依赖特定硬件本体的单一模型训练,泛化性极差。而在2025年9月,北美创企 Skild AI 突破性地发布了通用小脑模型,在相对于传统模型训练量提升500倍的算力加持下,该模型成功实现了跨本体的自适应运动控制,即无论机器狗是双足、四足还是存在肢体受损,同一套模型均能实现高效的自平衡与运动泛化。

Skild AI的实践验证了大规模训练在机器人控制领域的有效性,但要实现从单点突破到行业规模化复制,亟需统一的数据基座与评价体系。2012年,ImageNet以千万级高质量标注图片及统一竞赛标准,为深度学习算法迭代提供了客观依据,成为计算机视觉技术爆发的起点;如今,BEHAVIOR挑战赛正推动具身智能领域重现这一历程。该挑战赛向业界开放了总计超1,200小时、包含10,000条专家遥操作示范的高质量数据集,并对物体状态、空间关系及自然语言描述进行精细标注。BEHAVIOR不仅缓解了机器人训练数据匮乏的痛点,更通过构建首个统一基准测试,为通用小脑泛化能力提供了公平度量标准,将有效推动相关算法快速收敛与迭代。

3. 数据:三线交织,虚实融合,加速演绎

3.1 真实数采:刚需,UMI解锁轻量化、无本体、低成本方案

真实机器采集数据是具身智能迭代的核心刚需,轻量化采集设备的技术突破推动数据获取实现降本提效,UMI方案则进一步破解传统采集模式的痛点,成为轻量化真实数据采集的关键路径。

UMI(Universal Manipulation Interface)作为一种新型轻量化真实数据采集方案,其核心在于实现数据采集过程与机器人本体的完全解耦。该系统硬件极为精简,仅由一套手持式3D打印平行夹爪与腕部视角相机构成,整套设备成本控制在400美元左右。采集过程中,相机同步记录相对末端轨迹,而非传统方式中机械臂的绝对关节角度。这种设计将数据采集设备从昂贵的工业机械臂简化为一套“即拿即用”的手持终端,本质上是将机器人操作数据的生产门槛从专业实验室级别降维至消费电子级别。

相较于传统采集方案,UMI在采集场景、数据泛化、成本控制三个核心维度实现突破:

采集环境从封闭式向开放式拓展,摆脱对数采工厂的依赖,保障数据多样性与采集高效性。传统遥操作采集依赖昂贵的工业机械臂与动捕设备,仅能在封闭实验室或专业数采工厂开展采集工作。而UMI凭借手持终端的轻量化优势,无需固定场地及复杂配套设备,采集人员可便捷进入家庭、办公室、户外等各类非结构化真实场景完成采集,显著丰富了数据的场景多样性与真实度,使采集数据更贴合具身智能的实际应用需求。

数据泛化能力显著提升,可实现高质量数据的跨设备复用。传统采集模式高度依赖特定机器人的关节角度数据,导致数据通用性差、难以跨构型复用。而UMI以腕部第一视角相机作为唯一观测点,避免采集者体型差异带来的视觉误差,同时重点记录末端执行器的轨迹与姿态,而非具体关节参数。这种“重末端、轻本体”的表征方式,使采集数据具备极强的硬件无关性,可无缝迁移至不同构型、不同尺寸的机器人训练中,有效解决了传统数据复用性差的问题,实现数据价值最大化。

商业经济性优势突出,可将真实数据的采集成本击穿至消费级区间。传统真机采集属于重资产投入,高额的场地租金、机械臂折旧及设备运维成本,制约了数据的规模化获取。而UMI凭借硬件精简、与机器人本体解耦的设计,有效剥离了高额固定成本。运营成本层面,其部署效率较高,无需搭建固定工装,也无需调试机械臂与动捕系统的联动参数,开机即可启动采集;同时,其采集速度达到传统遥操作模式的3倍,可在相同时间内完成更多场景的采集任务,提升单位时间样本产出量。双重优势叠加下,UMI将采集成本击穿至消费级区间,为具身智能大规模数据采集提供了财务可行性。

3.2 仿真合成:增广,不断逼近真实世界的性价比方案

一般而言,真机数据的优势在于其高保真度(物理交互的真实性),能够精准反映复杂操作中的力学反馈和不确定性,劣势在于采集成本高昂、采集周期长且现阶段数量较少。仿真合成数据的优势在于低成本、高效率与场景的可扩展性,基于物理引擎可快速生成海量的多样化数据,尤其适合预训练数据积累与极端场景的模拟,劣势在于“仿真鸿沟”——虚拟环境与物理现实的偏差导致模型在真实任务中表现不稳定。目前,英伟达、Skild AI、银河通用三家厂商已明确在训练具身智能大模型时采用了仿真合成数据。

真机数据采集路线的典型代表是北美具身智能明星企业Physical Intelligence(简称PI),有报道称PI租下了Airbnb在旧金山的许多公寓用于真实空间和场景的数据采集,成本极为高昂。仿真合成数据的代表以银河通用为例,其基于NVIDIA Isaac平台构建高效的数据生产管线,通过升级物理真实性与渲染并行度,仅一周即生成全球规模最大的十亿级机器人操作数据集。作为全球首个完全基于仿真合成大数据进行预训练的具身大模型,GraspVLA展现出比OpenVLA、π0、RT-2、RDT等模型更强大的泛化能力:光照泛化、干扰物泛化、平面位置泛化、高度泛化、背景泛化、物体类别泛化。

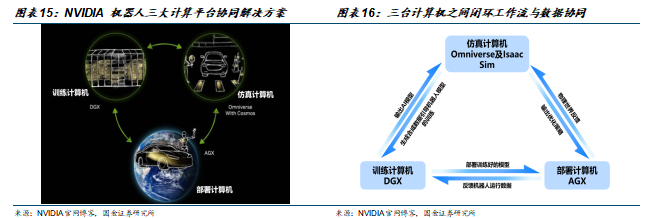

NVIDIA CEO黄仁勋于2025年CES大会上指出,每家机器人公司最终都必须构建三台基础计算机协同的解决方案,形成从训练到优化再到执行的完整体系。对于英伟达而言,“第一台计算机”是DGX AI超级计算机,用于训练。“第二台计算机”是基于NVIDIA RTX PRO服务器的NVIDIA Omniverse和Cosmos,用于生成合成数据、进行强化学习,同时也是DGX和 AGX的桥梁。“第三台计算机”是NVIDIA为边缘计算和自主系统设计的嵌入式平台NVIDIA Jetson AGX Thor,用于端侧部署。从训练到仿真再到部署,“三台计算机”打造了英伟达在通用人形机器人的完整框架,可以缩短人形机器人的开发周期、降低开发成本和风险,构建开放的生态系统。

第一步,在“第一台计算机”上训练模型,开发者可以在NVIDIA DGX平台上使用NVIDIA NeMo 来训练和微调AI模型,还可以利用NVIDIA Project GR00T使人形机器人能够理解自然语言,并能够通过观察人类行为来模仿动作。第二步,开发者可利用Omniverse和Cosmos生成海量符合物理特性的多样化合成数据,例如2D或3D图像、分割掩码、深度图或运动轨迹数据,为模型训练和性能优化奠定基础;开发者在基于Omniverse构建的NVIDIA Isaac Sim的仿真环境中零风险验证其机器人策略;还可以使用“第二台计算机”的Isaac Lab(一个开源的机器人学习框架),赋能机器人的强化学习和模仿学习,加速完善机器人的训练策略。第三步,训练好的AI模型被部署到端侧计算机上。

近年来,英伟达不断强调旗下图形部门中仿真条线的重要性,即“第二台计算机”的重要性。美国科技媒体《The Information》深入报道了英伟达创始人兼CEO黄仁勋子女在该公司任职的情况。报道指出,黄仁勋现年34岁的女儿黄敏珊(Madison Huang)于2020年加入英伟达,现任Omniverse和机器人技术领域的资深产品营销主管。其35岁的儿子黄胜斌(Spencer Huang)于2022年加入英伟达,目前担任机器人项目的产品经理。

黄仁勋的管理理念与传统企业不同,他相信企业架构的扁平化结构与信息的极度透明可以提高企业运转效率,因此公司高管直接向黄仁勋汇报工作。仿真技术副总裁和英伟达其他重要业务部门副总裁(如GPU工程高级副总裁、DGX Cloud业务副总裁等)一并直接向黄仁勋汇报工作。从黄仁勋家族成员在公司的角色配置和岗位安排,再到仿真技术副总裁的直接汇报,不难看出黄仁勋本人对于英伟达仿真业务的重视程度之深。

Omniverse是一个用于大规模构建和运行3D应用程序及服务的开发平台,该平台基于OpenUSD(通用场景描述)和NVIDIA RTX渲染技术,支持实时协作、物理精准仿真和生成式AI集成,主要应用于工业数字化、机器人训练、自动驾驶仿真和元宇宙等领域,已成为工业设计、数字孪生、AI 开发等领域的核心工具。

NVIDIA Isaac Sim是一款基于Omniverse构建的开源应用,使开发者能够在基于物理的虚拟环境中模拟和测试AI机器人解决方案。Isaac Sim 有以下三大功能:

生成合成数据:Isaac Sim支持大规模合成数据生成,包括感知、移动、基于物理的抓取等,并提供写实渲染和自动生成真实标签,用于训练和微调机器人基础模型。

执行软件在环测试:Isaac Sim可通过与真实机器人软件集成,为完整的机器人堆栈实现软件在环(software-in-the-loop)测试,从而验证机器人控制与感知系统。

支持机器人学习:Isaac Lab是基于Isaac Sim平台构建的开源轻量级应用,专为大规模机器人学习进行优化。通过Isaac Lab支持机器人学习流程,可加速仿真中的训练,助力模型在现实场景中的快速部署。

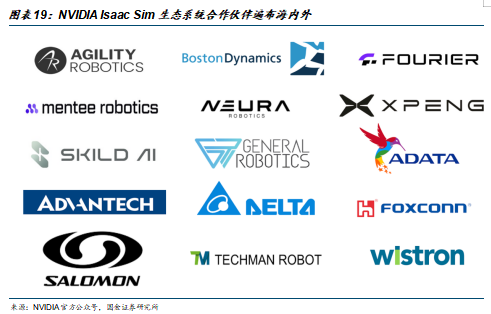

目前,Agility Robotics、波士顿动力、傅利叶、Mentee Robotics、Neura Robotics和小鹏机器人等公司正在使用Isaac Sim和Isaac Lab对其人形机器人进行仿真和验证。Skild AI正在使用该仿真框架开发通用机器人智能,General Robotics正在将其集成到其机器人仿真平台中。此外,中国台湾的电子和机器人制造商,比如威刚科技 (Adata)、研华科技 (Advantech)、台达电子 (Delta Electronics)、Foxconn、Foxlink、所罗门 (Solomon)、达明机器人 (Techman) 和纬创 (Wistron) 同样也在使用Isaac Sim和 Isaac Lab开发下一代 AI 机器人。

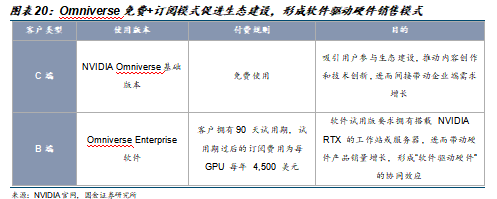

目前,个人创作者、设计师和开发者可免费使用NVIDIA Omniverse的基础版本,目的是降低设计技术门槛,吸引用户参与生态建设,通过培养用户群体,推动内容创作和技术创新,进而间接带动企业端需求增长。针对企业用户,NVIDIA Omniverse专门推出了Omniverse Enterprise软件,企业用户可拥有90天试用期,试用期过后的订阅费用为每GPU每年4,500美元。但该软件试用版要求拥有搭载NVIDIA RTX的工作站或服务器(官网建议要求具有16GB VRAM的支持RTX的GPU)。这种销售模式将在一定程度上带动硬件产品(GPU等)销量增长,形成“软件驱动硬件”的协同效应。

2025年7月,协创Fcloud Omnibot平台与NVIDIA Cosmos Transfer模型的集成为机器人训练提供解决方案。通过云端一键部署的先进多模态模型,开发者可以分钟级生成物理精确的合成数据,实现跨模态数据增强与域适应,构建包含边缘案例的多样化训练集,建立持续自我优化的数据闭环系统。

OmniBot依托奥佳的GPU云技术底座,集成NVIDIA Isaac Sim 和NVIDIA Isaac Lab ,并结合丰富的AI大模型,为机器人开发者提供更好、更高效的开发方式、训练、仿真、部署、运营以及机器人系统优化等功能。

基于Omnibot开发平台进行数据增强模型实测显示,使用NVIDIA Research官网上的视频案例作为模型输入,视频中一个机械臂正在移动物体,我们给cosmos transfer 1模型第一个的问题是:“给视频中的机械臂加一个底座”,可以看到模型可以快速理解机械臂的底部位置在哪里并完成生成动作;给cosmos transfer 1模型第二个的问题是:“给视频中的桌子变成蓝色的,并给背景加上光线”,模型基于用户的提示词可以快速执行并生成可用的工业化结果。

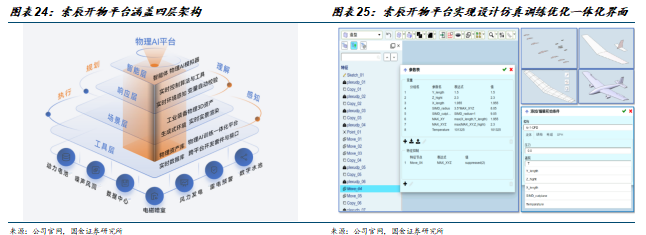

2025年2月,索辰科技在上海、北京、广州等六地举行索辰物理AI开发平台“天工·开物”产品发布会,推出索辰开物平台。索辰开物平台基于生成式物理AI技术和实景渲染技术,实现真实场景下的四维时空耦合多物理场设计、仿真、优化和训练,并应用于工业装备的研制和部署。索辰开物平台具有以下四大功能:

环境感知:通过传感器硬件和企业级实时历史数据库pSpace,物理AI可实时感知现实环境,支持国内外主流的1,000多种厂家设备,支持1,000客户端并发访问、高速数据读写。通过3D渲染场景中的环境感知器,物理AI可实时感知虚拟环境,获取计算所需的物理参数。

设计仿真训练优化一体化:全参数化的CAD-CAE一体化设计使得设计参数贯穿整个工作流。通过特征抑制可快速切换不同学科不同设计阶段的模型,对设计参数的变更可立刻反馈到所有学科的几何模型以及分析参数。在参数化几何上直接赋予仿真分析设置,无需转换数据格式或者在不同软件中导入导出,简化操作,规避数据丢失、冗余,或者几何拓扑错误等问题。通过自动化的工作流实现仿真、训练、优化的一体化运行。

数据互联:支持导入常见3D资产格式、CAD格式、网格格式。支持表面物理场、空间物理场、特殊物理场等结果可视化输出。支持导入URDF格式的机器人模型。

拓展开发:支持对物理仿真和AI模块的前后端以及应用平台进行二次开发。

2025年7月,索辰科技在索辰开物平台的基础上推出了索辰具身智能虚拟训练平台。该虚拟平台如同一个无限延展的训练场,能够构建出远超真实世界场景库能提供的数据量级,打破真实世界的限制,让机器人在各种复杂情境下都能得到充分训练。

2025 CES英伟达发布Cosmos世界模型,迭代Omniverse平台与Isaac Sim 4.5。Isaac Sim为AI机器人开发提供物理虚拟环境,覆盖训练、测试到部署全流程的机器人仿真工具。从技术架构看,索辰科技构建了完整的物理AI生态。索辰科技基于自主研发的仿真求解器,开发出覆盖流体、结构、电磁、声学、光学等多学科的核心算法,不仅能够实现传统CAE仿真,而且能够支撑物理AI的训练、测试和部署全流程。从这个角度看,我们认为索辰科技的物理AI实质上是中国版的Isaac Sim。

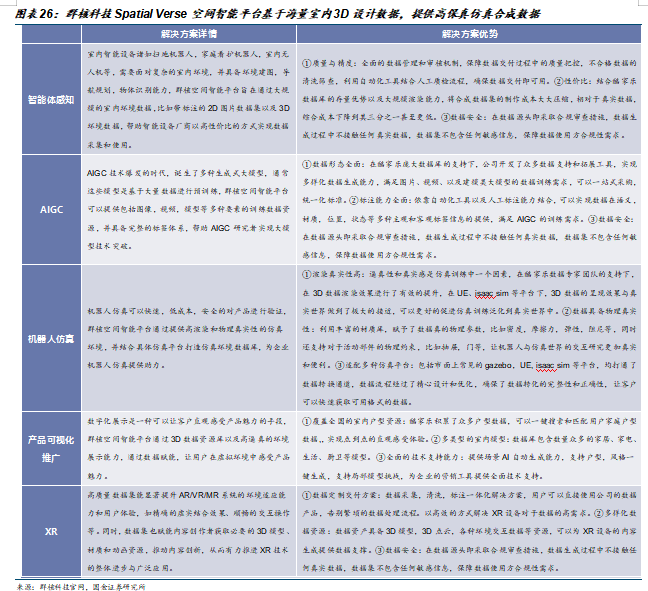

群核科技于2020年推出空间智能平台Spatial Verse,这是一个面向室内环境AI开发的解决方案,该平台通过构建庞大且物理正确的数据集库,利用高精度3D设计数据、渲染引擎与空间编辑工具,生成高度逼真、符合真实世界物理特性(如材质反射与重力模拟)的合成环境,使开发者能训练AIGC模型并增强智能机器人、AR/VR系统的空间认知能力;同时,通过多传感器兼容性与NVIDIA Isaac Sim的Open JSD框架对接,支持高保真RTX渲染和工业级虚拟仿真,SpatialVerse架起了数字世界与物理现实的桥梁,为空间智能算法提供降低测试成本、加速落地的产业级工具。

世界模型的持续迭代,使机器人可在虚拟环境中精准预判物理规律与动态变化。北美方面,谷歌DeepMind发布的Genie 3首次实现了仅凭文本提示即可生成720P分辨率、24FPS的高动态三维交互世界,该模型不仅具备长达数分钟的物理一致性与空间记忆,还能对导航、环境干预等外部操作做出符合物理定律的实时响应。国内方面,蚂蚁灵波科技全面开源了LingBot-World及其衍生模型,实现了极低延迟的键盘/鼠标实时操控与长达10分钟的无损连续生成,克服了长时漂移与细节塌陷问题,且首创了自回归“视频-动作”一体化框架,支持机器人同步推演未来物理状态并输出动作指令。这种内化了物理因果律、空间结构与长时交互能力的新一代世界模型,为具身智能提供了可靠的虚拟仿真与交互推演支撑,其生成的海量高质量交互合成数据,可缓解机器人产业的数据供给瓶颈。

3.3 人类视频:潜力,AI多模态能力突飞猛进

AI 大模型多模态理解与生成能力的快速进步,使得海量人类第一人称及第三人称视频,正高效转化为机器人训练数据。此前,受人手与机器夹爪的跨本体形态差异限制,人类视频难以直接用于机器人训练。随着多模态大模型持续迭代,该技术瓶颈已被快速突破,模型可将人类视频中的动作语义精准映射至机器本体。目前,Tesla Optimus、Figure 等北美头部企业已大规模采用人类视频数据开展模型训练。

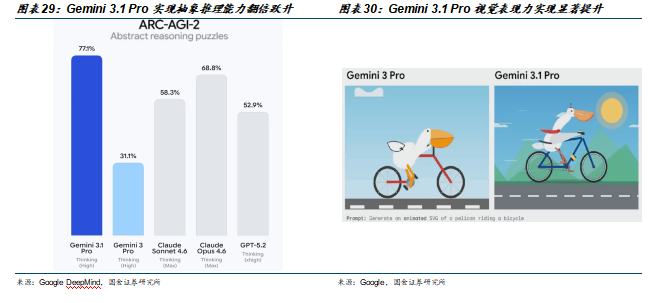

谷歌此前发布的 Gemini 3.0 Pro 已展现出强劲的视觉解析能力:在多模态屏幕理解任务(Screenshot-Pro)中得分达 72.7%,显著高于 Gemini 2.5 Pro(11.4%)和 Claude 4.5(36.2%);在高阶视觉逻辑推理指标 ARC-AGI-2 上,得分由 Gemini 2.5 Pro 的 4.9% 提升至 31.1%,同样领先 GPT-5.1(17.6%)。在此基础上,最新迭代的 Gemini 3.1 Pro 实现能力再次跃升,其 ARC-AGI-2 抽象推理指标得分高达 77.1%,较 3.0 版本实现翻倍提升,并大幅领先同期的 Claude Opus 4.6(68.8%)与 GPT-5.2(52.9%)。核心指标的快速提升,印证了多模态大模型在空间抽象与逻辑推理能力上的高速进化。这一底层能力突破,将显著提升人类视频向机器人训练数据的转化与映射效率,充分盘活全网海量存量视频资源,为机器人理解真实物理世界提供持续、高质量的数据支撑。

风险提示

北美人形机器人量产节奏不及预期的风险。

目前产业聚焦在北美量产指引的兑现节奏上,若新版本机器人发布效果不及预期或量产指引持续miss,或对产业链放量节奏产生一定扰动。

通用机器人Day1 L4路线缺乏商业化基础的风险。

目前通用机器人产业发展尚处早期,人形机器人各项软硬件环节成熟度参差不齐,若押注Day1 L4路线在展业过程中缺乏足够容量的买单客群,或存在商业闭环到数据闭环都无法建立的风险。

仿真合成数据质量不及预期的风险。

目前“缺数据”仍是机器人落地的核心卡点之一,假如基于Sim2Real模式的仿真合成数据质量不及预期,或对英伟达Isaac Sim、索辰机器人虚拟平台等主体的发展带来扰动。

模型及软件解决方案三方公司长期产业链话语权较低的风险。

参考部分智能驾驶算法厂商与主机厂之间的角力关系,若未来机器人产业渐趋成熟,在国内商业生态普遍对于软件厂商不算友好的环境下,或出现三方数据商、模型算法商产业链话语权较低的风险。

VIP复盘网

VIP复盘网